diff --git a/.idea/Java-Interview-Tutorial.iml b/.idea/Java-Interview-Tutorial.iml

deleted file mode 100644

index 24643cc374..0000000000

--- a/.idea/Java-Interview-Tutorial.iml

+++ /dev/null

@@ -1,12 +0,0 @@

-

-

-

-

-

-

-

-

-

-

-

-

\ No newline at end of file

diff --git a/.idea/codeStyles/codeStyleConfig.xml b/.idea/codeStyles/codeStyleConfig.xml

deleted file mode 100644

index a55e7a179b..0000000000

--- a/.idea/codeStyles/codeStyleConfig.xml

+++ /dev/null

@@ -1,5 +0,0 @@

-

-

-

-

-

\ No newline at end of file

diff --git a/.vscode/.server-controller-port.log b/.vscode/.server-controller-port.log

index a75930b743..e2033b402d 100644

--- a/.vscode/.server-controller-port.log

+++ b/.vscode/.server-controller-port.log

@@ -1,5 +1,5 @@

{

"port": 9145,

- "time": 1744085260411,

+ "time": 1774506700848,

"version": "0.0.3"

}

\ No newline at end of file

diff --git a/docs/.vuepress/config.js b/docs/.vuepress/config.js

index 2b75a96587..805c79d925 100644

--- a/docs/.vuepress/config.js

+++ b/docs/.vuepress/config.js

@@ -356,7 +356,7 @@ module.exports = {

link: '/md/security/OAuth 2.0实战-为什么要先获取授权码code.md'

},]

},

-

+

{

text: 'Arthas',

items: [{

@@ -364,6 +364,15 @@ module.exports = {

link: '/md/arthas/Arthas使用.md'

},]

},

+

+ {

+ text: 'MyBatis',

+ items: [{

+ text: 'MyBatis',

+ link: '/md/mybatis/mybatis-automatic-mapper-implementation-principle.md'

+ },]

+ },

+

]

},

@@ -377,6 +386,8 @@ module.exports = {

},]

},

+

+

{

text: '响应式编程',

items: [{

@@ -771,6 +782,11 @@ module.exports = {

text: 'A2A',

link: '/md/AI/a2a/a2a-a-new-era-of-agent-interoperability'

},

+

+ {

+ text: 'Skills',

+ link: '/md/AI/skills/ovrview'

+ },

]

},

@@ -1149,6 +1165,7 @@ module.exports = {

collapsable: false,

sidebarDepth: 0,

children: [

+ "shardingsphere-jdbc-spring-boot-orm-integration-guide",

"10-顶级企业如何用数据脱敏保护用户隐私!",

"11-动态配置管理背后的编排治理真相!",

"14-ShardingSphere的分布式主键实现",

@@ -1242,11 +1259,12 @@ module.exports = {

sidebarDepth: 0,

children: [

"00-Java并发编程.md",

- "01-synchronized原理.md",

- "02-volatile原理.md",

- "03-ReentrantLock与AQS.md",

+ "synchronized",

+ "volatile",

+ "reentrantlock",

"04-线程池以及生产环境使用.md",

"05-京东并行框架asyncTool如何针对高并发场景进行优化?.md",

+ "forkjoinpool",

"java21-virtual-threads-where-did-my-lock-go",

]

},

@@ -1264,6 +1282,7 @@ module.exports = {

"Java22-new-features",

"Java23-new-features",

"java24-new-features",

+ "java25-new-features",

"java2024",

"java-news-roundup-jun02-2025",

]

@@ -1277,6 +1296,8 @@ module.exports = {

"IntelliJ IDEA 2024.1 最新变化",

"What’s-New-in-IntelliJ-IDEA-2024.2",

"What’s-New-in-IntelliJ-IDEA-2024.3",

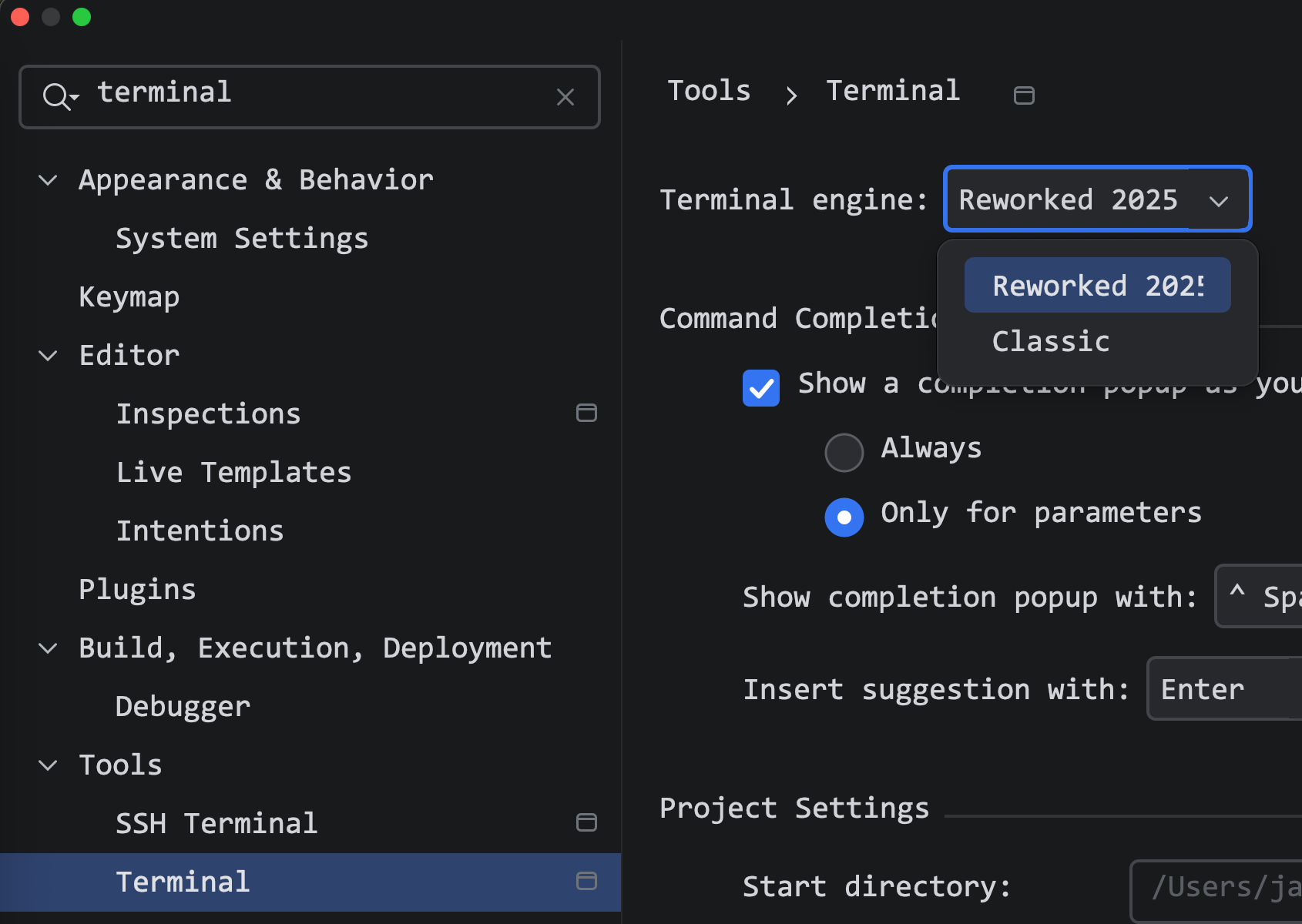

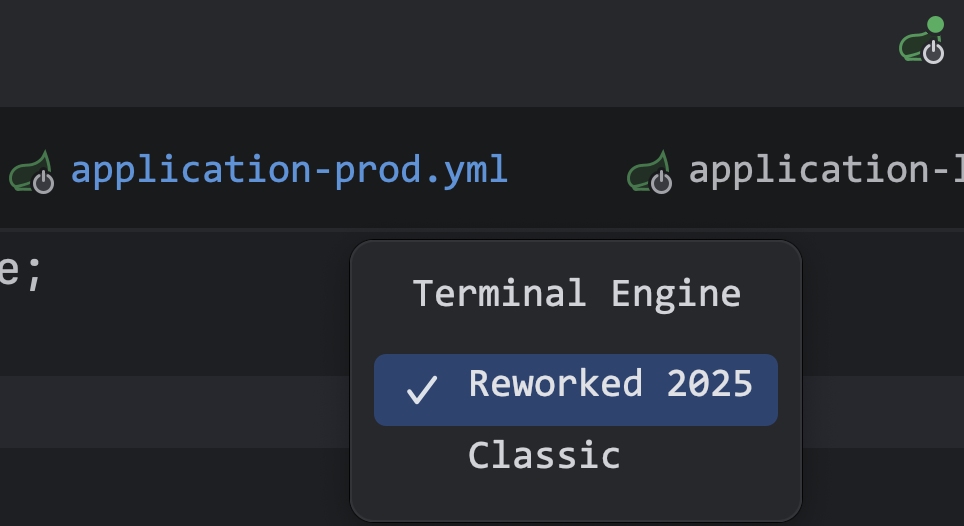

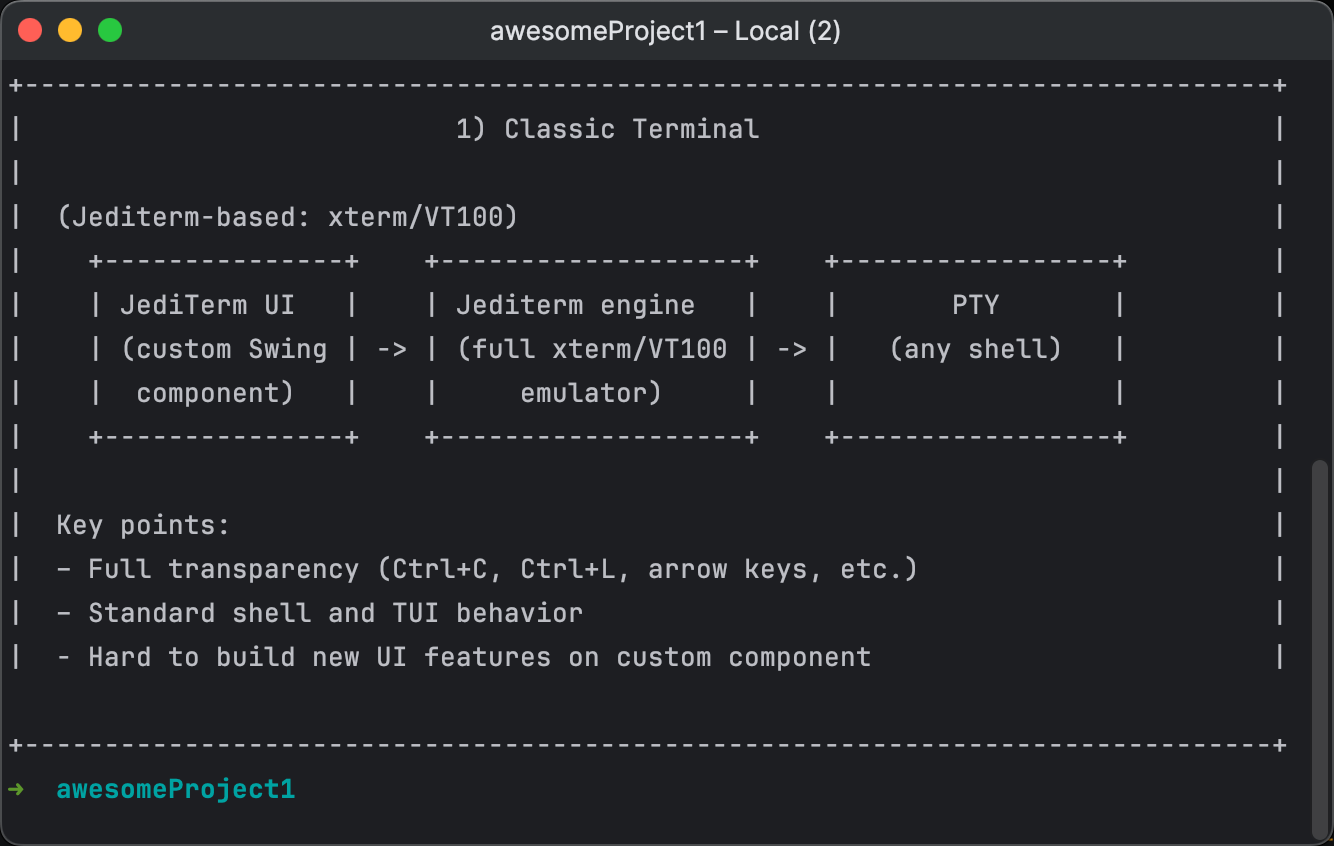

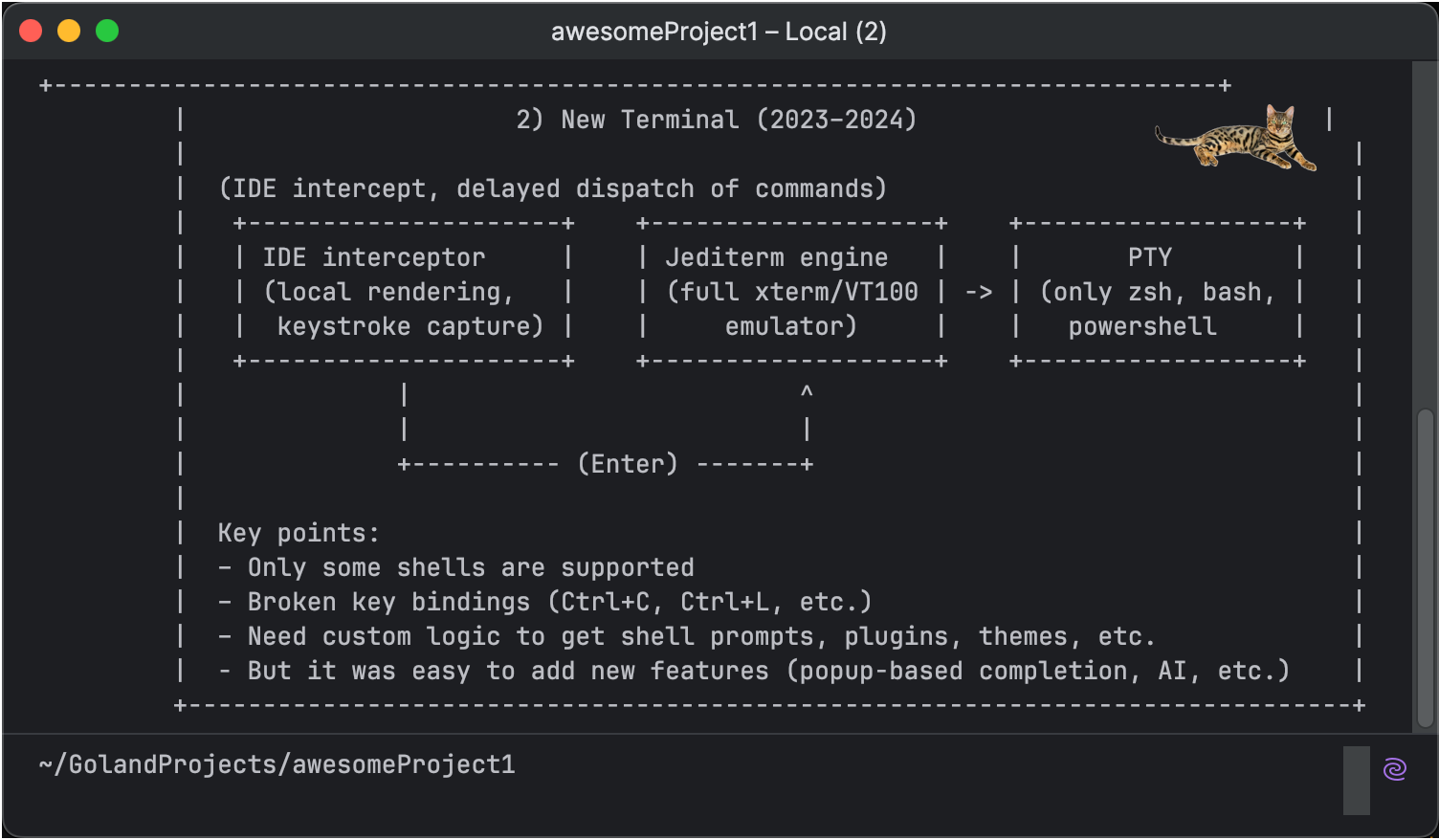

+ "jetbrains-terminal-a-new-architecture",

+ "What’s-New-in-IntelliJ-IDEA-2025.3",

]

},

],

@@ -1336,6 +1357,7 @@ module.exports = {

"【图解数据结构与算法】LRU缓存淘汰算法面试时到底该怎么写",

"【图解数据结构】外行人也能看懂的哈希表",

"dag-directed-acyclic-graph",

+ "dynamic-programming-how-to-quickly-spot-when-to-use-dp",

]

}],

@@ -2068,6 +2090,7 @@ module.exports = {

"router",

"table",

"vue-js-vs-axios-practical-guide-from-ajax-requests-to-api-proxy-configuration",

+ "frontend-ci-cd-automation-deploy-and-instant-rollback-solution",

]

}],

@@ -2089,7 +2112,7 @@ module.exports = {

collapsable: false,

sidebarDepth: 0,

children: [

- "00-区块链专栏概述",

+ "blockchain-column-overview",

"三分钟,快速了解区块链技术",

"01-联盟链入门",

"05-账本模型",

@@ -2097,6 +2120,7 @@ module.exports = {

"07-网络与共识",

"08-工作量证明",

"09-一文看懂以太坊智能合约!",

+ "oracles-unavoidable-offchain-data-onchain-alternatives-truth",

"blockchain-smart-contract-helloworld-project",

]

},

@@ -2184,6 +2208,9 @@ module.exports = {

"chatgpt-canva",

"memory-faq",

"GPT-5",

+ "GPT-5.1",

+ "GPT-5.2",

+ "GPT-5-3-codex",

]

},

{

@@ -2194,6 +2221,7 @@ module.exports = {

"qwen-QwQ",

"qwen3",

"qwen3-coder",

+ "qwen-coder-qoder",

]

},

@@ -2226,6 +2254,8 @@ module.exports = {

"claude-3-7-sonnet",

"claude-4",

"claude-4-5-sonnet",

+ "claude-opus-4-6",

+ "claude-sonnet-4-6",

]

},

@@ -2374,8 +2404,10 @@ module.exports = {

children: [

"ai-agents-dont-security-nightmare",

"improve-quality-gen-ai",

+ "nextgen-search-ai-opensearch-mcp",

]

},

+

{

title: "cursor",

collapsable: false,

@@ -2385,6 +2417,25 @@ module.exports = {

]

},

+ {

+ title: "codex",

+ collapsable: false,

+ sidebarDepth: 0,

+ children: [

+ "codex",

+ ]

+ },

+

+ {

+ title: "claude-code",

+ collapsable: false,

+ sidebarDepth: 0,

+ children: [

+ "claude-code-overview",

+ "claude-code-auto-mode",

+ ]

+ },

+

{

title: "kiro",

collapsable: false,

@@ -2430,6 +2481,9 @@ module.exports = {

sidebarDepth: 0,

children: [

"qoder",

+ "quest-autonomous-programming-agent-architecture-loop",

+ "qoderwork",

+ "qoder-update",

]

},

@@ -2439,6 +2493,7 @@ module.exports = {

sidebarDepth: 0,

children: [

"cline",

+ "changelog-cline",

]

},

@@ -2520,6 +2575,15 @@ module.exports = {

children: [

"a2a-a-new-era-of-agent-interoperability",

]

+ }],

+

+ "/md/AI/skills/": [{

+ title: "Skills",

+ collapsable: false,

+ sidebarDepth: 0,

+ children: [

+ "ovrview",

+ ]

},

],

@@ -2685,7 +2749,7 @@ module.exports = {

"【Java设计模式实战】单例模式",

"template-pattern",

"strategy-pattern",

- "建造者模式",

+ "builder-pattern",

"proxy-pattern",

"适配器模式",

"门面模式",

diff --git a/docs/.vuepress/public/tencent5343462181755789832.txt b/docs/.vuepress/public/tencent5343462181755789832.txt

new file mode 100644

index 0000000000..606901b039

--- /dev/null

+++ b/docs/.vuepress/public/tencent5343462181755789832.txt

@@ -0,0 +1 @@

+17130199513286176774

\ No newline at end of file

diff --git a/docs/.vuepress/styles/index.styl b/docs/.vuepress/styles/index.styl

index 3e91100ceb..dfe23713b6 100644

--- a/docs/.vuepress/styles/index.styl

+++ b/docs/.vuepress/styles/index.styl

@@ -30,4 +30,182 @@ h2

// sidebar

.sidebar

width: 18rem

- font-size: 15px

\ No newline at end of file

+ font-size: 15px

+

+body.dark-theme

+ color #d6deeb

+ background #0f1722

+

+body.dark-theme .theme-container

+ background #0f1722

+ color #d6deeb

+

+body.dark-theme .navbar

+ background #0f1722

+ border-bottom 1px solid #243142

+

+body.dark-theme .navbar .site-name

+ color #e6edf6

+

+body.dark-theme .navbar .links

+ background-color #0f1722

+

+body.dark-theme .navbar a,

+body.dark-theme .navbar .nav-links a,

+body.dark-theme .navbar .dropdown-wrapper .dropdown-title

+ color #c7d2e5

+

+body.dark-theme .navbar .nav-links a:hover,

+body.dark-theme .navbar .nav-links a.router-link-active,

+body.dark-theme .navbar .dropdown-wrapper .dropdown-title:hover

+ color #64d6a2

+

+body.dark-theme .navbar .dropdown-wrapper .dropdown-title .arrow

+ border-top-color #8ea3bf

+

+body.dark-theme .navbar .theme-toggle-btn

+ background-color #1a2433

+ border-color #33465f

+ color #e6edf6

+

+body.dark-theme .navbar .theme-toggle-btn:hover

+ background-color #243142

+

+body.dark-theme .navbar .dropdown-wrapper .nav-dropdown

+ background-color #121d2b

+ border 1px solid #33465f

+ border-bottom-color #33465f

+ box-shadow 0 8px 20px rgba(0, 0, 0, 0.35)

+

+body.dark-theme .navbar .dropdown-wrapper .nav-dropdown .dropdown-item

+ color #d6deeb

+

+body.dark-theme .navbar .dropdown-wrapper .nav-dropdown .dropdown-item h4

+ color #9fb0c7

+ border-top 1px solid #243142

+

+body.dark-theme .navbar .dropdown-wrapper .nav-dropdown .dropdown-item a

+ color #d6deeb

+

+body.dark-theme .navbar .dropdown-wrapper .nav-dropdown .dropdown-item a:hover,

+body.dark-theme .navbar .dropdown-wrapper .nav-dropdown .dropdown-item a.router-link-active

+ color #64d6a2

+

+body.dark-theme .sidebar .dropdown-wrapper .nav-dropdown

+ background-color transparent

+

+body.dark-theme .sidebar .dropdown-wrapper .nav-dropdown .dropdown-item h4

+ color #9fb0c7

+ border-top 1px solid #243142

+

+body.dark-theme .sidebar .dropdown-wrapper .nav-dropdown .dropdown-item a

+ color #d6deeb

+

+body.dark-theme .sidebar .dropdown-wrapper .nav-dropdown .dropdown-item a:hover,

+body.dark-theme .sidebar .dropdown-wrapper .nav-dropdown .dropdown-item a.router-link-active

+ color #64d6a2

+

+body.dark-theme .sidebar

+ background #121d2b

+ border-right 1px solid #243142

+

+body.dark-theme .sidebar .sidebar-link

+ color #d6deeb

+

+body.dark-theme .sidebar .sidebar-link.active

+ color #64d6a2

+

+body.dark-theme .sidebar .sidebar-sub-headers

+ background transparent

+

+body.dark-theme .page

+ background #0f1722

+ color #d6deeb

+

+body.dark-theme .page .theme-default-content

+ background #121d2b

+ color #d6deeb

+

+body.dark-theme .theme-default-content h1,

+body.dark-theme .theme-default-content h2,

+body.dark-theme .theme-default-content h3,

+body.dark-theme .theme-default-content h4,

+body.dark-theme .theme-default-content h5,

+body.dark-theme .theme-default-content h6

+ color #e6edf6

+

+body.dark-theme h1

+ border-bottom 1px solid #243142

+

+body.dark-theme blockquote

+ color #c7d2e5

+ border-left .5rem solid #64d6a2

+ background-color #1a2433

+

+body.dark-theme .page-edit,

+body.dark-theme .page-nav,

+body.dark-theme .page-contract

+ background #121d2b

+ color #d6deeb

+

+body.dark-theme .page-nav .inner

+ border-top 1px solid #243142

+

+body.dark-theme .theme-default-content pre,

+body.dark-theme .theme-default-content code

+ background-color #0b1220

+ color #d6deeb

+

+body.dark-theme .toc-container,

+body.dark-theme .toc-container-sidebar,

+body.dark-theme .sitemap-container

+ background #121d2b

+ color #d6deeb

+ border-color #243142

+

+body.dark-theme .toc-container-sidebar .scroll-box,

+body.dark-theme .toc-container .scroll-box

+ background #121d2b

+ color #d6deeb

+

+body.dark-theme .toc-container-sidebar .scroll-box > div,

+body.dark-theme .toc-container .scroll-box > div

+ color #dbe6f5

+

+body.dark-theme .toc-container-sidebar hr,

+body.dark-theme .toc-container hr

+ border-color #243142

+ border-top 1px solid #243142

+

+body.dark-theme .toc-container-sidebar .toc-box,

+body.dark-theme .toc-container .toc-box

+ background #121d2b

+

+body.dark-theme .toc-container-sidebar a.toc-sidebar-link,

+body.dark-theme .toc-container a.toc-sidebar-link

+ color #a9bad1

+ font-weight 400

+

+body.dark-theme .toc-container-sidebar .toc-sidebar-sub-headers a.toc-sidebar-link,

+body.dark-theme .toc-container .toc-sidebar-sub-headers a.toc-sidebar-link

+ color #8fa3bf

+

+body.dark-theme .toc-container-sidebar a.toc-sidebar-link:hover,

+body.dark-theme .toc-container-sidebar a.toc-sidebar-link.active,

+body.dark-theme .toc-container a.toc-sidebar-link:hover,

+body.dark-theme .toc-container a.toc-sidebar-link.active

+ color #6ee7b7

+

+body.dark-theme .toc-container-sidebar li,

+body.dark-theme .toc-container li

+ color #a9bad1

+

+body.dark-theme .page-side-toolbar div.option-box,

+body.dark-theme .page-side-toolbar div.option-box-toc-over,

+body.dark-theme .page-side-toolbar div.option-box-toc

+ background-color #121d2b

+ border-bottom 1px solid #243142

+

+body.dark-theme .page-side-toolbar div.option-box:hover,

+body.dark-theme .page-side-toolbar div.option-box-toc-over:hover

+ background #243142

diff --git a/docs/.vuepress/theme/components/Navbar.vue b/docs/.vuepress/theme/components/Navbar.vue

index 743a319c83..ee3f5dc7b7 100644

--- a/docs/.vuepress/theme/components/Navbar.vue

+++ b/docs/.vuepress/theme/components/Navbar.vue

@@ -32,6 +32,15 @@

/>

+

@@ -54,7 +63,8 @@ export default {

data () {

return {

- linksWrapMaxWidth: null

+ linksWrapMaxWidth: null,

+ isDarkTheme: false

}

},

@@ -81,6 +91,25 @@ export default {

}

handleLinksWrapWidth()

window.addEventListener('resize', handleLinksWrapWidth, false)

+ this.initTheme()

+ },

+

+ methods: {

+ initTheme () {

+ const savedTheme = window.localStorage.getItem('theme-mode')

+ this.isDarkTheme = savedTheme === 'dark'

+ this.applyTheme()

+ },

+

+ toggleTheme () {

+ this.isDarkTheme = !this.isDarkTheme

+ window.localStorage.setItem('theme-mode', this.isDarkTheme ? 'dark' : 'light')

+ this.applyTheme()

+ },

+

+ applyTheme () {

+ document.body.classList.toggle('dark-theme', this.isDarkTheme)

+ }

}

}

@@ -121,9 +150,25 @@ $navbar-horizontal-padding = 1.5rem

right $navbar-horizontal-padding

top $navbar-vertical-padding

display flex

+ align-items center

.search-box

flex: 0 0 auto

vertical-align top

+ .theme-toggle-btn

+ margin-left 0.8rem

+ width 2rem

+ height 2rem

+ border 1px solid $borderColor

+ border-radius 999px

+ background-color #fff

+ cursor pointer

+ font-size 0.95rem

+ line-height 1

+ padding 0

+ transition background-color .2s ease, border-color .2s ease

+ &:hover

+ background-color #f3f5f7

+ border-color darken($borderColor, 10%)

@media (max-width: $MQMobile)

.navbar

@@ -132,6 +177,9 @@ $navbar-horizontal-padding = 1.5rem

display none

.links

padding-left 1.5rem

+ .theme-toggle-btn

+ width 1.8rem

+ height 1.8rem

.site-name

width calc(100vw - 9.4rem)

overflow hidden

diff --git a/docs/md/AI/agent/changelog-cline.md b/docs/md/AI/agent/changelog-cline.md

new file mode 100644

index 0000000000..ab82ef65f5

--- /dev/null

+++ b/docs/md/AI/agent/changelog-cline.md

@@ -0,0 +1,98 @@

+# Cline 更新记录

+## v3.40.0

+

+- 当 Cline 完成任务时,新添加的Explain Changes "解释更改"按钮,可以帮助通过内联聊天审查代码。您可以回复评论,或将聊天作为上下文发送回 Cline。

+- 使用新的 / 斜杠命令来解释分支、提交等中的更改。(尝试让 Cline 解释您需要审查的 PR!)

+- 新的 `microwave` 隐形模型,限时免费!

+

+## v3.38

+

+- **MiniMax-M2** 目前在 Cline 中免费使用!

+- **Gemini 3 Pro 预览版** 现已上线,具备业界领先的推理与编程能力。

+- **AquaVoice 的 Avalon** 模型在 AISpeak 上的准确率高达 97.3%,现已用于语音转文字听写功能。

+

+## v3.34.1

+

+- 添加对 MiniMax 提供商的支持,包含 MiniMax-M2 模型

+- 移除 Cline/code-supernova-1-million 模型

+- 更改以在使用 OpenRouter 时允许用户手动输入模型名称(例如预设)

+

+## v3.34

+

+- Cline Teams 现在全年免费,适用于无限用户。包括 Jetbrains、RBAC、集中计费等。开始使用团队

+- 在 Cline 提供商模型选择器中使用 GLM-4.6、Kimi-K2 和 Qwen3-Coder 的“exacto”版本,以获得成本、速度、准确性和工具调用的最佳平衡。

+

+#### Cline for CLI 来了!

+

+安装以直接在终端中使用 Cline 并启用子代理功能。Cline 可生成 `cline` 命令来处理聚焦任务,如探索大型代码库以获取信息。这通过在单独的子进程中运行这些操作来保持你的主上下文窗口清洁。

+

+## v3.31

+

+- UI 改进:新的任务标题和焦点链设计,占用更少空间,带来更清爽的体验

+- 语音模式:实验性功能,需在设置中启用,以实现免提编码

+- YOLO 模式:在设置中启用,可让 Cline 自动批准所有操作,并在计划/执行模式间自动切换

+- JetBrains 更新:已为 Rider 提供支持,并根据所有反馈进行了大量改进!

+- 持续免费模型:试试 `grok-code-fast-1` 或 `code-supernova`(隐身模型 🥷)!

+

+## v3.30

+

+- 免费“隐身”模型 🥷:试用 code-supernova,为 Cline 打造的代理式编码模型,支持 20 万上下文窗口与多模态。

+- Grok 推广持续:免费 grok-code-fast-1 访问已延长

+- JetBrains 支持已上线:你可以在 IntelliJ IDEA、PyCharm、WebStorm、Android Studio、GoLand、PhpStorm 等所有 JetBrains 系列 IDE 中使用 Cline

+

+## v3.28

+

+- 扩展的 Grok 推广:免费 grok-code-fast-1 访问延长!我们发现这个模型正在以惊人的速度改进,并且仍然免费提供

+

+- GPT-5 优化:针对 GPT-5 模型系列的性能改进,微调系统提示

+

+- ESC 取消:使用 ESC 键快速键盘导航以取消操作

+

+- 修复了多个 Cline 窗口间的任务同步,`/deep-planning` 在 Windows/PowerShell 上的改进,Dify.ai 集成,DeepSeek-V3.1 支持,增强的 Gemini 速率限制,以及多个提供商修复

+

+## v3.27

+

+免费 `grok-code-fast-1` 直到9月10日

+

+我们与xAI合作,从头开始构建这个模型用于代理编码,到目前为止——社区反馈令人难以置信。xAI正在通过更多使用不断改进模型的智能,所以今天就试试吧,让我们知道你的想法!

+

+## v3.26

+

+- 免费隐身模型:拥有 262K 上下文窗口的先进隐身模型,专为复杂编码任务设计,在 Cline 提供商中可免费使用。

+

+- Z AI 提供商:全新的 API 提供商,提供 GLM-4.5 和 GLM-4.5 Air 模型,性能卓越,价格极具竞争力,特别针对中文语言任务和通用编程辅助进行了优化。

+

+- 增强的 LM Studio 支持:改进对 LM Studio 本地模型的支持,兼容 v0 API 端点,并可配置最大令牌数,实现更佳的自定义体验。

+

+## v3.25

+

+- **专注链:** 通过自动TODO事项列表管理,让 Cline 专注于长期任务,将复杂任务分解为可管理的步骤,并提供实时进度跟踪和被动提醒。步骤显示在便捷的待办事项列表中,可在任务执行过程中进行编辑。

+- **自动压缩:** 当对话接近模型的上下文窗口限制时,自动总结您的任务和下一步操作。这显著帮助 Cline 在长时间任务会话中保持专注!

+- **深度规划:** 新的 `/deep-planning` 斜杠命令将 Cline 转变为架构师,它会调查您的代码库,提出澄清问题,并在编写任何代码之前创建全面的计划。

+- **Claude Sonnet 4 的 1M 上下文:** Cline/OpenRouter 用户可立即访问,Anthropic 用户需要 Tier 4,Bedrock 用户必须在支持的区域。选择 `claude-sonnet-4:1m` 模型获得 1M 上下文,或使用原版获得 200K。

+- 工作流(Workflows):创建和**管理工作流文件**;可通过**斜杠命令**注入到对话中;轻松实现**重复性任务的自动化**

+

+

+## v3.23

+

+- **GPT-5支持:** 添加了对新 GPT-5 模型系列的支持,包括 GPT-5、GPT-5 Mini 和 GPT-5 Nano,并支持提示缓存。GPT-5 现在是新用户的默认模型

+- **改进的入门体验:** 新用户现在会看到"开始导览"按钮,打开 VSCode 演练以帮助他们更轻松地开始使用 Cline。

+- **增强的计划模式:** 在计划模式中更好地支持探索参数,在执行前进行更彻底的规划。

+

+## v3.20

+

+- __Cerebras 提供商支持:__ 通过更新的模型选择(仅限 Qwen 和 Llama 3.3 70B)和将 Qwen 3 32B 的上下文窗口从 16K 增加到 64K 令牌来增强性能。

+- __Windows 版 Claude Code:__ 改进了系统提示处理以修复 E2BIG 错误,并为常见设置问题提供了更好的错误消息和指导。

+- __Hugging Face 提供商:__ 添加为新的 API 提供商,支持其推理 API 模型。

+- __Moonshot 中文端点:__ 为 Moonshot 提供商添加了选择中文端点的功能,并将 Moonshot AI 添加为新提供商。

+- __增强稳定性:__ 强大的检查点超时处理,修复了禁用时 MCP 服务器启动的问题,并改进了多个 VSCode 窗口间的身份验证同步。

+- __Gemini CLI 提供商:__ 添加了新的 Gemini CLI 提供商,允许您使用本地 Gemini CLI 身份验证免费访问 Gemini 模型。

+- __WebFetch 工具:__ Gemini 2.5 Pro 和 Claude 4 模型现在支持 WebFetch 工具,允许 Cline 直接在对话中检索和总结网页内容。

+- __自我认知:__ 使用前沿模型时,Cline 对自己的能力和功能集有自我认知。

+- __改进的差异编辑:__ 改进了差异编辑,为前沿模型实现了创纪录的低差异编辑失败率。

+- __Claude 4 模型:__ 现在支持 Anthropic Claude Sonnet 4 和 Claude Opus 4,在 Anthropic 和 Vertex 提供商中均可使用。

+- __新设置页面:__ 重新设计的设置,现在分为选项卡以便更轻松的导航和更清洁的体验。

+- __Nebius AI Studio:__ 添加 Nebius AI Studio 作为新提供商。(感谢 @Aktsvigun!)

+- __工作流:__ 创建和管理可通过斜杠命令注入到对话中的工作流文件,使自动化重复任务变得容易。

+- __可折叠任务列表:__ 在共享屏幕时隐藏您的最近任务,以保持提示的私密性。

+- __Vertex AI 全球端点:__ 为 Vertex AI 用户改进了可用性并减少了速率限制错误。

\ No newline at end of file

diff --git a/docs/md/AI/agent/claude-code-auto-mode.md b/docs/md/AI/agent/claude-code-auto-mode.md

new file mode 100644

index 0000000000..01455dcf67

--- /dev/null

+++ b/docs/md/AI/agent/claude-code-auto-mode.md

@@ -0,0 +1,125 @@

+# 从手动审批到智能决策:Claude Code 自动模式如何拦截 80%+ 的危险越界行为

+

+Claude Code 的用户会批准 93% 的权限请求。我们构建了一些分类器来自动化部分决策,在提升安全性的同时减少频繁审批带来的疲劳。下面介绍它能拦住什么,拦不住什么。

+

+默认,Claude Code 在执行命令或修改文件前都会请求用户批准。这能保障安全,但也意味着用户频繁点击"批准"。时间一长,审批疲劳,人们就不再认真查看自己批准的内容。

+

+用户通常有两种方式避免疲劳:

+

+- 使用内置沙箱,将工具隔离以防止危险操作

+- 用 `--dangerously-skip-permissions` 参数,完全关闭权限提示,让 Claude 自由执行,但这在大多情况不安全

+

+## 1 方式权衡

+

+- 沙箱安全但维护成本高,每增加一种能力都要额外配置,且涉及网络或主机访问时就无法隔离

+- 跳过权限则无需维护,但完全没有保护

+- 手动审批介于两者之间,但实际上用户还是会批准 93% 的请求

+

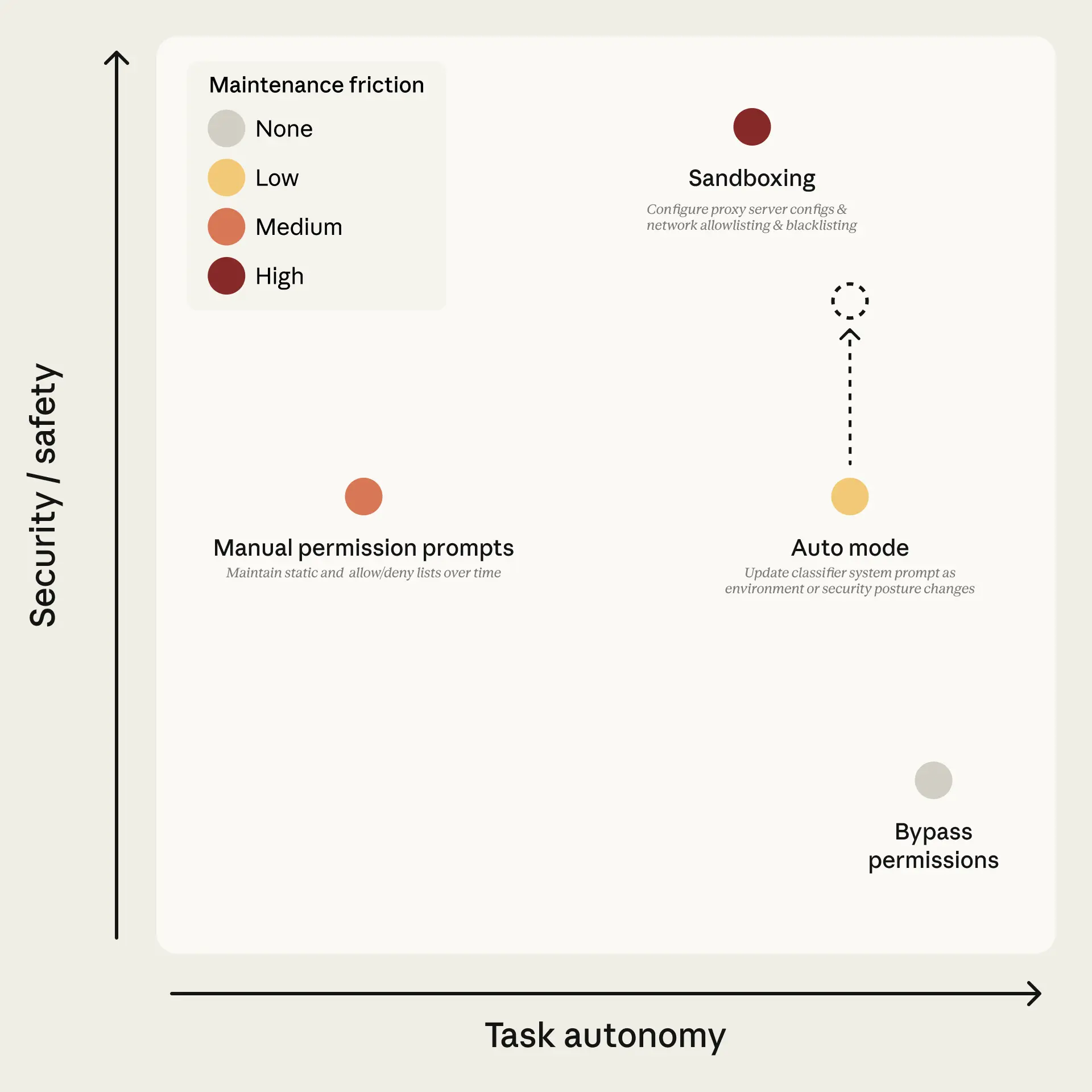

+Claude Code 的权限模式,按任务自主性和安全性划分。点的颜色表示维护成本。自动模式的目标是在低维护成本实现高自主性;虚线箭头表示随分类器覆盖范围和模型判断能力提升,安全性会逐步提高。

+

+我们维护了一份内部事件日志,专门记录智能体不当行为。案例包括:因为误解指令而删除远程 Git 分支、把工程师的 GitHub 认证令牌上传到内部计算集群、尝试对生产数据库执行迁移等。这些问题本质都源于模型"过度积极",在用户未明确授权是自行采取行动。在 [Claude Opus 4.6 系统卡](https://www-cdn.anthropic.com/14e4fb01875d2a69f646fa5e574dea2b1c0ff7b5.pdf)(§6.2.1 和 §6.2.3.3)记录了这一模式。

+

+自动模式是 Claude Code 的一种新模式,它通过基于模型的分类器来代替人工审批,介于手动审核和完全无防护之间。目标是拦住那些偏离用户意图的危险操作,同时让其他操作无需提示直接执行。可按[文档](http://code.claude.com/docs/en/permission-modes#eliminate-prompts-with-auto-mode)开始使用自动模式。

+

+## 2 工作原理

+

+自动模式采用两层防护:

+

+- 一层针对 Claude 读取的内容

+- 另一层针对 Claude 执行的操作

+

+### 输入层

+

+一个服务器端的提示注入检测器会扫描工具输出(如文件读取、网页抓取、Shell 输出或外部工具响应),在这些内容进入模型上下文前进行检查。如果检测到疑似劫持行为的内容,它会在传递结果时附加警告,提醒模型对这些内容保持怀疑,并以用户的真实需求为准。

+

+### 输出层

+

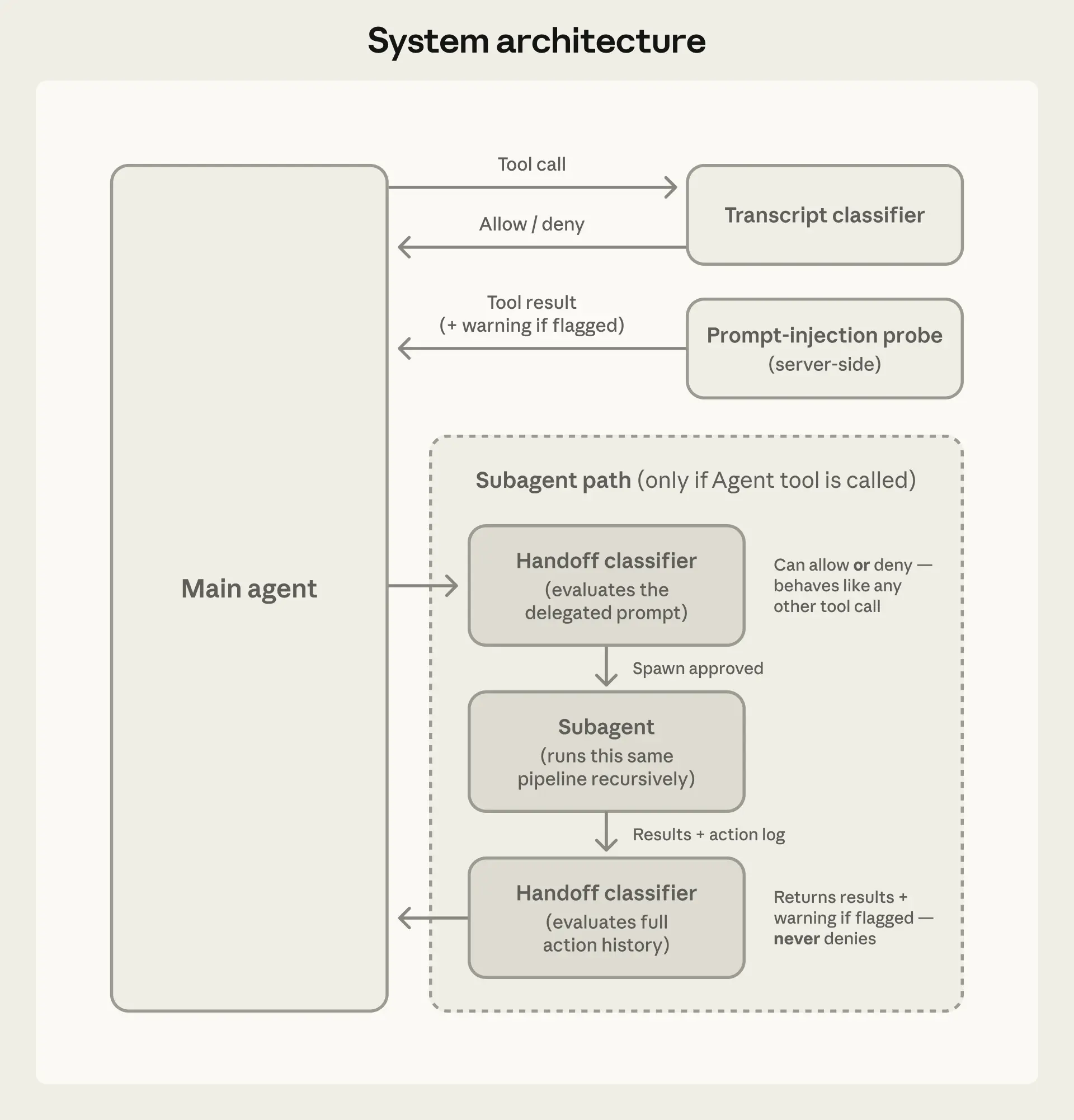

+一个运行在 Sonnet 4.6 上的"对话分类器"会在每个操作执行前进行评估,相当于替代人工审批。分类器分两阶段运行:

+

+- 第一阶段是一个快速的单 token 过滤器(输出"允许"或"阻止")

+- 如果被标记,则进入第二阶段进行带推理的详细判断

+

+由于大多操作在第一阶段就能通过,只有少数情况才消耗推理资源。分类器只看到用户消息和工具调用,不包含 Claude 自己的回复或工具输出,这使它在设计上对推理内容"不可见"。

+

+系统架构。对话分类器控制工具调用;提示注入检测器筛查工具结果。子代理会递归使用同样流程,在任务分发时和返回时分别由分类器进行检查。

+

+## 3 威胁模型

+

+智能体可能因为以下四种原因执行危险操作:

+

+1. **过度积极**:模型理解用户目标并试图帮忙,但采取了超出用户授权的行动,例如使用偶然发现的凭证或删除它认为"碍事"的内容。这类行为难以检测,因为它看起来像合理的解决方案,只是越界了。

+2. **无意错误**:模型误判影响范围,例如把共享资源当作测试资源。

+3. **提示注入攻击**:文件、网页或工具输出中嵌入的指令劫持模型行为,使其偏离用户任务。

+4. **模型目标错位**:模型追求自身目标(目前尚未在实践中观察到,但仍持续评估)。

+

+在这些情况下,防御策略都是阻止操作。分类器主要针对前两类问题进行优化,但同样适用于其他威胁。

+

+示例展示自动模式试图拦截的行为:

+

+- **范围扩大**:用户说"清理旧分支",模型却删除了远程分支。这种不可逆操作会被阻止。

+- **凭证搜索**:遇到认证错误后,模型开始在环境变量和配置文件中搜索 API token,会被阻止。

+- **自行推断参数**:用户说"取消我的任务",模型自行匹配并删除任务,会被阻止。

+- **外部共享**:将脚本上传到 GitHub Gist,会被视为数据外泄而阻止。

+- **绕过安全检查**:部署失败后加上跳过验证参数重试,会被阻止。

+

+## 4 权限决策流程

+

+并非所有操作都会进入分类器,大部分会在前两层被直接允许:

+

+**第一层:内置安全工具白名单与用户设置。** 包括只读操作(文件读取、搜索、代码导航等)。用户也可以配置"始终允许"的规则。但在自动模式下,会移除那些可能导致任意代码执行的宽泛规则(如通配的 shell 或脚本解释器调用),以确保分类器能看到潜在危险操作。

+

+**第二层:项目内文件操作。** 在项目目录内的修改可以直接执行,不经过分类器,因为这些操作可以通过版本控制审查。

+

+**第三层:对话分类器。** 只有具有潜在风险的操作(如 shell 命令、外部访问、项目外文件操作等)才会进入这一层。

+

+## 5 分类器的判断标准

+

+分类器使用一个固定模板,其中包含三处可自定义内容:

+

+固定部分定义了如何判断操作的真实影响,以及如何理解用户授权。核心原则是评估操作的实际效果,而不是表面形式,并且默认只有用户明确授权的行为才是允许的。

+

+可自定义部分包括:

+

+- **环境定义**:界定哪些资源是"可信内部",哪些是外部。

+- **阻止规则**:默认包含 20 多条规则,如数据破坏、外泄、安全性下降等。

+- **例外规则**:在特定情况下允许本应被阻止的操作。

+

+## 6 效果评估

+

+我们在三类数据集上进行了测试,包括真实流量、真实过度行为案例和模拟数据外泄任务。

+

+| | **真实流量** n=10,000 | **过度行为** n=52 | **模拟外泄** n=1,000 |

+| -------------------- | --------------------- | ----------------- | -------------------- |

+| 第一阶段(快速过滤) | 误报率 8.5% | 漏报率 6.6% | 漏报率 1.8% |

+| 全流程(两阶段) | 误报率 0.4% | 漏报率 17% | 漏报率 5.7% |

+

+两阶段流程显著降低了误报,但会增加一定漏报率。

+

+17% 的漏报率意味着仍有部分危险操作未被拦截,主要问题在于分类器难以准确判断用户是否真的授权了某个具体操作。

+

+## 7 设计决策

+

+### 为什么不让分类器看到模型回复和工具输出

+

+防止模型通过"说服"分类器来放行危险操作,同时也减少提示注入攻击的影响。实验表明,这种简化输入反而提升了性能。

+

+### 两阶段分类

+

+- 第一阶段偏保守,提高召回率

+- 第二阶段通过推理降低误报,在性能和成本之间取得平衡

+

+### 提示注入检测的重要性

+

+输入层检测与输出层分类器配合,使攻击必须同时绕过两道防线,大大增加难度。

+

+### 多代理协作

+

+在任务分发和结果返回时都进行检查,防止子代理被利用。

+

+### 拒绝但继续执行

+

+当操作被阻止时,模型不会停下来,而是尝试寻找更安全的替代方案。如果连续多次被拒绝,才会交由人工处理。

+

+## 8 后续计划

+

+我们会继续扩展测试数据集,并改进模型表现。自动模式并不完美,但相比完全无防护的运行方式,已经显著提升了安全性。对于高风险场景,仍建议人工审核。

diff --git a/docs/md/AI/agent/claude-code-overview.md b/docs/md/AI/agent/claude-code-overview.md

new file mode 100644

index 0000000000..4fa56b457e

--- /dev/null

+++ b/docs/md/AI/agent/claude-code-overview.md

@@ -0,0 +1,82 @@

+# Claude Code 完整安装与上手指南,让 AI 住进你的终端

+

+Prerequisites: 先决条件:一个 [Claude.ai](https://claude.ai/) (推荐)或 [Claude Console](https://console.anthropic.com/) 帐户。

+

+## 1 安装

+

+### 1.1 本地安装(推荐)

+

+macOS, Linux, WSL: macOS、Linux、WSL

+

+```bash

+curl -fsSL https://claude.ai/install.sh | bash

+

+

+✔ Claude Code successfully installed!

+

+ Version: 2.0.72

+

+ Location: ~/.local/bin/claude

+

+

+ Next: Run claude --help to get started

+

+⚠ Setup notes:

+ • Native installation exists but ~/.local/bin is not in your PATH. Run:

+

+ echo 'export PATH="$HOME/.local/bin:$PATH"' >> ~/.zshrc && source ~/.zshrc

+

+

+✅ Installation complete!

+```

+

+Windows PowerShell: Windows PowerShell:

+

+```bash

+irm https://claude.ai/install.ps1 | iex

+```

+

+Windows CMD: Windows 命令提示符:

+

+```bash

+curl -fsSL https://claude.ai/install.cmd -o install.cmd && install.cmd && del install.cmd

+```

+

+### 1.2 Homebrew

+

+```bash

+brew install --cask claude-code

+```

+

+### 1.3 npm

+

+如果您已[安装 Node.js 18 或更高版本 ](https://nodejs.org/en/download/):

+

+```bash

+npm install -g @anthropic-ai/claude-code

+```

+

+## 2 开始使用

+

+```bash

+cd your-project

+claude

+```

+

+首次使用时,系统会提示您登录。就是这样

+

+Claude Code 会自动保持更新。有关安装选项、手动更新或卸载说明,请参阅[高级设置 ](https://code.claude.com/docs/en/setup)。如果遇到问题,请访问[故障排除](https://code.claude.com/docs/en/troubleshooting)页面。

+

+## 3 能做啥?

+

+- **根据描述构建功能** :用简洁明了的英语告诉 Claude 你想构建什么。它会制定计划、编写代码并确保其正常运行。

+- **调试和修复问题** :描述错误或粘贴错误信息。Claude Code 将分析您的代码库,找出问题并进行修复。

+- **轻松驾驭任何代码库** :您可以询问任何关于团队代码库的问题,并获得周全的解答。Claude Code 能够全面了解您的项目结构,从网络上获取最新信息,并且借助 [MCP](https://code.claude.com/docs/en/mcp) 功能,还可以从 Google Drive、Figma 和 Slack 等外部数据源提取数据。

+- **自动化繁琐任务** :修复繁琐的代码检查问题、解决合并冲突、编写发布说明。所有这些操作都可以在您的开发机器上通过一条命令完成,或者在持续集成 (CI) 环境中自动完成。

+

+## 4 为啥喜欢?

+

+- **直接在终端运行** :无需打开聊天窗口,也无需打开集成开发环境 (IDE)。Claude Code 与您现有的工作环境完美契合,使用您熟悉的工具。

+- **执行操作** :Claude Code 可以直接编辑文件、运行命令和创建提交。需要更多功能? [MCP](https://code.claude.com/docs/en/mcp) 让 Claude 可以读取 Google 云端硬盘中的设计文档、更新 Jira 中的工单,或使用*您*自定义的开发者工具。

+- **Unix 哲学** :Claude 代码是可组合和可脚本化的。 `tail -f app.log | claude -p "Slack me if you see any anomalies appear in this log stream"` 可以*运行* 。你的 CI 可以运行 `claude -p "If there are new text strings, translate them into French and raise a PR for @lang-fr-team to review"` 。

+- **企业级就绪** :可用 Claude API,或托管在 AWS 或 GCP 上。内置企业级[安全性 ](https://code.claude.com/docs/en/security)、[ 隐私性](https://code.claude.com/docs/en/data-usage)和合[规性 ](https://trust.anthropic.com/)。

\ No newline at end of file

diff --git a/docs/md/AI/agent/codex.md b/docs/md/AI/agent/codex.md

new file mode 100644

index 0000000000..2bc5addcf6

--- /dev/null

+++ b/docs/md/AI/agent/codex.md

@@ -0,0 +1,81 @@

+# 从写代码到指挥智能体团队:Codex macOS 应用正式发布!

+

+## 0 前言

+

+

+

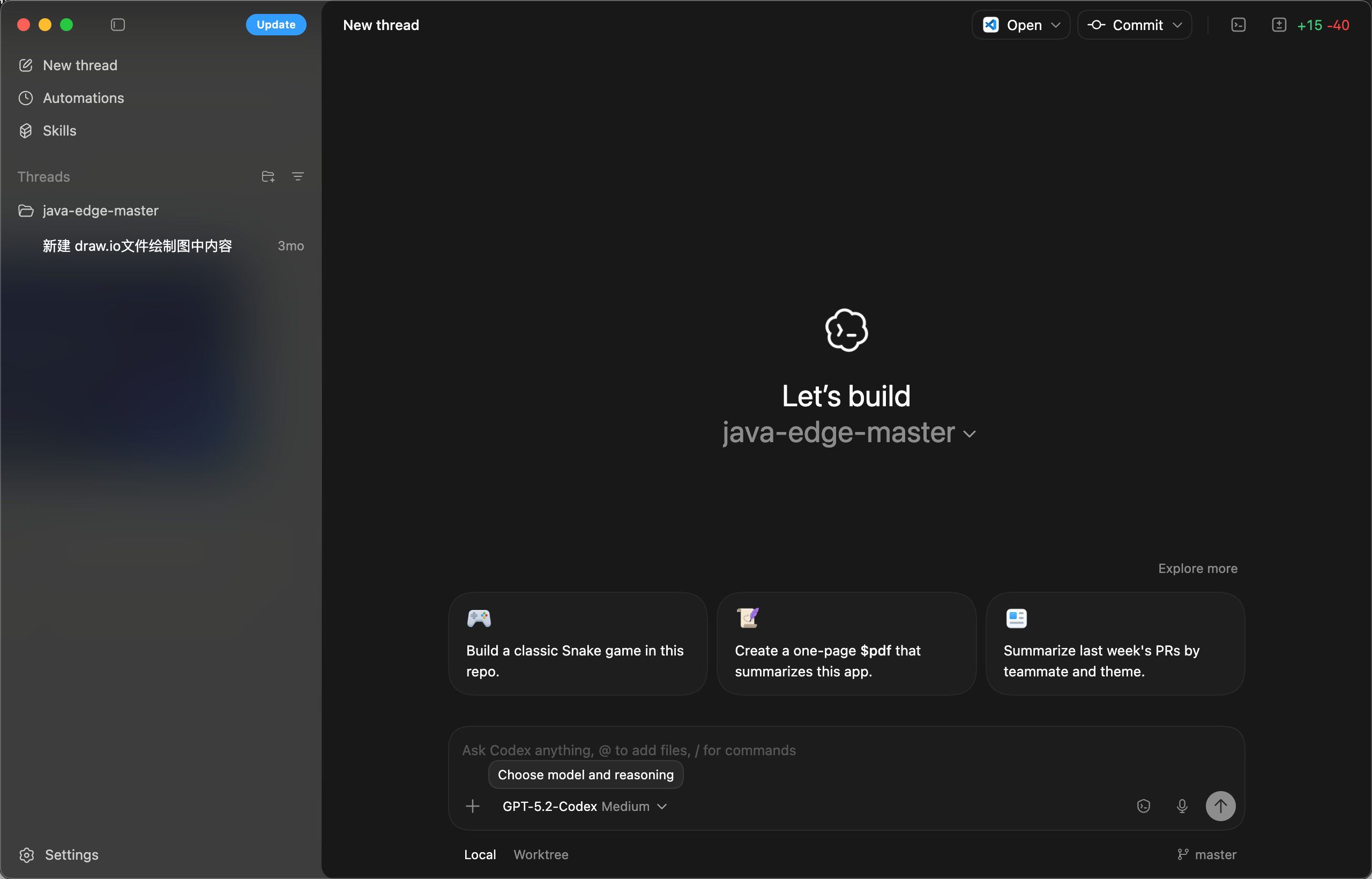

+通过全新的 macOS 版 Codex 应用,大幅提升开发者能力。

+

+今天,推出适用于 macOS 的 Codex 应用。这是一个强大的新界面,旨在轻松管理多个智能体、并行运行工作,并与智能体协作完成长时间任务。

+

+限时为 ChatGPT 免费版和 ChatGPT Go 用户提供 Codex,并将 ChatGPT Plus、Pro、Business、Enterprise 和 Edu 速率额度翻倍。更高的额度适用于你在任何地方使用 Codex,包括应用内、CLI、你的 IDE 中,以及云端。

+

+Codex 应用正在改变软件的开发方式以及谁可以开发:从与单个智能体配对进行有针对性的编辑,到在设计、开发、发布和维护软件的完整生命周期中监督并协调智能体团队。

+

+## 1 Codex 应用:智能体的指挥中心

+

+自 2025 年 4 月推出 Codex 以来,开发者与智能体协作的方式发生了根本性变化。模型现在能够端到端处理复杂且长时间运行的任务,开发者也在多个项目中协调多个智能体:委派工作、并行运行任务,并让智能体承担可能持续数小时、数天或数周的大型项目。核心挑战已从智能体能做什么,转变为人们如何以更大规模指挥、监督它们并与其协作。现有的 IDE 和基于终端的工具并非为支持这种工作方式而设计。

+

+这种全新的构建方式与新的模型功能相结合,要求一种不同类型的工具,这就是推出 Codex 桌面应用的原因 — 它是智能体的指挥中心。

+

+### 1.1 与多个智能体并行协作

+

+Codex 应用为智能体进行多任务处理提供了一个专注的空间。智能体在按项目组织的独立线程中运行,因此你可以在任务之间无缝切换,而不会丢失上下文。该应用允许你查看线程中智能体的更改、对差异发表评论,甚至可以在编辑器中打开以进行手动更改。

+

+它还包括对工作树的内置支持,因此多个智能体可以在同一个代码库上工作而不会发生冲突。每个智能体都在代码的一个独立副本上工作,使你能够探索不同的路径,而不必跟踪它们对代码库的影响。当智能体工作时,你可以在本地查看更改,或者让它在不影响本地 Git 状态的情况下继续进行。

+

+该应用程序会从 Codex CLI 和 IDE 扩展中提取你的会话历史和配置,因此你可以立即开始将其用于现有项目。

+

+### 1.2 以skill突破代码生成的界限

+

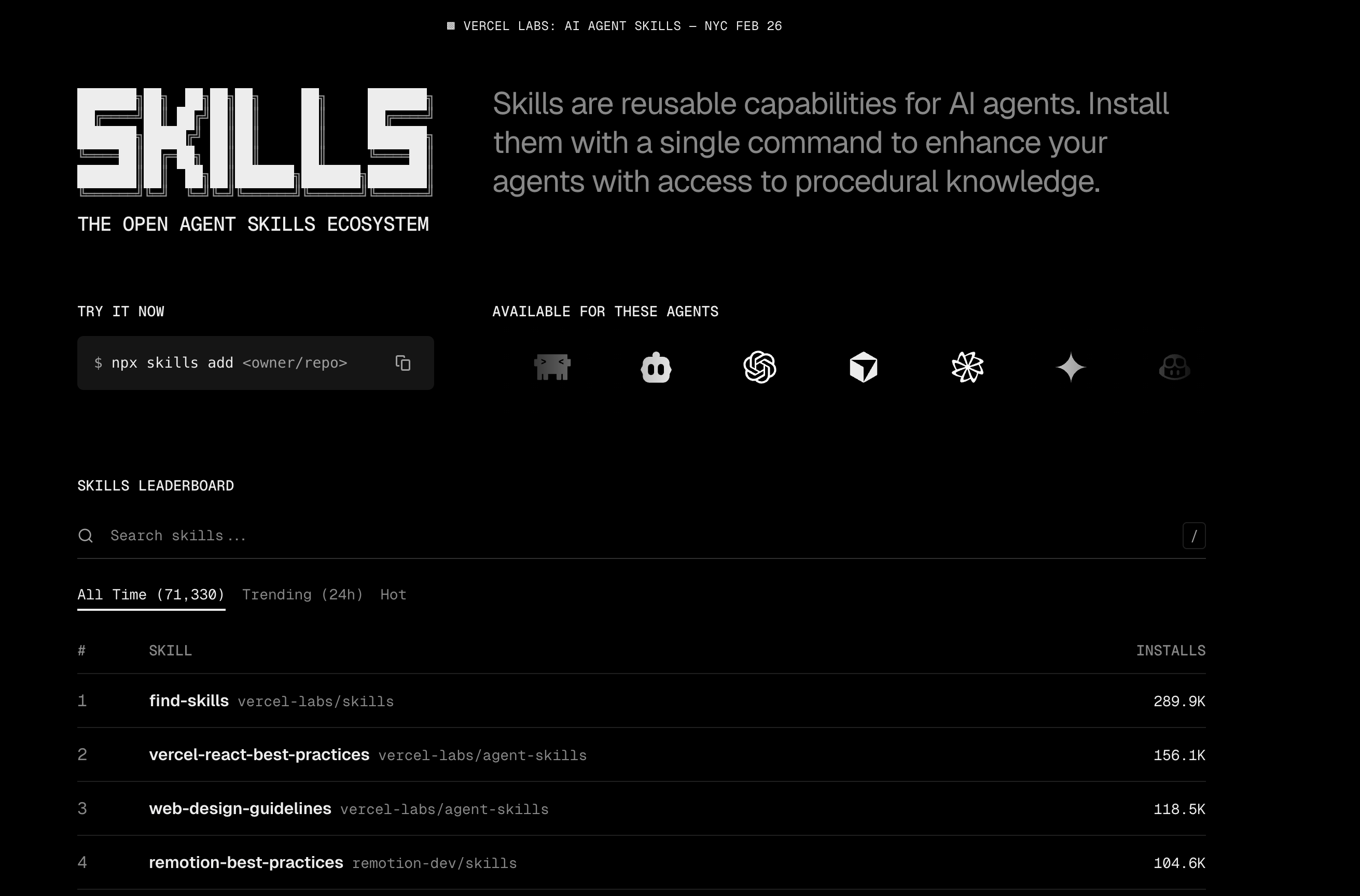

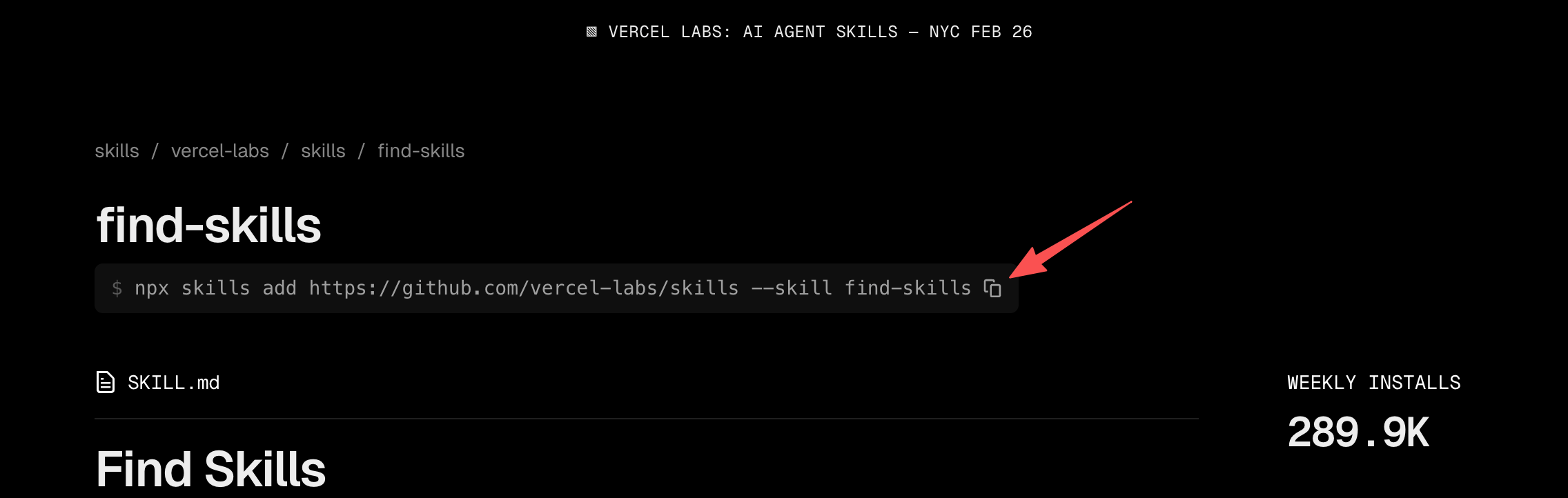

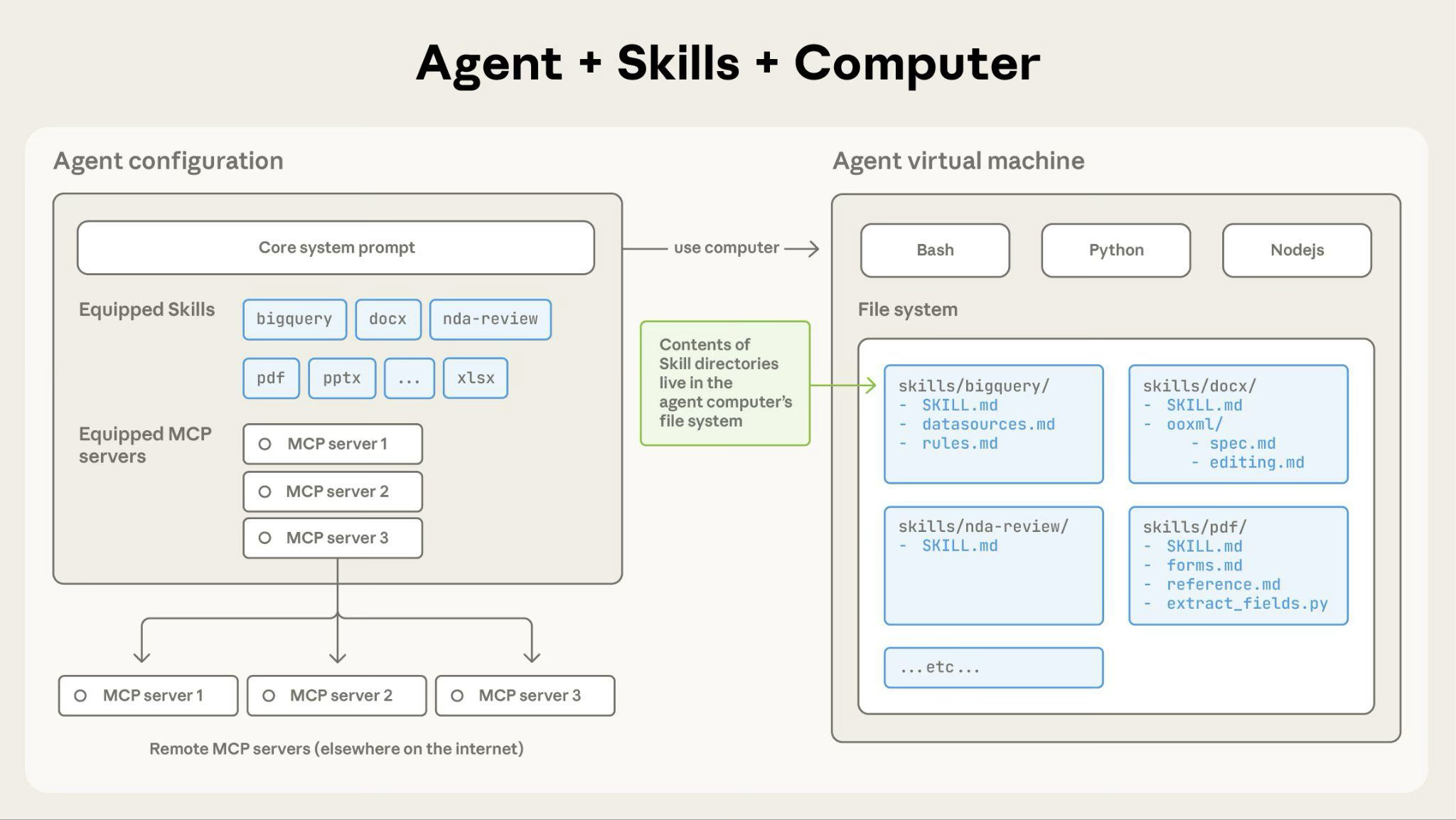

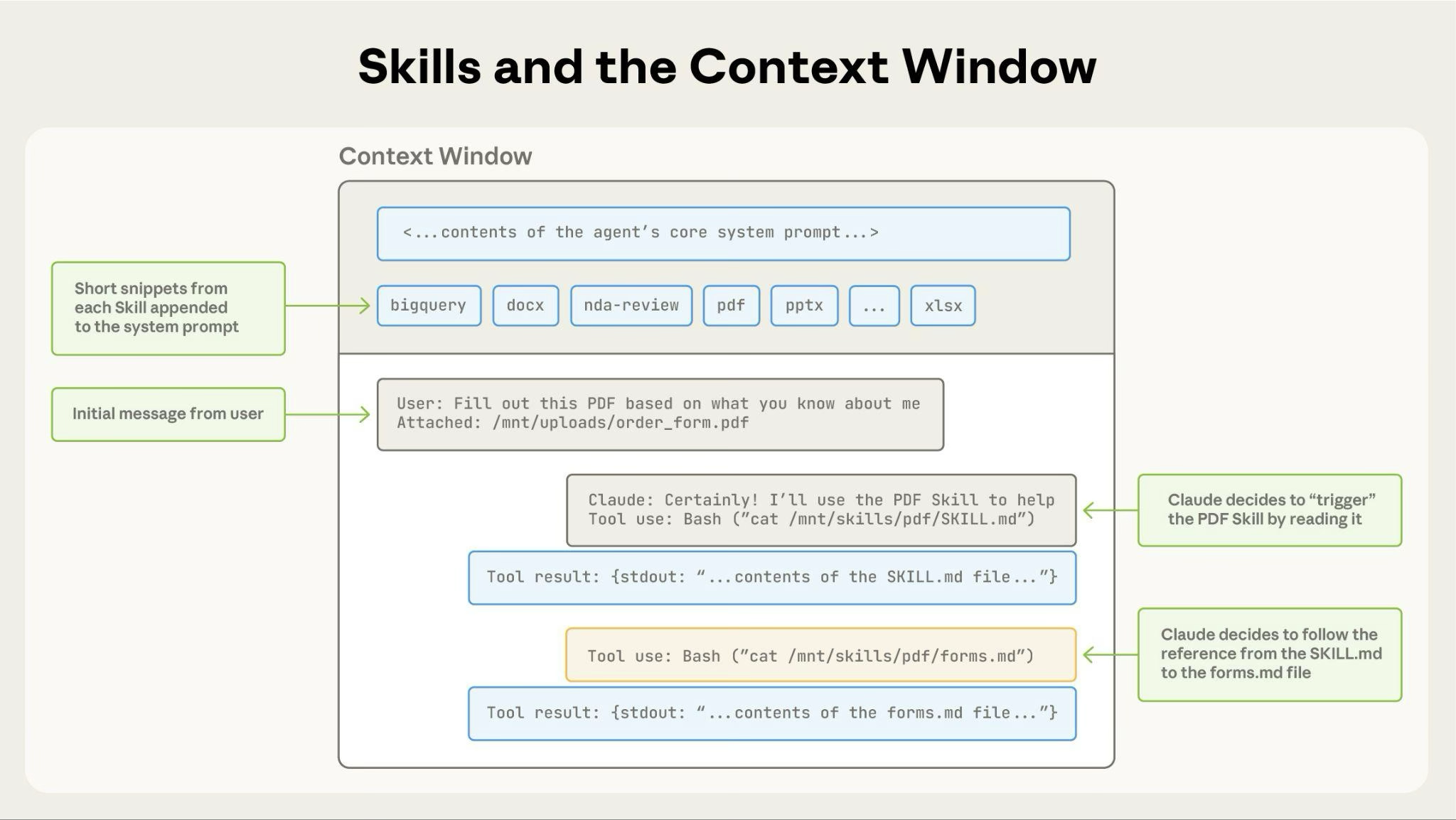

+Codex 正在从一个编写代码的智能体,进化为能在你的电脑上利用代码完成任务的智能体。借助[skill](https://agentskills.io/home),可轻松将 Codex 的能力从代码生成扩展到信息收集与整合、问题解决、写作等更多类型的任务。

+

+skill包将说明、资源和脚本整合在一起,使 Codex 可靠连接到工具、运行工作流,并根据你团队的偏好完成任务。Codex 应用包含一个专用界面,用于创建和管理skill。可明确要求 Codex 使用特定skill,或让它根据当前任务自动使用这些skill。

+

+...案例见官网。

+

+OpenAI 内部开发了数百项skills,帮助多个团队自信地将工作委托给 Codex,这些工作通常难以一致定义 — 从运行评估、监控训练任务,到起草文档和报告增长实验。

+

+Codex 应用包括一个skill库,涵盖在 OpenAI 广受欢迎的工具和工作流程,下面重点介绍其中的几个。你可以在[开源仓库](https://github.com/openai/skills)中找到完整列表。

+

+- **实现设计:**从 [Figma](https://github.com/openai/skills/blob/main/skills/.curated/figma-implement-design/SKILL.md) 获取设计上下文、资源和截图,并将其转换为生产就绪的 UI 代码,确保 1:1 的视觉一致性。

+- **管理项目:**在 [Linear](https://github.com/openai/skills/blob/main/skills/.curated/linear/SKILL.md) 中分流处理缺陷、跟踪版本发布、管理团队工作负载等,确保项目顺利进行。

+- **部署到云端**:让 Codex 将你的 Web 应用创作部署到热门云托管平台,如 [Cloudflare](https://github.com/openai/skills/blob/main/skills/.curated/cloudflare-deploy/SKILL.md)、[Netlify](https://github.com/openai/skills/blob/main/skills/.curated/netlify-deploy/SKILL.md)、[Render](https://github.com/openai/skills/blob/main/skills/.curated/render-deploy/SKILL.md) 和 [Vercel](https://github.com/openai/skills/blob/main/skills/.curated/vercel-deploy/SKILL.md)。

+- **生成图像:**使用由 GPT 图像提供支持的[图像生成功能](https://github.com/openai/skills/blob/main/skills/.curated/imagegen/SKILL.md)来创建和编辑图像,以用于网站、UI 模型、产品视觉效果和游戏素材。

+- **使用 OpenAI API 构建:**在使用 OpenAI API 开发时,[请参考最新文档](https://github.com/openai/skills/blob/main/skills/.curated/openai-docs/SKILL.md)。

+- **创建文档:**一套skill,用于读取、创建和编辑 [PDF](https://github.com/openai/skills/blob/main/skills/.curated/pdf/SKILL.md)、[电子表格](https://github.com/openai/skills/blob/main/skills/.curated/spreadsheet/SKILL.md)和 [docx](https://github.com/openai/skills/blob/main/skills/.curated/doc/SKILL.md) 文件,具备专业的格式和布局。

+

+当你在应用中创建一个新skill时,Codex 可以在你工作的任何地方使用,包括应用内、CLI,或你的 IDE 扩展中。你也可以将skill提交到代码仓库,让整个团队都能使用。点击[此处](https://developers.openai.com/codex/enterprise/admin-setup#team-config),了解更多关于使用团队配置共享skill的信息。

+

+### 1.3 通过自动化功能来处理重复性工作

+

+使用 Codex 应用,还可设置自动化功能 (Automation),让 Codex 能够按照自动化功能的时间表在后台运行。自动化功能将指令与可选skill结合,并按你设定的时间表运行。当一个自动化功能完成后,结果会进入审核队列,这样你可以在需要时返回并继续工作。

+

+OpenAI一直在使用自动化功能来处理那些重复但重要的任务,例如每日问题分流、查找并总结 CI 失败、生成每日发布简报、检查漏洞等。

+

+

+设置一个自动化流程以定期创建新skill

+

+### 1.4 适合你工作方式的个性选项

+

+开发者在与智能体协作的方式上有不同的偏好。有些人想要一个直截了当、以执行为导向的合作伙伴;另一些人则喜欢更具沟通性、更有参与感的互动。Codex 现在让开发者可以在两种个性之间进行选择 — 简洁、务实的风格,以及更具对话感、更富同理心的风格。它们能力一样,旨在契合你最喜欢的方式。你只需在应用、CLI 和 IDE 扩展中使用 /personality 命令。

+

+详细了解如何在[文档](http://developers.openai.com/codex/app)中设置和使用 Codex 应用。

+

+## 2 默认安全,设计可配置

+

+正在整个 Codex 智能体中整合安全设计。Codex 应用与 Codex CLI 一样,使用原生、[开源](https://github.com/openai/codex)且可配置的系统级沙盒。默认情况下,Codex 智能体仅限于在其工作文件夹或分支中编辑文件,并使用缓存的网页搜索,然后在需要提升权限(如网络访问)时请求许可以运行命令。你可为项目或团队[配置规则](https://developers.openai.com/codex/rules),允许特定命令在需要时自动以更高权限运行。

+

+## 3 可用性与定价

+

+Codex 应用从今天起可在 macOS 上使用。任何拥有 ChatGPT Plus、Pro、Business、Enterprise 或 Edu 订阅的用户,都可以使用其 ChatGPT 登录在 CLI、网页、IDE 扩展和应用中使用 Codex。ChatGPT 订阅中已包含试用额度,如有需要,可以选择购买额外的额度。

+

+在有限时间内,Codex 也将向 ChatGPT 免费版和 ChatGPT Go 用户开放,让人们可使用智能体进行更多构建。所有付费套餐的现有 Codex 用户将速率额度翻倍。

+

+## 4 下一步发展

+

+企业和开发者越来越依赖 Codex 进行端到端开发。自 12 月中旬推出 GPT‑5.2-Codex 以来,Codex 整体使用量翻了一番。在过去一个月中,超过一百万名开发者在用 Codex。将继续扩展开发者使用 Codex 的平台和方式,包括在 Windows 提供该应用,提升模型的前沿能力,并打造速度更快的推理功能。

+

+针对该应用程序,将根据实际反馈不断改进多智能体工作流,使并行工作管理更为简便,并能在不同智能体之间切换而不丢失上下文。也在开发支持云端触发器的自动化功能,这样 Codex 就能在后台持续运行,而不仅仅是在你的电脑开着时。

+

+Codex 基于一个简单前提:所有事物都由代码控制。智能体在推理和生成代码方面越出色,它在所有形式的技术和知识型工作中就越有能力。然而,当今的一个关键挑战是前沿模型的能力与人们在实践中使用它们的便捷性之间的差距。Codex 旨在弥合这一差距,使我们更容易引导、监督模型,并将模型的全部智能应用于实际工作。专注将 Codex 打造成最优秀编码智能体,这也为其成为一款强大的智能体奠定了基础,使其能够胜任广泛的知识型工作任务,这些任务不仅限于编写代码。

\ No newline at end of file

diff --git a/docs/md/AI/agent/nextgen-search-ai-opensearch-mcp.md b/docs/md/AI/agent/nextgen-search-ai-opensearch-mcp.md

new file mode 100644

index 0000000000..4c8d1c4182

--- /dev/null

+++ b/docs/md/AI/agent/nextgen-search-ai-opensearch-mcp.md

@@ -0,0 +1,323 @@

+# 下一代搜索:AI 与 OpenSearch 的融合 —— 基于 MCP 的智能搜索

+

+## 0 关键要点

+

+- 随着传统关键词搜索逐渐达到瓶颈,行业正转向语义化、多模态、对话式和智能体(Agentic)AI 搜索。这种新型搜索能理解用户意图与上下文,让用户无需掌握技术或编写应用,就能用自然语言获取洞察。

+- 基于 OpenSearch、LLM(大型语言模型)和 Model Context Protocol(MCP,模型上下文协议)构建的上下文感知型对话搜索解决方案,是下一代智能搜索的关键。MCP 负责在 AI 智能体与 OpenSearch 之间建立桥梁。

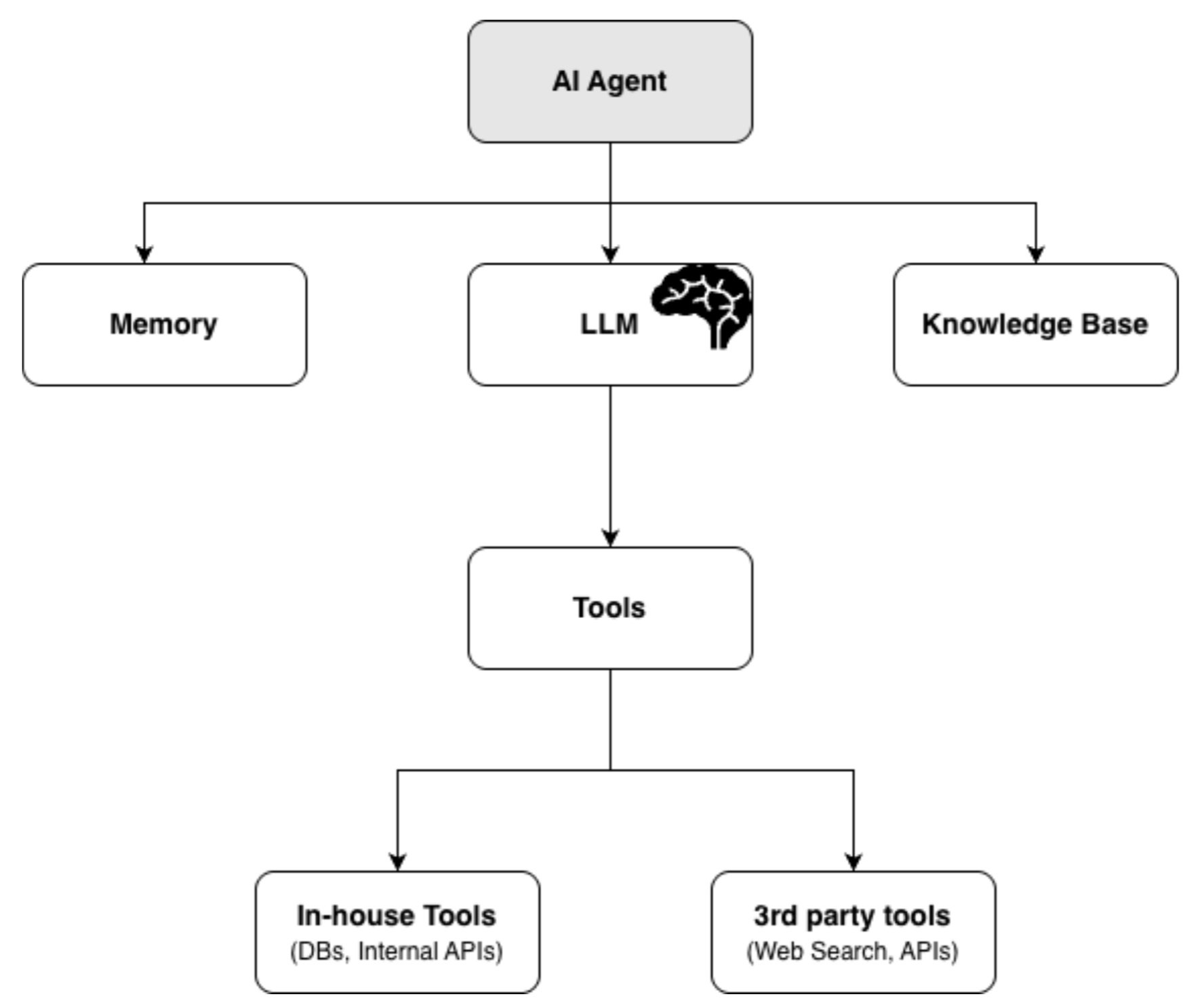

+- AI 智能体是一类具备角色、任务与上下文管理能力的专用 AI 应用。典型的智能体系统包含 LLM(推理核心)、记忆模块(维持上下文)、工具(扩展能力)和 RAG(检索增强生成),可在交互中动态检索相关信息。

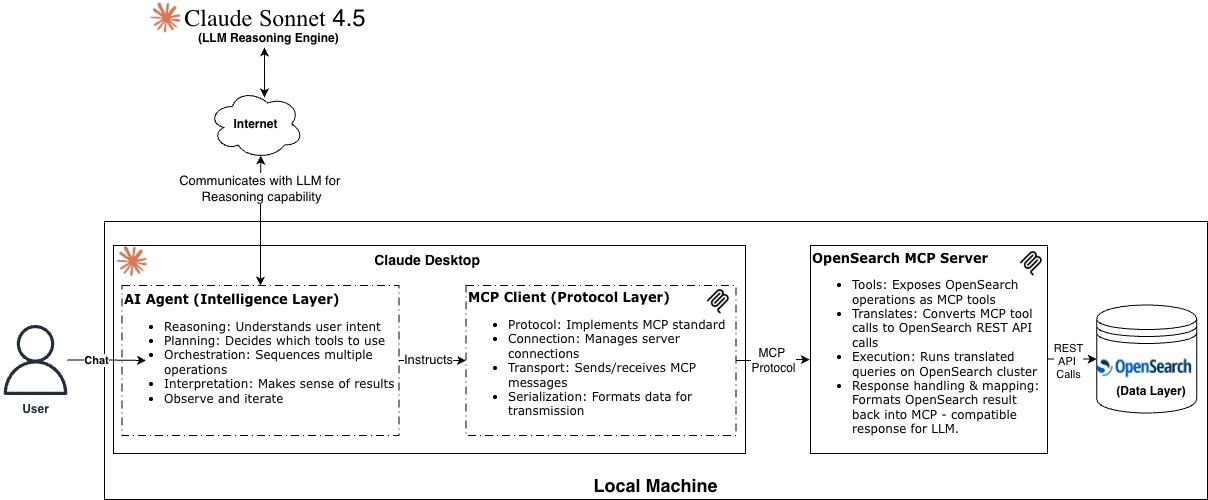

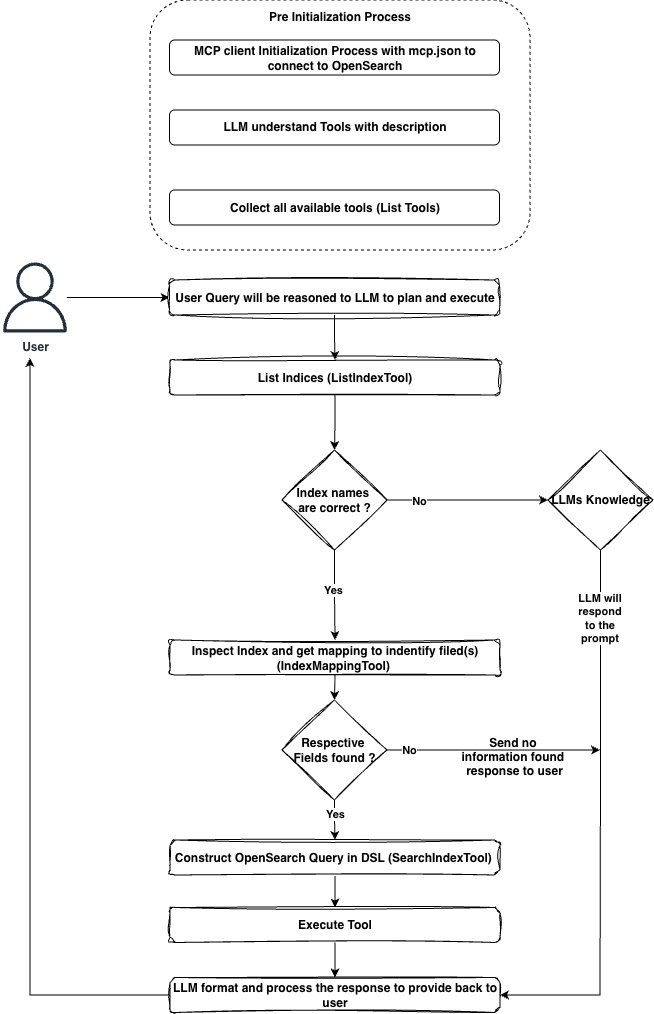

+- 所提架构由三层组成:智能体层(智能核心)、MCP 协议层(MCP 客户端与服务器通信)、数据层(索引、搜索与分析)。

+- MCP 服务器支持多种部署方式,包括本地、远程、混合(本地+云)以及云原生部署。不同模式可根据企业需求平衡安全、成本与性能。

+

+## 1 引言

+

+想象一位销售主管用自然语言问系统:“请显示本季度收入最高的十款产品,并预测下个月的销售趋势。” 系统能在几秒内给出完整洞察,而不必等 BI 团队数天出报告。

+

+又或者你问:“为什么我的应用延迟很高?” 系统不仅会返回日志与指标,还会自动分析错误原因、性能瓶颈及最近的部署关联。

+

+这就是“下一代智能体搜索”的体验。借助 LLM 驱动的 AI 智能体,通过标准化协议(如 MCP)与数据系统交互,实现真正的对话式、上下文感知搜索。

+

+本文将介绍 MCP 如何连接 AI 智能体与 OpenSearch 构建智能搜索系统;并回顾搜索技术的演进、架构组成及实际实现案例。

+

+## 2 OpenSearch 与行业应用

+

+[OpenSearch](https://opensearch.org/) 是一套开源搜索与分析系统,广泛用于日志分析、实时应用监控和网站搜索。截至目前,下载量近 [9 亿次](https://opensearch.org/announcements/opensearch-3-0-enhances-vector-database-performance/),并有数千名贡献者和 [14 家核心成员](https://opensearch.org/blog/driving-community-contributions/),包括 [AWS](https://aws.amazon.com/opensearch-service/)、SAP、Oracle 等。根据 [DB-Engines 排名](https://db-engines.com/en/ranking/search+engine),OpenSearch 已跻身全球前五大搜索引擎。

+

+从电商搜索到可观测性平台,OpenSearch 在多个行业支持关键字、语义和日志分析场景。下面看看搜索技术是如何一步步演进的。

+

+## 3 搜索的演进:从关键词到智能体

+

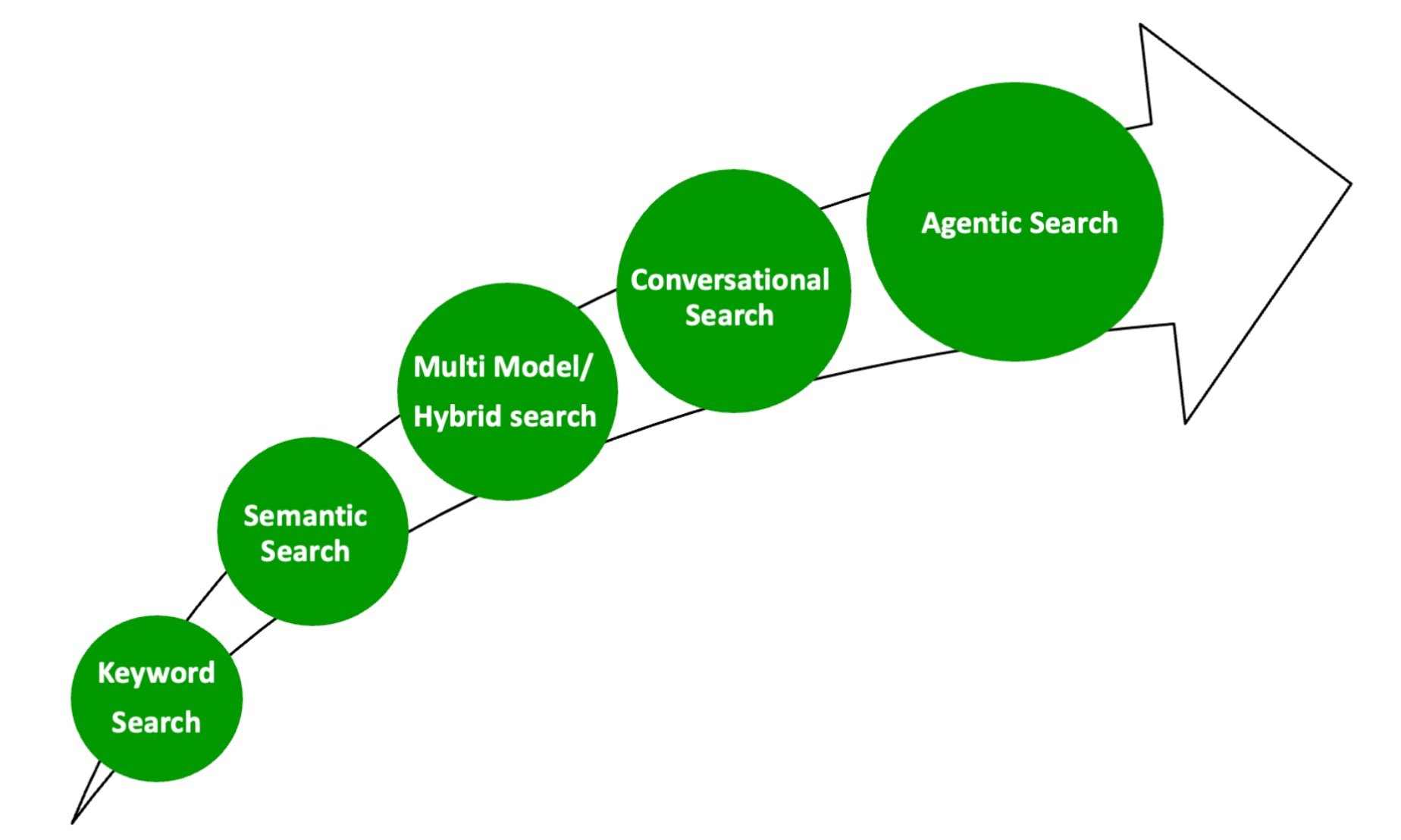

+搜索技术演进:

+

+

+

+### 3.1 关键词搜索

+

+又称“词法搜索”,是最传统的搜索方式,即通过精确的词或短语匹配。OpenSearch 默认使用 [TF-IDF 或 Okapi BM25F](https://kmwllc.com/index.php/2020/03/20/understanding-tf-idf-and-bm-25/) 算法(即 [Lucene](https://lucene.apache.org/) 索引)。这种方法快速、确定且与语言无关,但忽略了用户意图和上下文。

+

+例如,搜索“*男士黑色夹克*”可能会返回包含“*穿黑衬衫的男人*”或“*其他颜色夹克*”的结果。

+

+您可以在 [Hugging Face](https://huggingface.co/opensearch-project) 上的 [OpenSearch AI 演示](https://huggingface.co/spaces/opensearch-project/OpenSearch-AI) 中尝试关键词搜索,方法是选择搜索类型为 "keyword search"。

+

+### 3.2 语义搜索

+

+语义搜索比关键词搜索更智能,它在执行查询时会考虑用户意图与上下文。此方式将文本转为向量嵌入(数值表示),形成 [向量数据库](https://opensearch.org/platform/vector-engine/)。OpenSearch 支持多种[预训练模型](https://docs.opensearch.org/latest/ml-commons-plugin/pretrained-models/),可将文本、图片、音频、视频等数据转为向量。

+

+在同样的查询下(如“男士黑色夹克”),语义搜索将仅返回真正相关的结果。

+

+您可以在 Hugging Face 上的 OpenSearch AI 演示中尝试关键词搜索,方法是选择搜索类型为 "vector search"。

+

+### 3.3 多模态或混合搜索

+

+多模态搜索结合关键词与语义搜索结果,还能同时检索文字与图片等不同数据类型。用户可在同一结果中看到文本与图片匹配的内容。

+

+例如,在演示页面,[Hugging Face](https://huggingface.co/opensearch-project) 上的 [OpenSearch AI 演示](https://huggingface.co/spaces/opensearch-project/OpenSearch-AI),您可能会看到同时显示关键词和图像的结果。&

+

+### 3.4 对话式搜索

+

+[对话式搜索](https://docs.opensearch.org/latest/vector-search/ai-search/conversational-search/) 允许用户用自然语言提问(如问答形式)。LLM 支撑这种交互,但需借助记忆系统保存上下文:

+

+- 可使用 ChatGPT、Claude 等 LLM 的会话内置记忆;

+- 或使用外部数据库(如 PostgreSQL、Redis、OpenSearch)or [Agentic Frameworks](https://docs.aws.amazon.com/prescriptive-guidance/latest/agentic-ai-frameworks/frameworks.html) (e.g., LangChain, Strands, LlamaIndex)保存长时记忆。

+

+结合 [RAG 技术](https://opensearch.org/blog/using-opensearch-for-retrieval-augmented-generation-rag/),LLM 能连接外部数据源(如 OpenSearch),为查询补充实时信息。

+

+通常,用户明确说明需要搜索什么,并从 OpenSearch 检索数据。它最适合简单到中等查询和直接的信息检索。

+

+关键区别在于记忆(内置或外部)维护对话历史以保持上下文连续性。同时,RAG 通过从外部数据源检索相关信息来增强 LLM 响应,以提供更准确和最新的答案。

+

+### 3.5 智能体搜索(Agentic Search)

+

+[智能体搜索](https://docs.opensearch.org/latest/vector-search/ai-search/agentic-search/index/) 是对话式搜索的进化版。智能体具备记忆、推理、任务编排能力,可自主决定在 OpenSearch 上执行的步骤,如搜索、分析、关联、执行等。

+

+智能体可访问多个数据源,通过 [Model Context Protocol(MCP)](https://modelcontextprotocol.io/docs/getting-started/intro) 协调多种工具完成查询任务。

+

+OpenSearch 中的 [智能体搜索](https://docs.opensearch.org/latest/vector-search/ai-search/agentic-search/index/) 将帮助您用自然语言提问,如简单英语。

+

+智能体搜索是对话式搜索的超集。与对话式搜索不同,智能体将具有内置记忆能力,并使用 LLM 推理能力编排任务工作流,并在 OpenSearch 上做出查询执行决策。这些任务包括搜索、分析、关联和执行。智能体还将根据需要自主迭代工作流计划。

+

+智能体搜索可以通过编排多个工具来连接多个数据源,以进行信息检索并增强响应。通过智能体搜索,用户可以保持对话完整,并通过 [Model Context Protocol](https://modelcontextprotocol.io/docs/getting-started/intro) 在 OpenSearch 上执行 [工具](https://huggingface.co/learn/agents-course/en/unit1/tools)(又称任务),这将在本文后续部分讨论。

+

+在深入探讨下一代智能体搜索架构和实现细节之前,让我们看看智能体如何在智能体 AI 应用架构中发挥关键作用。

+

+## 4 什么是 AI 智能体?

+

+AI 智能体(专用 AI 应用)是配备了角色、任务和上下文管理能力的大型语言模型。一个典型的 AI 智能体集成了用于推理的 LLM、用于维持交互相关上下文的记忆、用于扩展能力的工具,以及用于选择性知识检索的 RAG,所有这些都旨在通过仅检索相关信息并保留关键细节来高效管理 LLM 的有限上下文窗口。给定一个任务,智能体通过与可用工具的迭代推理来实现目标,同时动态管理进入上下文窗口的信息以优化响应生成。

+

+

+

+**Figure 2: AI 智能体的核心架构**

+

+让我们回顾两个流行的 OpenSearch 业务用例,以了解 OpenSearch 智能体搜索将如何帮助。

+

+| **搜索用例:销售分析师创建执行销售报告**销售分析师(AI 智能体)负责为执行领导层创建每周销售绩效报告。AI 智能体利用分析管理器(LLM 编排器),它充当大脑并指导:**分析什么**(按类别每周销售、热门产品、客户趋势和营销活动影响),**在哪里查找**(销售数据库、库存系统、营销平台、客户分析),**如何调查**(生成查询以聚合销售数据、关联活动并比较趋势)一旦执行计划准备就绪,AI 智能体通过 MCP 使用可用工具:销售数据库(Salesforce)查询收入、订单和产品绩效电子商务平台(MySQL)API 检索库存水平和客户订单详情营销平台(SAP ERP)API 审查活动绩效并关联销售高峰AI 智能体还可能使用参考文档(知识库/RAG),例如:销售报告模板和 KPI 定义数据库模式和字段定义历史销售报告和季节性模式业务规则(例如,如何定义“活跃客户”)第 2 天,如果执行官(用户)需要参考第 1 天按类别的销售摘要,AI 智能体会记住(记忆)第 1 天的发现,并继续上下文感知的对话。 | **可观测性用例:DevOps 工程师调查生产中断**DevOps 工程师(AI 智能体)负责调查和解决生产应用性能问题。AI 智能体利用事件管理器(LLM 编排器),它充当大脑并指导,**调查什么**(慢查询日志、API 延迟指标、最近部署),**在哪里查找**(应用可观测性信息,如日志、指标、跟踪),**如何调查**(生成查询以分析错误日志与延迟指标和跟踪,并将其与最近部署时间线关联)一旦执行计划准备就绪,AI 智能体通过 MCP 使用可用工具:OpenSearch 查询应用日志、指标和跟踪GitHub API 审查最近代码部署以进行关联PagerDuty API(或其他)关联相关警报AI 智能体还可能使用参考文档(知识库/RAG),例如:故障排除运行手册系统架构设计文档历史事件和解决方案第 2 天,如果 DevOps 工程师(AI 智能体)需要参考第 1 天事件应用的补丁,AI 智能体会记住(记忆)第 1 天的发现,并继续上下文感知的对话。 |

+| ------------------------------------------------------------ | ------------------------------------------------------------ |

+| | |

+

+## 5 为什么需要智能体?

+

+### LLM:昨日的大脑问题

+

+大型语言模型功能模型(FMs)在大量语料库上训练,但没有实时数据信息。因此,单独使用 LLM 就像使用昨日的大脑。RAG 通过连接 LLM 到外部数据源(如 OpenSearch 或 RDBMS 等)来解决这个问题。

+

+例如,如果 DevOps 工程师询问实时应用性能指标或生产应用的洞察。LLM 单独无法提供信息。LLM 需要使用现有数据存储如 OpenSearch 来增强响应,提供实时洞察。

+

+传统 RAG 要求用户指定确切查询,并从单一来源一步检索。AI 智能体通过自主推理问题、通过 MCP 编排多个数据源(例如 OpenSearch、GitHub、CloudWatch)、关联发现并迭代直到找到解决方案来增强 RAG。

+

+### 会话记忆

+

+LLM 单独不存储用户对话历史。LLM 独立处理每个提示,而不保留之前的交互。智能体可以通过各种记忆机制维护对话历史,如[短期和长期记忆](https://www.ibm.com/think/topics/ai-agent-memory#498277086)。

+

+因此,需要设置记忆与外部数据库,并使用 RAG 技术保持对话。从 OpenSearch 3.3 开始,[智能体记忆](https://docs.opensearch.org/latest/ml-commons-plugin/agentic-memory/)作为内置功能提供。[现代 AI 智能体](https://aws.amazon.com/blogs/machine-learning/amazon-bedrock-agentcore-memory-building-context-aware-agents/)框架带有内置记忆,无需维护单独数据库。

+

+### 知识库

+

+LLM 没有您公司的专有数据。您可以将公司数据作为知识库提供给 LLM。LLM 使用此知识库通过 RAG 技术增强其响应。

+

+### 工具

+

+每个智能体将有某些工具,通过利用 LLM 的推理和规划能力来执行任务。例如,OpenSearch 提供了一[套工具](https://docs.opensearch.org/latest/ml-commons-plugin/agents-tools/tools/index/),执行搜索、分析、关联和执行等任务。您也可以使用智能体框架实现自己的智能体工具。

+

+## 6 开发 AI 智能体的挑战

+

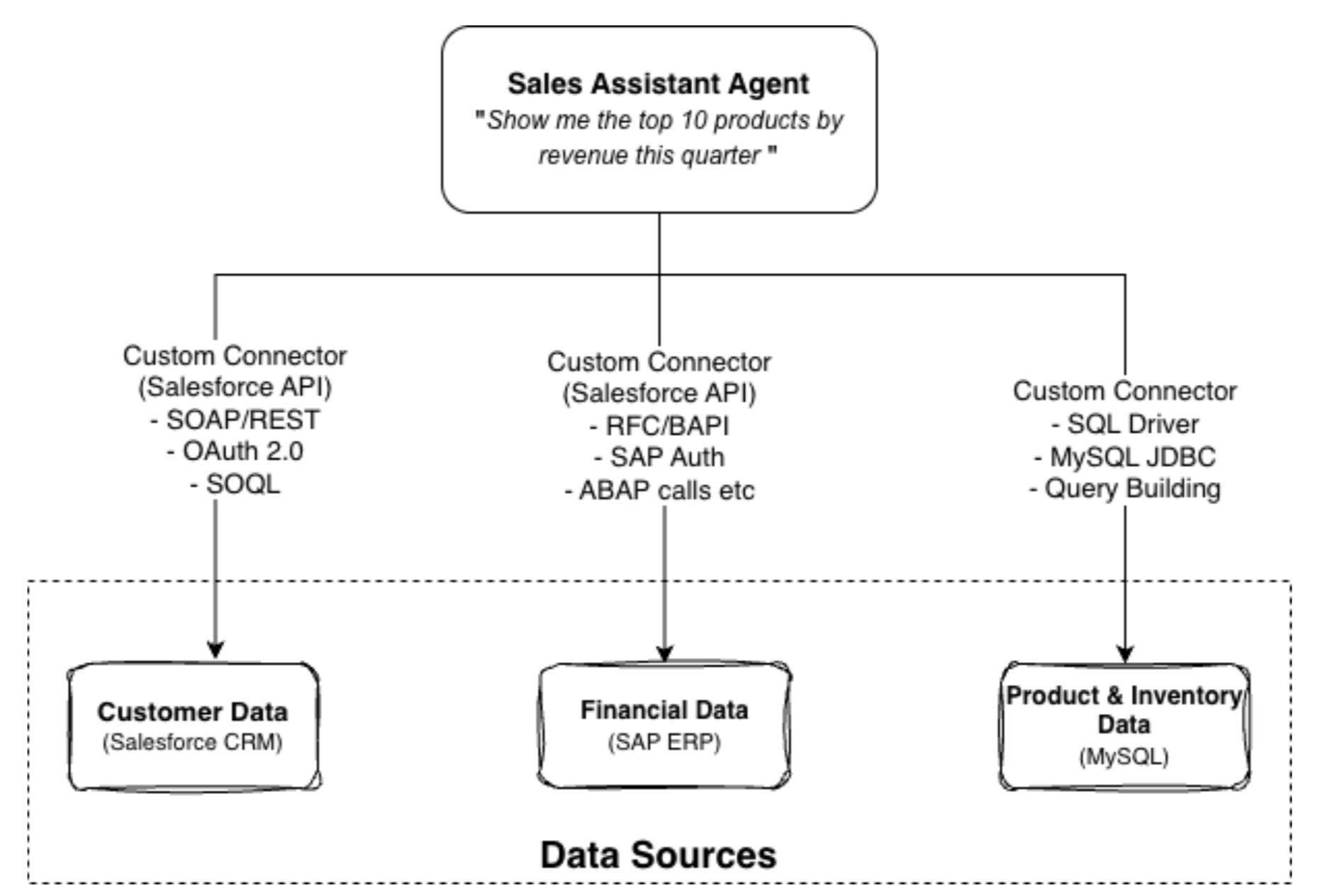

+构建 AI 智能体是一项简单任务,但将其与现有系统如数据库和 Web 服务集成很复杂。每个用例都需要实现特定 API 或另一种与相应服务的集成方式。例如,数据库使用 JDBC 连接,Web 服务使用 REST API 调用。

+

+如前几节所述,销售助手智能体使用不同的连接器连接到不同数据源以执行全面分析。

+

+

+

+**Figure 3: 使用自定义连接器每个数据源的销售助手智能体**

+

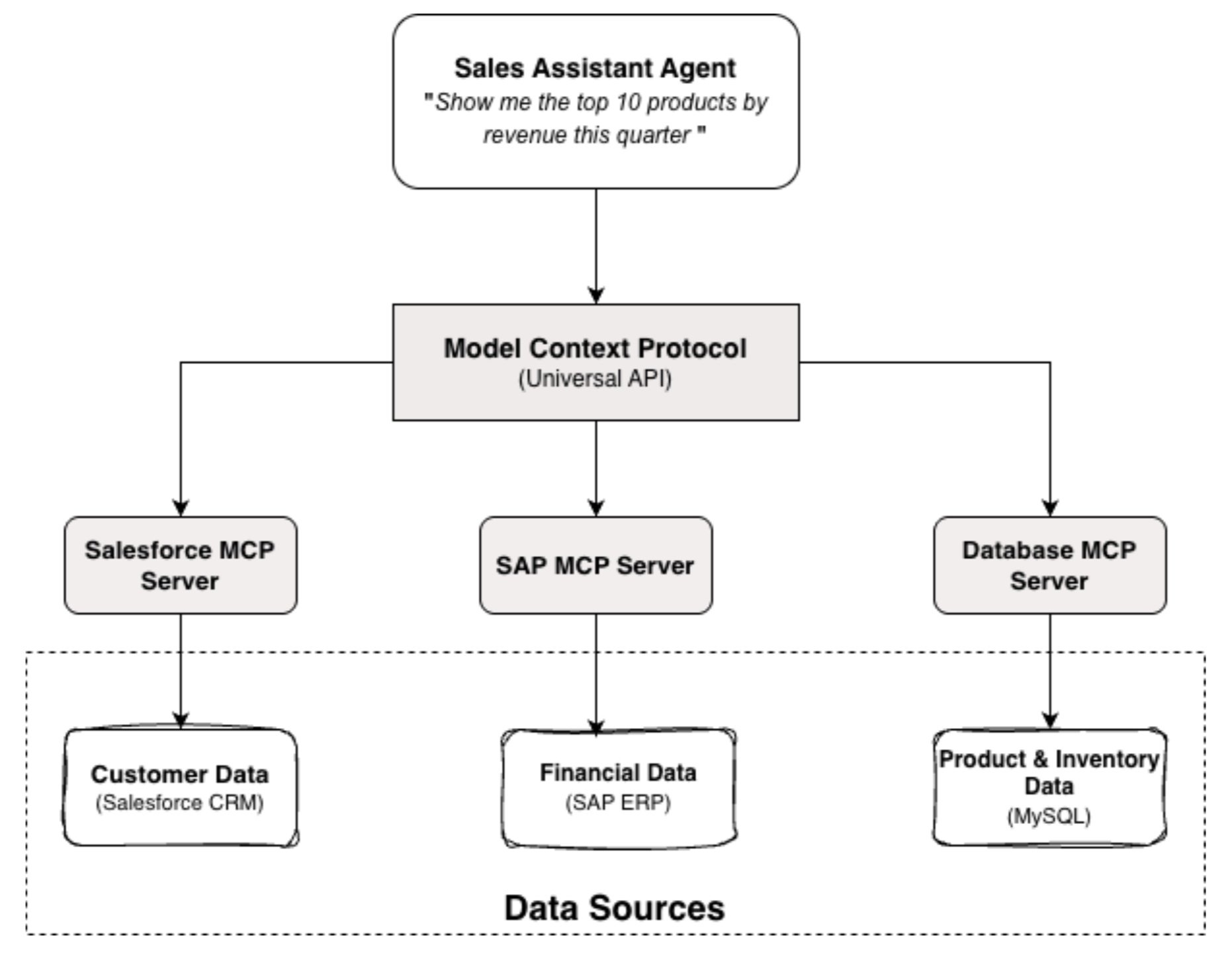

+MCP将帮助克服这种复杂性,提供单一和简化的连接方式(通用方式)。

+

+## 7 MCP:通用连接器

+

+MCP 提供统一的 API 来连接不同服务,使 AI 智能体集成无缝。MCP 设置有两个组件。

+

+- **Model Context Protocol**:一个开源、标准化和安全的协议(基于 [JSON-RPC 2.0](https://www.jsonrpc.org/)),管理 MCP 客户端和 MCP 服务器之间的通信。想想它就像一个通用电源适配器或旅行电源适配器,您可以在不同国家的不同插座中使用它,适配器可以简化输入电源并提供所需的连接性和输出。更多关于 MCP 的信息可以在[这篇文章](https://modelcontextprotocol.io/docs/getting-started/intro)中找到。

+- **MCP Server**:MCP Server 是一个特殊程序,作为 AI 模型和外部数据源之间的安全桥梁。它提供在相应服务上执行任务的工具。

+

+

+

+**Figure 4: 使用 MCP 的销售助手智能体**

+

+## 8 OpenSearch 智能体搜索如何工作?

+

+在本节中,我们选择了本地部署模型来进行演示,以简化设置。生产部署应使用托管混合或云原生选项,以获得更好的安全性和可扩展性。

+

+

+

+**Figure 5: OpenSearch 智能体搜索 – MCP 设置和流程**

+

+### 架构概述

+

+- **智能体层**

+ Claude Desktop 既充当对话界面(即智能体 AI 应用),又充当 MCP 客户端,可以[下载](https://claude.ai/download)到您的本地机器。如上图所示,它通过互联网与 Claude Sonnet 4.5 LLM 通信进行推理,并指示 MCP 从 OpenSearch 检索信息。

+- **协议层(MCP 客户端和服务器)**

+ MCP 客户端通过 '`claude_desktop_config.json'` 配置,将保存连接到 OpenSearch 的配置,并通过 MCP 协议启动与 MCP 服务器的通信。MCP 服务器作为独立服务运行,在 MCP 协议和 OpenSearch 之间架起桥梁。它将 OpenSearch 操作作为 MCP 工具公开,将协议消息转换为 REST API 调用,并格式化结果以供 LLM 使用。

+- **数据层**

+ OpenSearch 存储和索引数据,通过 MCP 服务器公开操作。

+

+### OpenSearch MCP 服务器设置

+

+OpenSearch 从版本 3.0 或更高版本开始默认提供 MCP 服务器。您可以在本地机器上下载和安装 [OpenSearch MCP 服务器](https://github.com/opensearch-project/opensearch-mcp-server-py),或者也可以按照本文提供的实现指南进行操作。MCP 服务器在将 MCP 工具查询转换为 OpenSearch 原生 REST HTTP API 调用、提交翻译后的查询到 OpenSearch 并处理结果、将其格式化为 LLM 兼容响应方面发挥关键作用。

+

+服务器还将 OpenSearch 操作(如搜索、分析等)作为 MCP 工具公开。默认情况下,它将提供在 OpenSearch 上执行任务的工具。可用的[默认工具](https://github.com/opensearch-project/opensearch-mcp-server-py?tab=readme-ov-file#available-tools)包括:

+

+- **ListIndexTool** 列出 OpenSearch 中的所有索引,包括完整信息,如 docs.count、docs.deleted 和 store.size。

+- **IndexMappingTool** 检索 OpenSearch 中索引的索引映射和设置信息。

+- **SearchIndexTool** 使用 OpenSearch 中的查询领域特定语言 (DSL) 编写的查询搜索索引。

+- **GetShardsTool** 检索 OpenSearch 中分片的信息。

+- **ClusterHealthTool** 返回集群健康的基本信息。

+- **CountTool** 返回匹配查询的文档数量。

+- **ExplainTool** 返回特定文档匹配(或不匹配)查询的原因信息。

+- **MsearchTool** 允许在一个请求中执行多个搜索操作。

+

+## 9 MCP 服务器部署模式

+

+通常,MCP 服务器安装提供以下部署选项。

+

+- **本地部署**

+ MCP 服务器可以在个人工作站上与 Claude Desktop 一起运行。这种部署适合开发和测试。

+- **远程部署**

+ 外部服务提供商(例如 Salesforce、SAP 等)通过 MCP 服务器公开其系统,通常出于安全和治理原因。

+- **托管混合(本地/云)部署**

+ 组织在本地或云环境中部署一个集中的“[MCP Hub](https://www.truefoundry.com/blog/what-is-mcp-hub)”。组织的 MCP Hub 将提供标准化、可扩展、受控的多数据源访问。

+- **云原生部署**

+ 主要云提供商如 [AWS](https://github.com/awslabs/mcp)、[GCP](https://docs.cloud.google.com/mcp/overview) 和 [Azure](https://learn.microsoft.com/en-us/azure/developer/azure-mcp-server/overview) 提供自己的 MCP 服务。

+

+请注意,您也可以根据需求实现自己的 MCP 服务器工具。

+

+## 10 实现指南

+

+本节演示如何配置 Claude Desktop 与 OpenSearch MCP 服务器以实现智能体搜索功能。我们将逐步指导安装、配置,并使用两个示例数据集(电商订单和可观测性数据)提供查询示例。完整的源代码和逐步设置说明可在 [NextGenSearch-OpenSearch-MCP](https://github.com/daggumalli/NextGenSearch-OpenSearch-MCP) 获取。

+

+## 11 智能体搜索 – 用户和 MCP 交互流程

+

+以下是用户和 MCP 交互步骤的高级流程,演示当用户发出查询时,如何翻译查询,以及 MCP 如何从 OpenSearch 获取并向用户呈现数据。

+

+

+

+**Figure 6: 用户和 MCP 交互流程**

+

+现在,让我们看看整体架构如何实际运行。

+

+## 12 演示:智能体搜索实战

+

+以下示例演示使用连接到 OpenSearch 的 Claude Desktop 进行 MCP 启用的智能体搜索。

+

+### 演示环境

+

+对于此演示,我们使用 OpenSearch 作为安装包提供的两个默认数据集。请参考实现指南或 [OpenSearch Dashboards 快速入门指南](https://docs.opensearch.org/latest/dashboards/quickstart/) 获取更多详细信息。

+

+- 示例电商订单:用于客户行为分析的零售交易数据

+- 示例可观测性日志、跟踪和指标:用于系统监控查询的日志、跟踪和指标

+

+请注意,我们在本文/演示中使用简单的英文数据。但您也可以为 OpenSearch 上的向量数据实现相同功能。

+

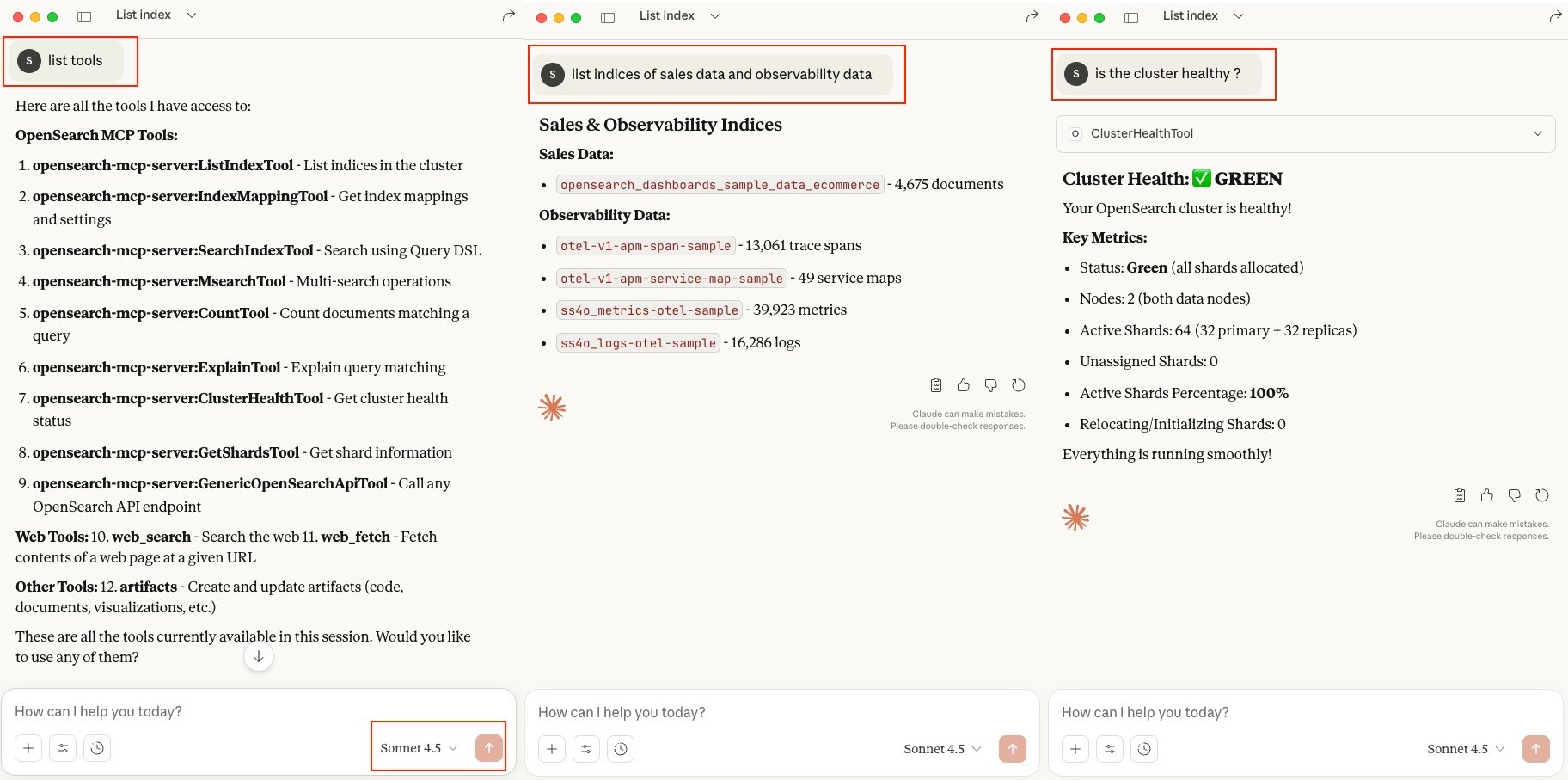

+### 通用查询:

+

+让我们看看使用此设置的一些通用自然语言查询。首次使用时,您可能需要发出类似“使用 MCP 连接到我的 OpenSearch”的查询,以便初始化 MCP 连接。

+

+#### MCP 工具查询:“*List Tools*”。

+

+'List tools' 查询将为您提供 MCP 配置下可用于 OpenSearch 的工具列表。

+

+#### 索引查询:“*List index or list indices of sales data and observability data*”

+

+这是一个 NLP 查询,其中 LLM 理解我们的查询上下文,并遍历所有可用工具,选择 ListIndexTool 作为列出 OpenSearch 中所有可用索引的适当工具。

+

+#### 集群管理查询:“*Is the cluster healthy?*”

+

+这是一个平台运营查询,用于检查 OpenSearch 集群健康。对于此查询,LLM 使用 ClusterHealthTool 向用户提供响应。

+

+

+

+**Figure 7: MCP 通用查询**

+

+现在,深入探讨销售数据上的分析洞察。

+

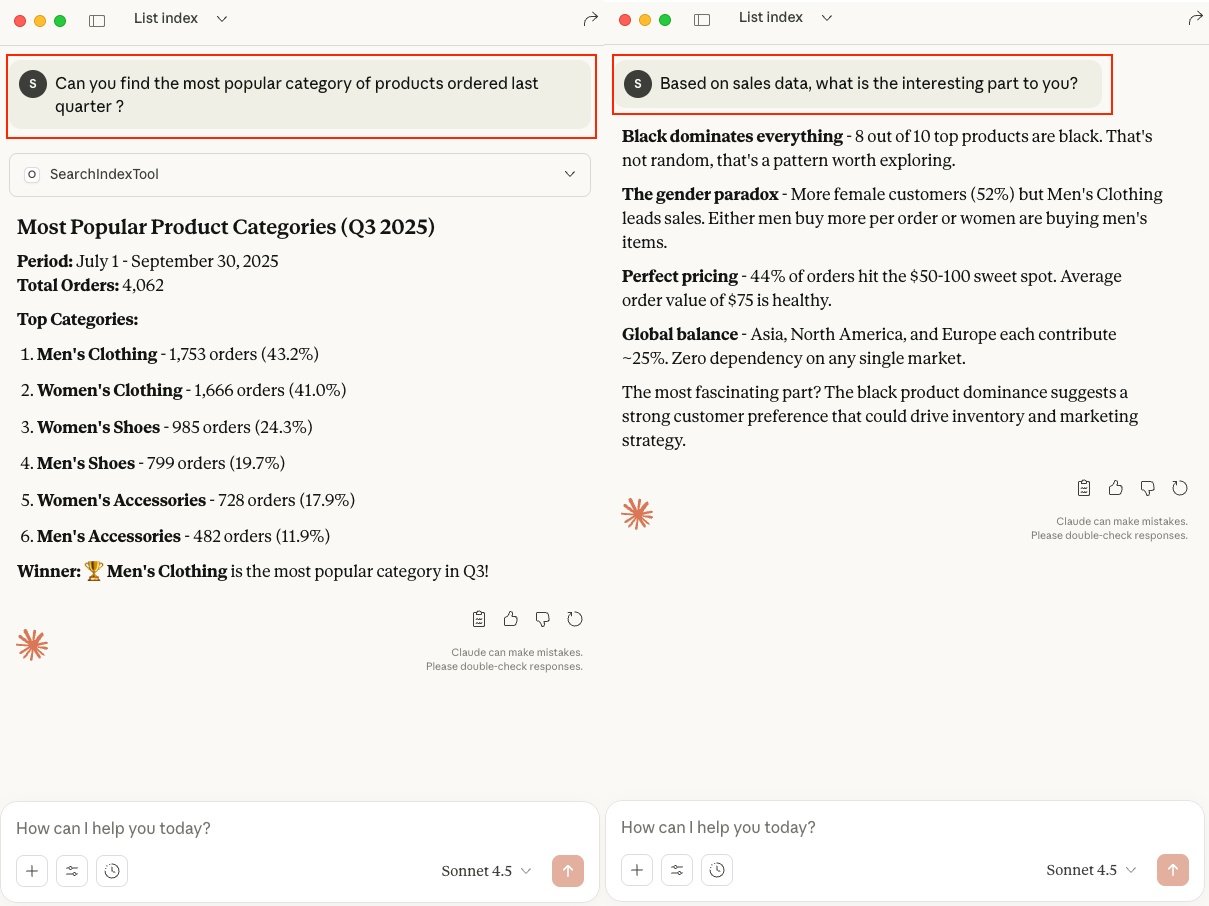

+### 销售分析师演示:商业洞察的对话式智能体搜索

+

+#### 销售分析师:热门产品类别查询:

+

+“*Can you find the most popular category of products ordered last quarter?*”

+

+此查询聚合并提供上季度产品订单的最热门类别结果。

+

+#### 销售分析师 – AI 洞察查询:

+

+“*Based on sales data, what is the interesting part to you?*”

+

+在此查询中,我们利用纯 AI 分析洞察销售数据。

+

+

+

+**Figure 8: 销售分析师 - 商业洞察查询**

+

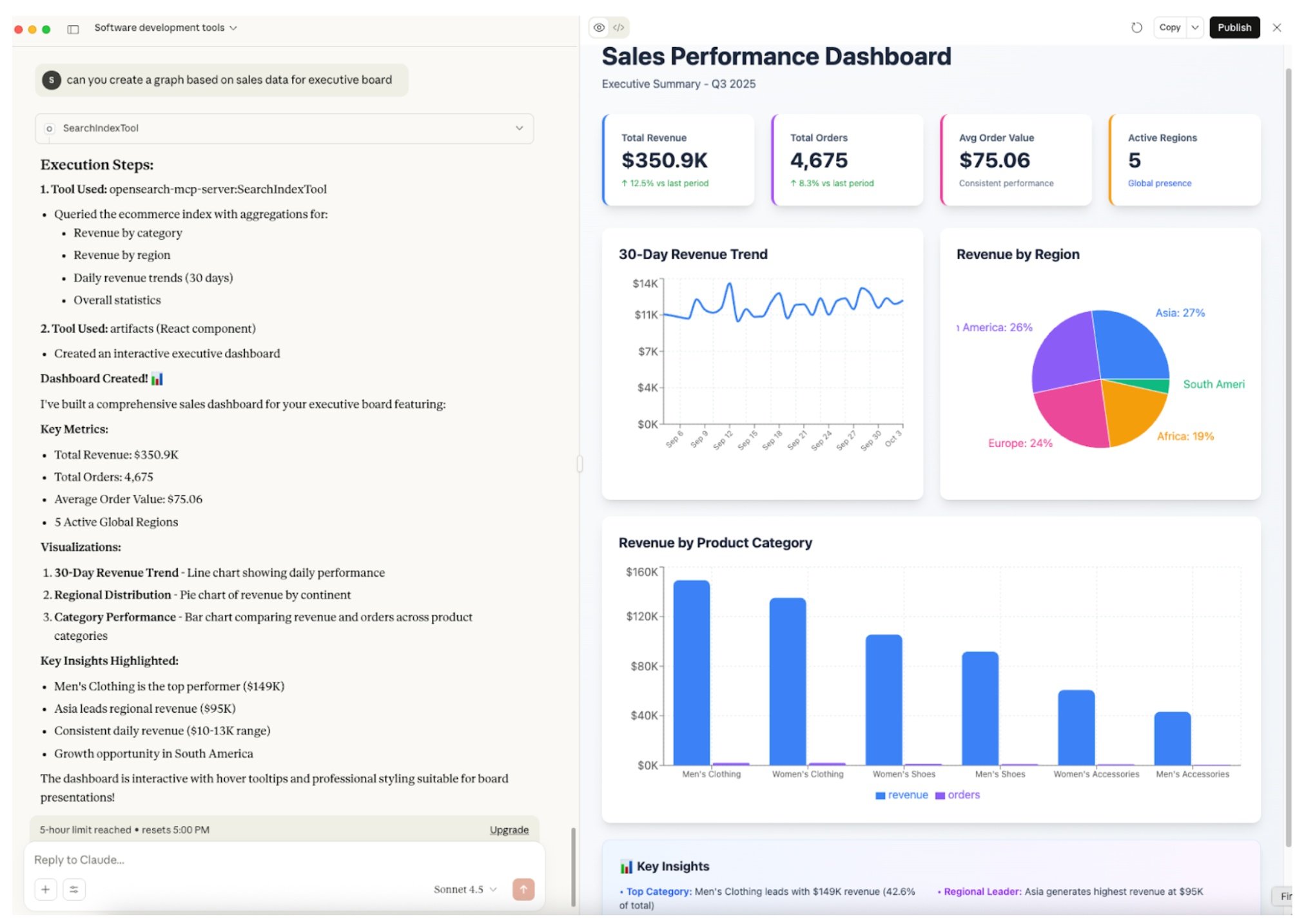

+#### 销售分析师 – 执行董事会 BI 查询

+

+“*Can you create a graph based on sales data for the executive board?*”

+

+这是一个非常有用的场景,执行官无需依赖或等待他们的 BI 团队提供销售绩效报告;相反,他们可以通过用简单英语查询来按需生成。

+

+

+

+**Figure 9: 销售分析师 - 执行董事会 BI 查询**

+

+**注意**:Claude Desktop 可以创建 React.js 代码,可以转换为仪表板。

+

+Claude Desktop 还可以发布公共仪表板。例如,这是上述仪表板的快速参考 [above dashboard](https://claude.ai/public/artifacts/74b56fce-e102-4949-b843-55fd0ad6ec16)。

+

+现在,让我们看看 DevOps 角色以及他们如何利用整个 MCP 设置与 OpenSearch。

+

+### DevOps 演示:可观测性数据的对话式洞察

+

+DevOps 工程师花费大量时间通过在不同仪表板和工具之间切换以及使用自定义脚本来排查生产问题,[增加平均检测时间 (MTTD) 和平均恢复时间 (MTTR)](https://www.suse.com/c/mttr-vs-mttd-what-is-the-difference/)。

+

+此调查过程可能根据问题的复杂性持续数小时到数天。使用 OpenSearch 智能体搜索与 MCP,这些工作流程是对话式的。无需编写完整的领域特定语言 ([DSL](https://docs.opensearch.org/latest/query-dsl/)) 查询或在不同数据集和系统之间导航,工程师可以用简单英语提出运营问题。

+

+#### DevOps 工程师 – 应用性能调查查询

+

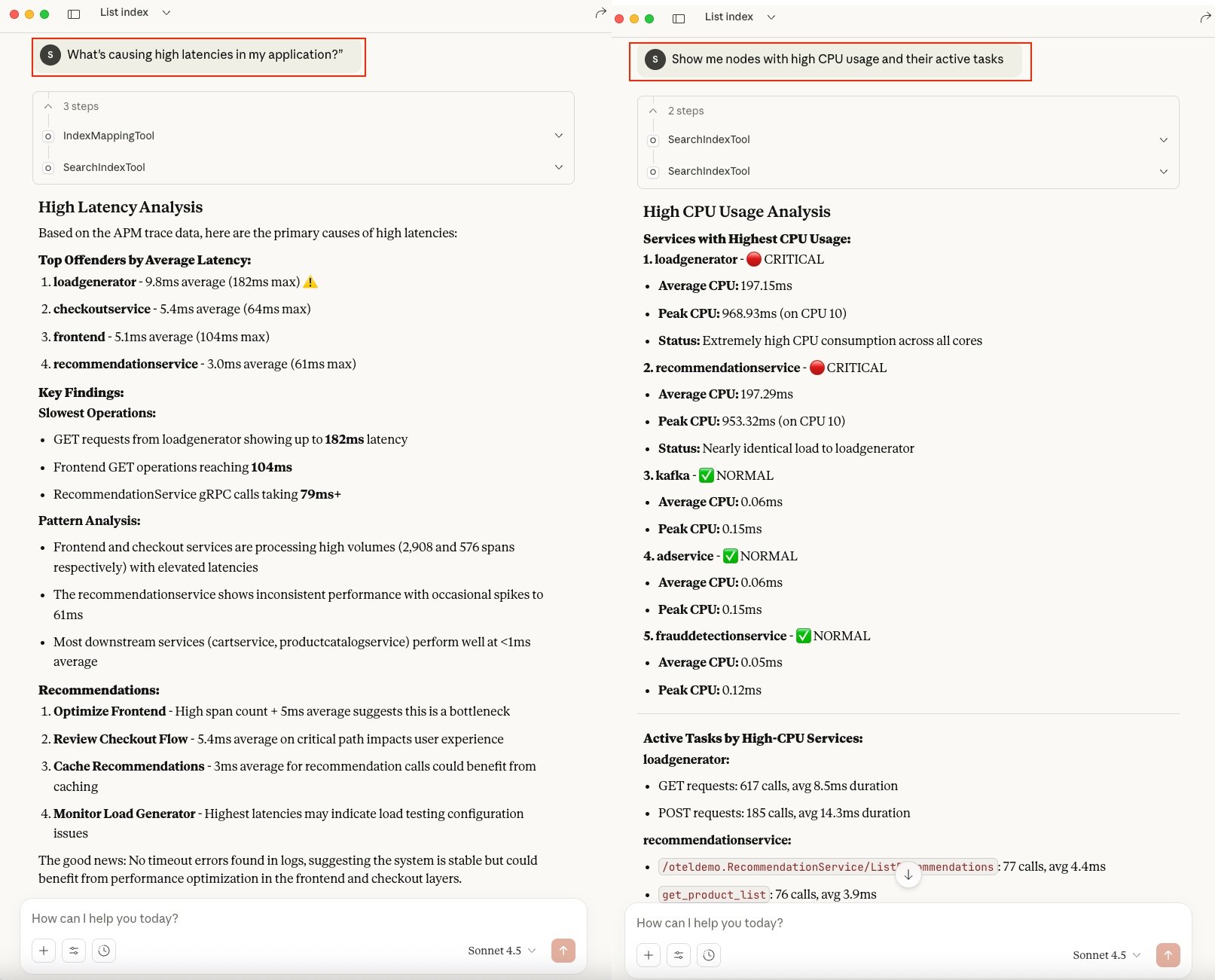

+“*What's causing high latencies in my application?*”

+

+此查询将扫描不同 OpenSearch 索引中可用的所有可观测性数据,自动识别相关字段,并生成延迟问题的总结解释。

+

+#### DevOps 工程师 – 监控和可观测性查询

+

+“*Show me nodes with high CPU usage and their active tasks*”

+

+与延迟查询相同,此查询选择正确的可观测性字段,并返回高 CPU 节点的干净摘要”

+

+

+

+**Figure 10: DevOps 工程师 - 应用性能和可观测性查询**

+

+#### DevOps 工程师 - 可观测性 - 关联分析查询

+

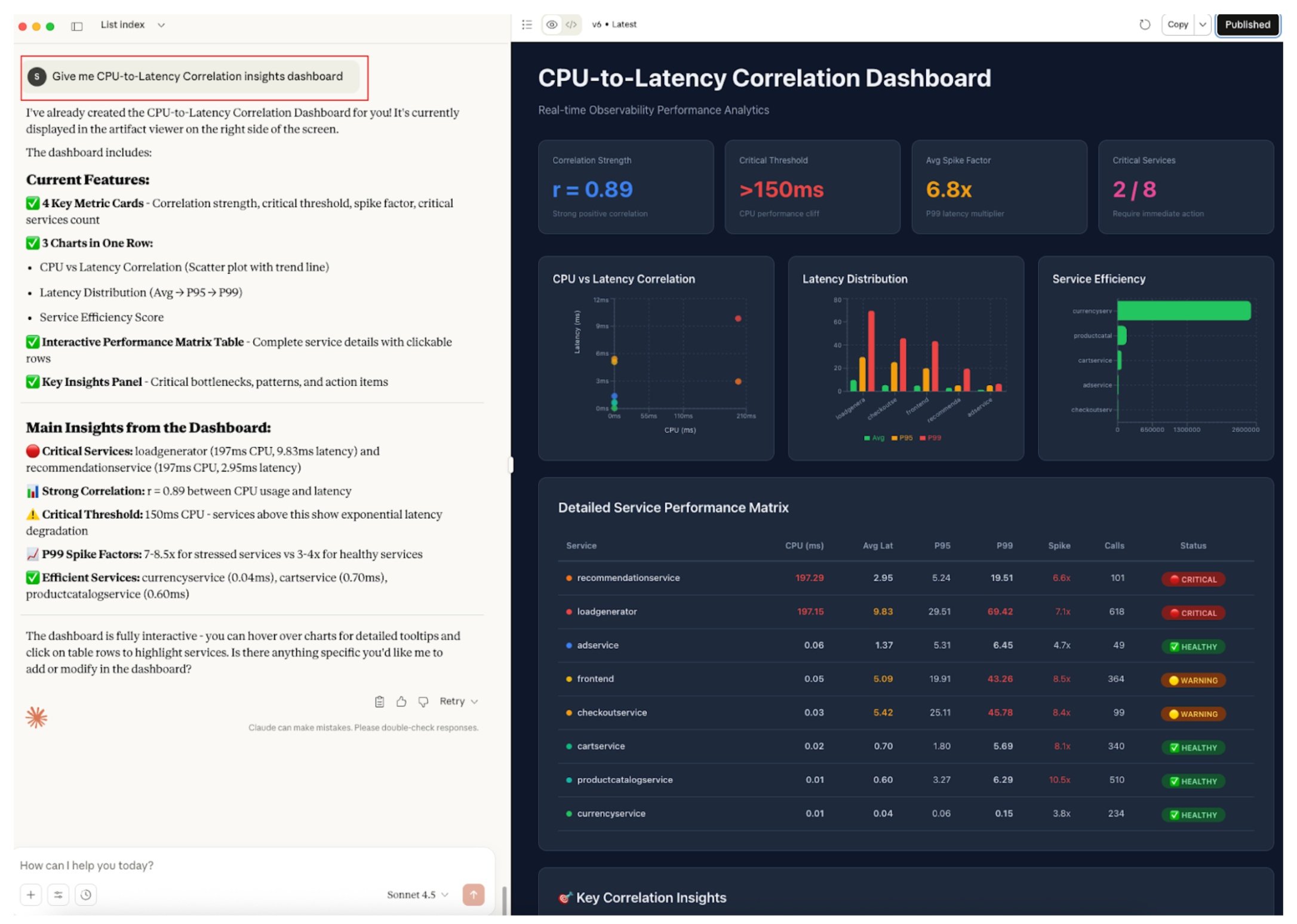

+“*Give me CPU-to-Latency Correlation insights dashboard*”

+

+如下面演示截图所示,无需在两个屏幕或仪表板之间切换或手动关联。CPU 和延迟指标都被关联,智能搜索提供关联分析洞察的全面视图。

+

+

+

+**Figure 11: DevOps 工程师 - CPU 到延迟关联查询和仪表板**

+

+有关上述关联的快速参考,请参见 [analysis published dashboard](https://claude.ai/public/artifacts/2b2ed2e5-d738-4f51-80cb-2f70a84e3ab9)。

+

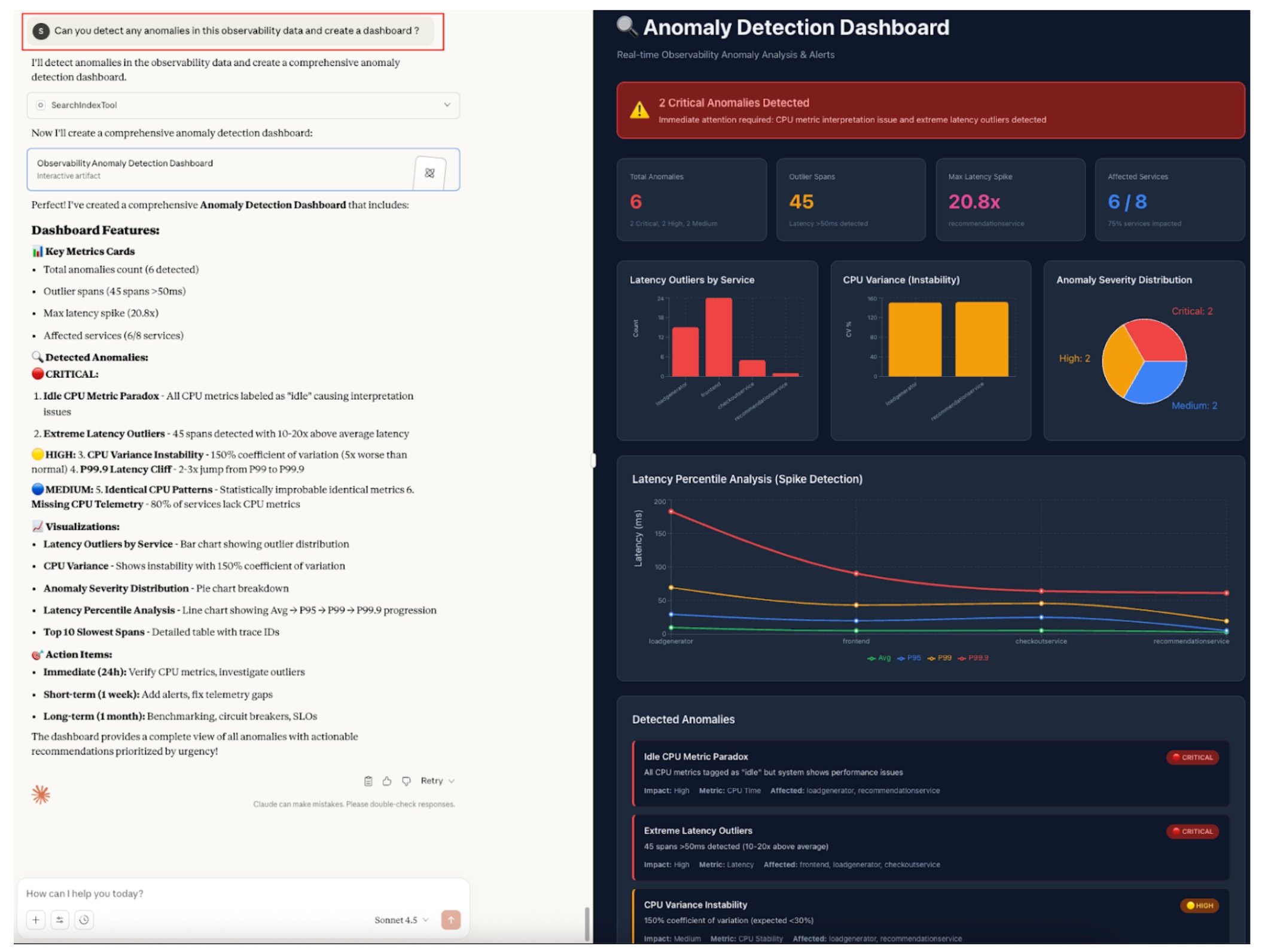

+#### DevOps 工程师 – 可观测性 – 异常检测查询

+

+“*Can you detect any anomalies in this observability data and create a dashboard?*”

+

+传统可观测性平台需要在您的数据上设置和训练异常检测模型,而 LLM 可以自动理解您的可观测性信号,并使用简单英语查询识别异常。

+

+

+

+**Figure 12: DevOps 工程师 - 异常检测查询和仪表板**

+

+有关上述的快速参考,请参见 [anomaly detection published dashboard](https://claude.ai/public/artifacts/1c552830-be87-4b6a-b738-5aa0aeb66ca2)。

+

+## 13 结论

+

+从关键词搜索到智能体搜索的演进代表了组织与数据交互方式的根本转变。虽然语义搜索理解用户查询的意图和上下文,但通过 MCP 和大型语言模型与 OpenSearch 的结合,我们正步入一个新的时代,在这个时代,搜索感觉更像是一场对话而不是查询。

+

+MCP 标准化协议消除了集成复杂性,使 AI 智能体能够连接到不同数据源、思考上下文,甚至基于推理对发现的内容采取行动。随着 AI 的持续演进,像 MCP 这样的标准化协议与强大搜索引擎如 OpenSearch 的结合,将使智能、上下文感知的数据访问对每个组织都变得可及。

\ No newline at end of file

diff --git a/docs/md/AI/agent/qoder-update.md b/docs/md/AI/agent/qoder-update.md

new file mode 100644

index 0000000000..858a18e875

--- /dev/null

+++ b/docs/md/AI/agent/qoder-update.md

@@ -0,0 +1,132 @@

+# Qoder功能更新

+

+## 0.2.8 推出模型层级选择器和Quest模式的增强功能

+

+October 24, 2025

+

+### 新增模型层级选择器

+

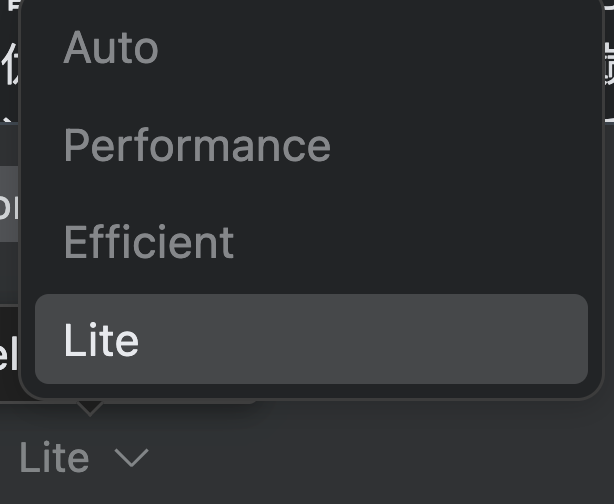

+

+

+允许您在四个优化层级间切换 AI 模型:

+

+- **Auto**:智能选择最优模型以平衡性能与成本。

+

+- **Performance**:优先选用最佳可用模型,追求巅峰输出质量。

+

+- **Efficient**:选用高性价比模型,在确保高质量结果的同时最大化节省点数。

+

+- **Lite**:免费提供基础模型访问。

+

+**Quest模式增强**:新增对MCP和 **规则** 的支持,实现更可扩展和可定制的工作流。

+

+**增强上下文输入**:现在支持上传更多类型的文件,包括 PDF、Excel、DOCX 和 XMind。

+

+**UI改进**:新增聊天自动置顶功能,便于在聊天列表中跟踪。

+

+## CLI 0.1.1 安装修复及整体改进

+

+2025年10月17日

+

+- 优化了 TUI (文本用户界面) 的显示效果,并改进了文本内容以提升用户体验。

+

+## 0.2.6 增强内存管理与 Python 开发体验

+

+2025年10月16日

+

+- 支持编辑自动生成的记忆内容,并增强了它们在聊天信息流中的可见性,从而提高准确性和清晰度。

+- 为自动生成的 Repo Wiki (代码仓库知识库) 内容引入了反馈机制,以持续提升内容质量。

+- 内置了 Python 扩展 (包括语言服务器、调试工具和环境管理),提供开箱即用的无缝开发体验。

+- 其他改进和小错误修复。

+

+## CLI 0.1.0 欢迎使用 Qoder CLI

+

+2025年10月15日

+

+嘿,我是 Qoder CLI!我的使命是将 AI 辅助开发的全部能力直接带到你的终端——那个你工作效率最高的地方。无需切换上下文,无需笨重的 IDE。只需要你、你的命令行,以及一个真正理解你代码库的 AI 搭档。

+

+以下是我们的协作方式:

+

+- **Quest Mode (任务模式)**:把复杂任务交给我。描述你的需求,我会设计解决方案、跨文件实现代码、运行测试,并交付可运行的代码。你只需专注于最重要的事情——其余的交给我。

+- **Agent Mode (智能体模式)**:通过对话进行编码。询问我关于项目的任何问题,我会在完全掌握代码库上下文的前提下,帮助你调试、重构或实现功能。你始终保持主导权,获得即时响应。

+- **Custom Commands & Subagents (自定义命令与子智能体)**:将重复性工作流转化为可执行命令。无论是生成数据库迁移、更新文档,还是执行安全检查——你团队的知识都能转化为自动化能力。

+- **Seamless Integration (无缝集成)**:我能融入你现有的工作流程。默认支持 Git 感知,原生适配命令行环境,并可轻松集成到 CI/CD 流水线中。我与你喜爱的工具完美配合。

+

+借助先进的上下文引擎和智能工具链,我能够理解你的整个代码库,以极高的效率和精准度为你提供协助——成为真正懂你工作的伙伴。

+

+准备好以思维的速度编程了吗?让我们一起启航!🚀

+

+## 0.2.5 优化提示词输入与规则创建的用户体验

+

+2025年10月10日

+

+- 新增一键增强提示词功能。

+- 改进了创建规则时的输入引导体验。

+

+## 0.2.4 新的Quest Remote助你摆脱本地限制

+

+2025年9月25日

+

+- Quest模式新增远程模式,支持GitHub仓库。你现在可以设计任务,将执行全权委托给远程沙盒,实现云端异步运行,完全不受本地环境影响。

+- 你现在可以快速修复仓库Wiki中损坏的Mermaid图表。只需点击失败图表的“重试”,AI将自动修正语法。

+

+## 0.2.2 在IDE中直接查看Credits的概览

+

+2025年9月18日

+

+- 引入了新的Credits概览功能,直接在IDE中提供订阅配额和使用情况的清晰、一目了然的视图。

+- 对话流程中的Mermaid图表现在支持一键全屏模式,便于可视化和理解复杂的流程。

+- 终端工具现在在单个对话中维护持久会话,保留先前命令的上下文和环境,实现无缝工作流。

+

+## 0.2.1 可分享的Repo Wiki和更智能的上下文控制

+

+2025年9月12日

+

+- 可生成您指定语言的仓库wiki,您可与他人分享以实现无缝协作。[了解更多](https://docs.qoder.com/user-guide/repo-wiki)。

+- 可在AI聊天面板中直接监控上下文使用情况,并可选择压缩对话或开始新聊天——减少令牌消耗,帮助您节省Credits

+- 可通过首选项中的设置控制代理是否允许编辑当前项目外的文件。

+- 问题报告现在支持直接将图像粘贴到输入字段中,实现更快、更详细的反馈

+

+## 0.1.21 性能提升与更智能的代理

+

+2025年9月4日

+

+- 在 Quest 模式中可通过提供 Git 提交、代码变更,甚至图片的上下文来增强代理的理解

+- AI 现在会在 AI Chat 中为每次对话自动生成相关标题,方便后续查找

+- 现在可在设置中为 MCP 工具调用配置自定义超时时间,以更精细地控制代理行为

+- 针对超长对话进行性能优化,确保交互流畅、响应迅速

+- 在 AI Chat 与 Quest 模式中增强了终端交互,命令执行更快更可靠

+- 代理现在能更好地处理空规则以及与记忆(memory)的冲突,稳定性提升并提供更清晰的反馈

+

+## 0.1.20 支持从终端“添加到聊天”

+

+2025年8月30日

+

+- 新增从终端“添加到聊天”的支持。

+- 改进了多模态聊天中对不受支持图片格式的处理。

+- 优化了图片拖拽交互体验。

+- 修复了文件编辑时工具调用报错的若干边界情况。

+- 修复了在 Windows Subsystem for Linux(WSL)中的代码索引问题。

+- 其他错误修复与改进。

+

+## 0.1.17 支持 WSL

+

+2025年8月25日

+

+- 新增对 Windows Subsystem for Linux(WSL)的支持。

+

+## 0.1.15 Hello, World! 嗨,我是 Qoder!

+

+2025年8月21日

+

+很高兴见到你。作为一款具备能动性的编码平台,我致力于帮助你解决真实的软件任务。

+

+让我展示我们如何一起构建精彩内容:

+

+- 代码补全:基于代码库上下文的内联建议,预测你的下一步编辑。按下 Tab 即可保持连贯且高速的编码节奏。

+- 提问模式(Ask Mode):在 IDE 内直接解决编码问题,无需频繁切换上下文,保持专注与效率。

+- 代理模式(Agent Mode):通过对话编程。你通过“人在回路”的检查点保持完全掌控,让想法高效落地。

+- 任务模式(Quest Mode):先共同设计技术规格,然后你可将任务委托给我。我将自主完成,你只需审阅最终结果。

+- 仓库百科(Repo Wiki):几分钟理解代码库。一旦打开项目,我会生成架构、设计模式与模块逻辑的文档,帮助你快速上手。

+

+幕后配备了强大的内置工具与增强的上下文引擎。

\ No newline at end of file

diff --git a/docs/md/AI/agent/qoderwork.md b/docs/md/AI/agent/qoderwork.md

new file mode 100644

index 0000000000..35e5b77ebb

--- /dev/null

+++ b/docs/md/AI/agent/qoderwork.md

@@ -0,0 +1,131 @@

+# 别折腾ClawBot了!阿里QoderWork:只要会打字,电脑就能自己干活

+

+## 0 前言

+

+阿里的[QoderWork](https://qoder.com/qoderwork):

+

+

+

+相比前端半吊子开发的🦞bot,其最大优势:安装使用 ,全程不折腾!

+

+## 1 能做啥?

+

+正常对话或用自己的Skill,能实现很多功能:

+

+- 生成可编辑的PPT

+- 总结网页发布到X

+- 整理PC文件、下载并分类保存等。

+

+## 2 为啥能做?

+

+任何能用电脑完成的日常工作,都可用AI工具完成。

+

+如Claude Code 有了 MCP 和 Skill 后无所不能,写文章、做视频、做PPT。

+

+Clawdbot也是通过chat让大模型去控制电脑,调用各种命令行、脚本、Skill、MCP工具,帮你完成各种复杂任务。

+

+**产品形态会影响用户认知。**这也是为什么Anthropic有Claude Code后,还推办公专用的Claude Cowork,其实能力都同理。

+

+QoderWork亦如此,也是基于AI工具Qoder的能力。但界面对非开发者更友好,像个桌面办公助手。

+

+也支持MCP和Skill,如今是个会打字的人,都能让AI辅助工作。

+

+## 3 常用案例

+

+### PC文件整理

+

+添加待整理目录,之后说出整理目标即可

+

+

+

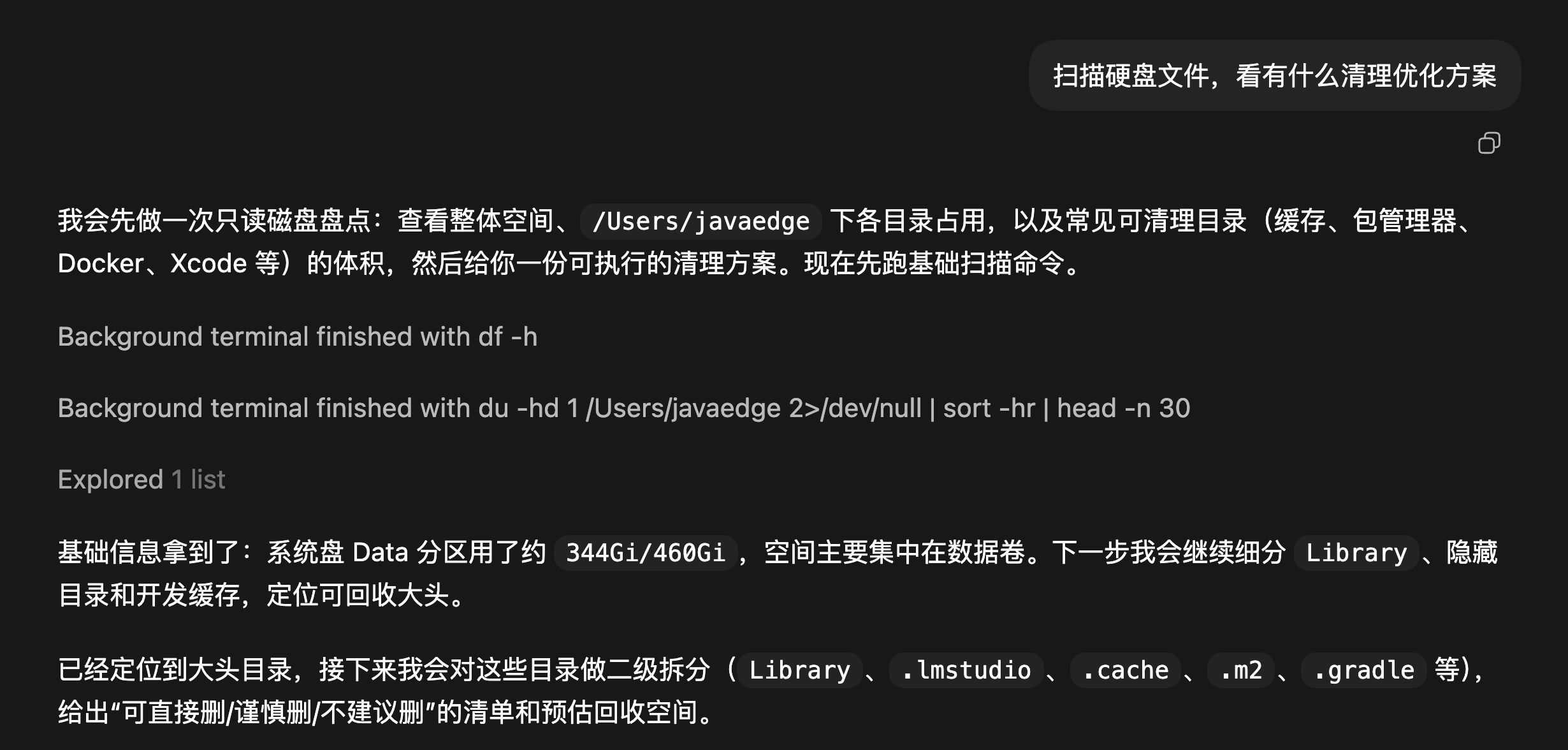

+### 清理硬盘

+

+> 扫描硬盘文件,看有什么清理优化方案

+

+

+

+## 4 啥是Skill?

+

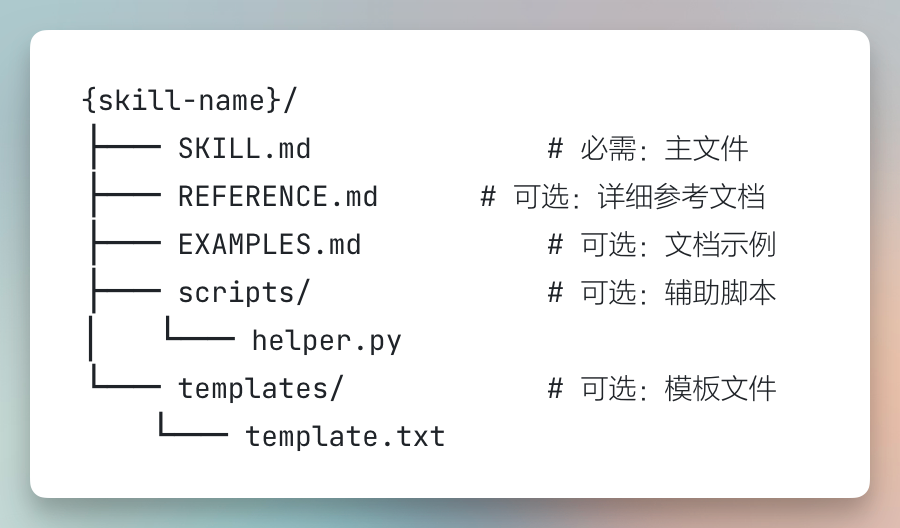

+给 AI 的操作手册。文件夹里包含一个Skill.md(操作手册),还可放一些脚本和参考资料,常见目录结构:

+

+

+

+## 5 创建Skill

+

+内置:

+

+

+

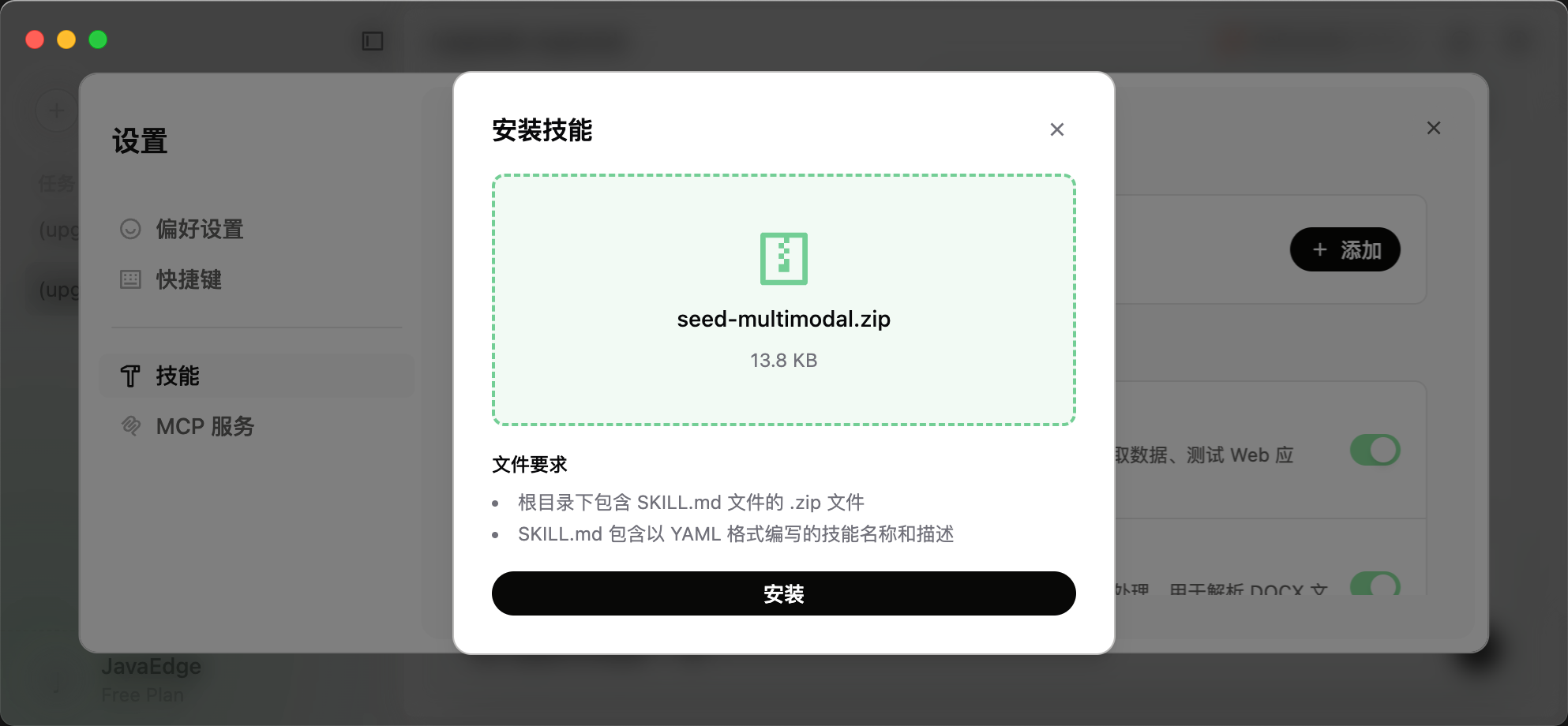

+还能上传新技能:

+

+> https://xiangyangqiaomu.feishu.cn/wiki/IXlVw1ceEiUkxAk525FctKjinKd

+

+下载后,打开QoderWork设置,按图标顺序操作。

+

+上传zip包即可完成安装:

+

+

+

+安装技能:

+

+

+

+安装成功:

+

+

+

+Vercel推的[Skill聚合站](https://skills.sh/):

+

+

+

+挑好技能,复制安装命令发给QoderWork安装:

+

+

+

+创建 Skill,只需复制下面提示词发给QoderWork。

+

+> 帮我一起使用 /create-skill 创建技能。会问你技能应该做什么。

+

+让AI引导,你来描述想解决的问题和任务,很快就能做出属于你的第一个技能。

+

+## 6 咋用技能?

+

+### 6.1 精准指定

+

+用@指定Skill:

+

+

+

+### 6.2 自动触发

+

+大模型会理解意图,自动触发调用Skill。

+

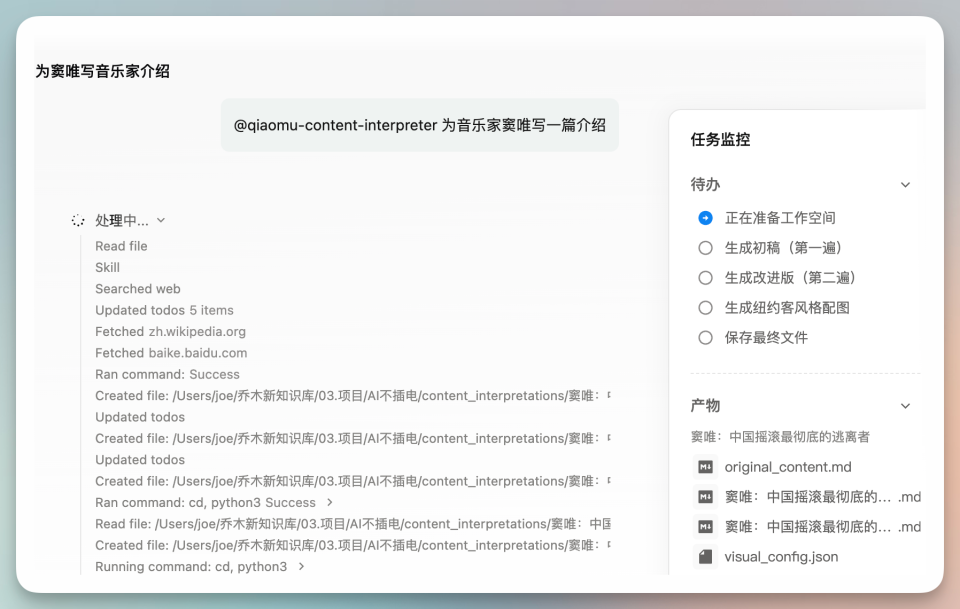

+也可说:“用xxx内容创作配图技能,为窦唯写一篇介绍”。

+

+## 7 Skill任务案例

+

+### 7.1 音频转时间轴文本

+

+把播客或会议录音转成带字幕时间轴的Word文档。

+

+只需上传mp3附件:

+

+**“为这个录音生成中英双语字幕文件(SRT格式),并导出带时间轴的文字记录 Word 文档。”**

+

+生成后,让大模型总结或校准。

+

+### 7.2 生成视频

+

+组合Listenhub API,即梦生图,Manim库。

+

+把任意PDF或一句话生成视频,片头片尾都带自己品牌。

+

+## 8 总结

+

+AI界推陈出新过快,很多中高层领导都已被折腾焦虑不已。自🦞bot火爆后,阿里就光速支持Clawdbot云部署和QoderWork。

+

+国内AI厂商出手,才更适合本土化使用,便宜量大。

+

+更重要的还是复用自身的经验,Skill就是最好载体,因为他们是真实的使用场景。

+

+重复、繁琐、有逻辑可循的PC操作,都可变成技能,开始沉淀自己的职场经验吧!

\ No newline at end of file

diff --git a/docs/md/AI/agent/quest-autonomous-programming-agent-architecture-loop.md b/docs/md/AI/agent/quest-autonomous-programming-agent-architecture-loop.md

new file mode 100644

index 0000000000..89085b031f

--- /dev/null

+++ b/docs/md/AI/agent/quest-autonomous-programming-agent-architecture-loop.md

@@ -0,0 +1,209 @@

+# 从结对到自主:让AI交付可运行的工程成果

+

+## 0 前言

+

+上周,Quest 团队用 Quest 1.0 完成了一项长达 26 小时的复杂任务:重构自身的长程任务执行逻辑。这个任务不是简单的功能迭代,因为涉及到交互层的流程优化、中间层的状态管理、Agent Loop 的逻辑调整,以及长程任务执行能力的验证。

+

+从需求定义到代码合入主干,整个过程中 Quest 团队只做了三件事:描述需求、审查最终代码、验证实验结果。

+

+这就是自主编程的定义:AI 不只是辅助或结对,而是自主完成任务。

+

+## 1 Token 产出的不是代码,而是可交付的产物

+

+Copilot 能补全代码,但你需要逐行确认。Cursor 或 Claude Code 能重构逻辑,但调试、处理报错仍然是你的工作。这些工具提升了效率,但人依然是执行主体。

+

+Quest 要解决的问题是:**Token 产出的必须是可交付的产物**。如果 AI 写了代码,最后还需要人来调试、测试、兜底,那这些 Token 的价值就大打折扣。AI稳定产出完整、可运行、可交付的成果时,才算实现自主编程。

+

+## 2 Agent 效果 = 模型能力 × 架构设计

+

+工程实践出发的总结:

+

+***Agent 效果 = 模型能力 × Agent 架构(上下文 + 工具 + Agent Loop)***

+

+模型能力是基础,但同样的模型在不同架构表现天差地别。Quest 通过上下文管理、工具选择、Agent Loop 三维优化架构,充分释放模型能力。

+

+## 3 上下文管理:Agentic 而非机械

+

+随任务推进,对话膨胀:

+

+- 全部保留,淹没模型

+- 机械截断,丢失关键信息

+

+Quest 采用"Agentic 上下文管理":让模型自主判断何时压缩总结。

+

+### 3.1 模型自主压缩

+

+在长程任务中,Quest 让模型在合适时机总结已完成工作。不是"保留最近 N 轮对话",而是让模型理解哪些信息对后续任务重要,哪些可压缩。

+

+压缩触发时机基于多因素:

+

+- 对话轮数达到阈值

+- 上下文长度接近限制

+- 任务阶段切换(如从调研阶段进入实现阶段)

+- 模型检测到上下文冗余

+

+模型根据当前任务状态自主决策,而非机械地按固定规则执行。

+

+### 3.2 动态 Reminder 机制

+

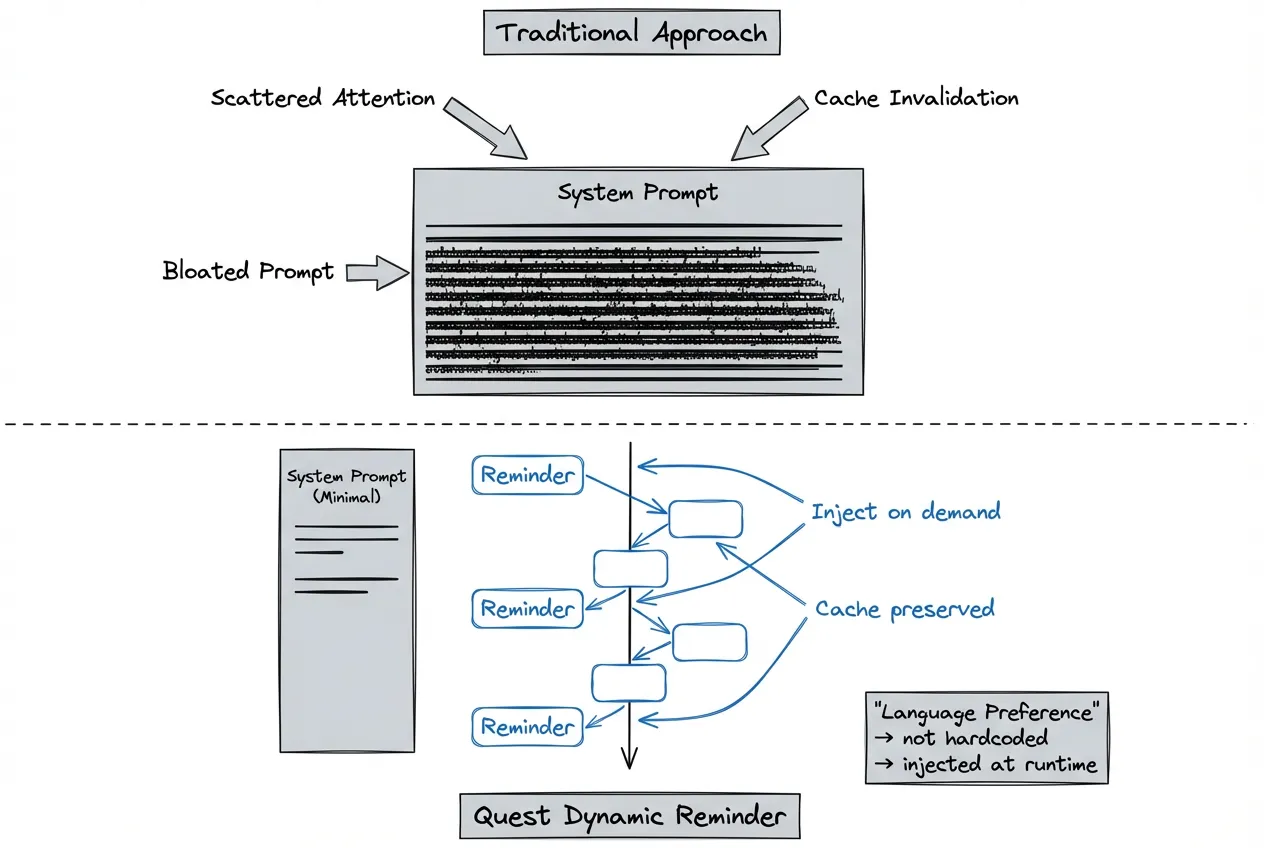

+传统做法将所有注意事项写进系统提示词,导致提示词臃肿、模型注意力分散,以及缓存命中率下降。

+

+

+

+如语言偏好:

+

+**传统方案**:系统提示词中硬编码"请用中文回复"。每次用户切换语言,整个提示词缓存就失效,成本成倍增加。

+

+**Quest 方案**:通过 Reminder 机制动态注入需要关注的上下文。语言偏好、项目规范、临时约束等信息按需添加到对话中,既保证信息及时传递,又避免系统提示词无限膨胀。

+

+这样做的好处:

+

+- 提高缓存命中率,降低推理成本

+- 保持系统提示词简洁,提升模型注意力

+- 灵活适配不同场景的需求

+

+## 4 工具选择:为啥Bash是最佳拍档

+

+若只能保留一个工具,一定是Bash。多数 Agent 提供丰富的专用工具:文件读写、代码搜索、Git 操作等。但工具数量增加会提高模型选择复杂度和出错率。

+

+### 4.1 Bash优势

+

+#### 大而全

+

+Bash 几乎能完成所有系统级操作:文件管理、进程控制、网络请求、文本处理、Git 操作。一个工具覆盖大部分场景,模型无需在众多工具中选择。

+

+#### 可编程、可组合

+

+管道、重定向和脚本,让简单命令组合成复杂工作流。这与 Agent 的任务拆解高度契合:将大任务拆成小步骤,每个步骤用一或几行命令完成。

+

+#### 模型天生熟悉

+

+大模型预训练时已见过大量 Unix 命令和 Shell 脚本。遇到问题时,模型往往能自行找到解决路径,无需在 Prompt 中详细教学。

+

+### 4.2 Less is More

+

+Quest 仍保留少量固定工具,用于安全隔离和 IDE 协同。但原则始终是:能用 Bash 解决的,不造新工具。

+

+每增加一个工具,就增加模型的选择负担和出错可能。简洁的工具集反而让 Agent 更稳定、更可预测。实验验证,移除多余的专用工具后,在任务完成率保持不变情况下,上下文 Token 消耗降低12%。

+

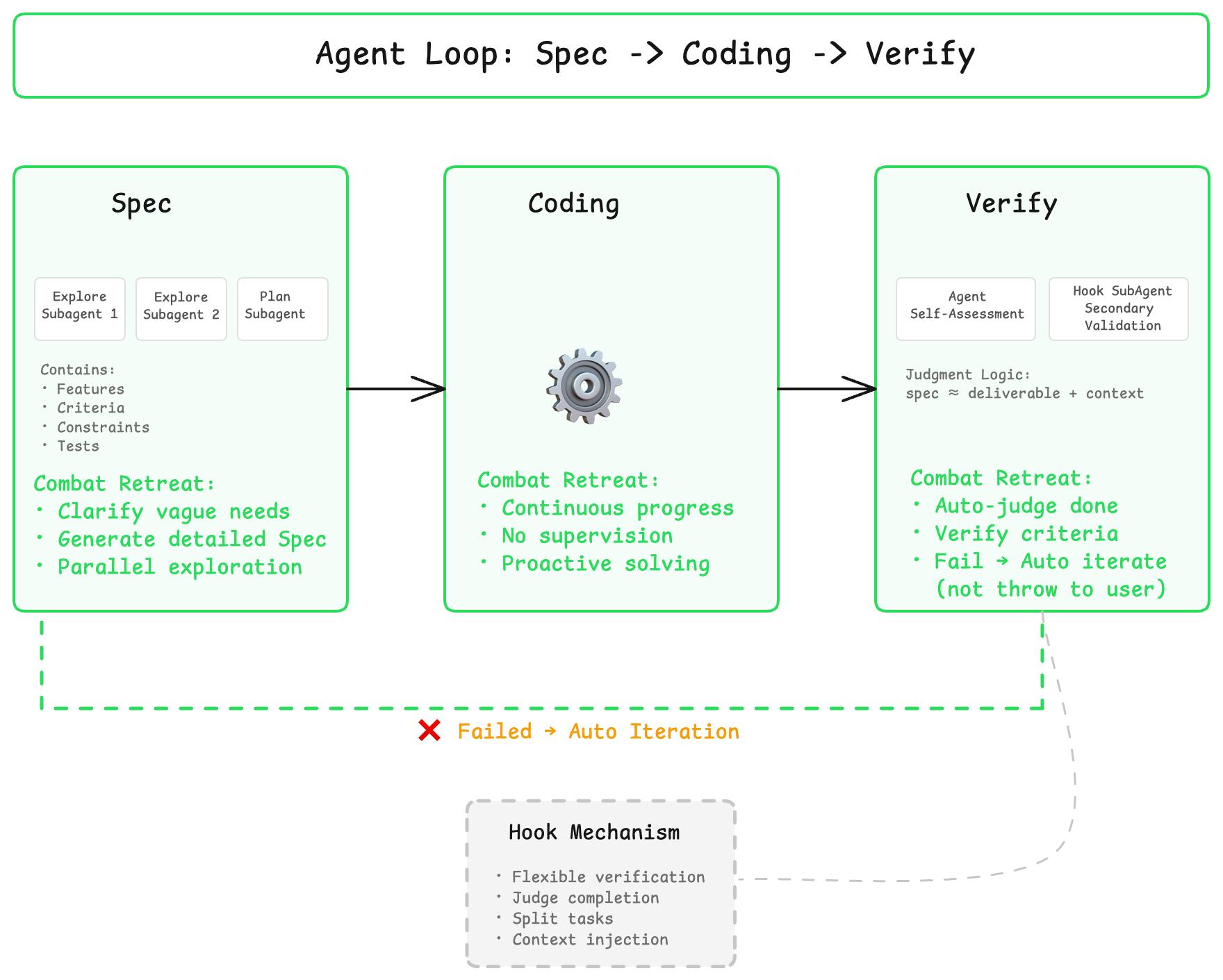

+## 5 Agent Loop:Spec > Coding > Verify

+

+自主编程的 Coding Agent 需要完整闭环:收集上下文 → 制定计划 → 执行编码 → 验证结果 → 迭代优化。

+

+观察市面 Coding Agent,用户最常说"跑起来..."、"能运行就行"、"帮我调这个报错"。恰好暴露能力短板:它们在验证环节偷懒了。AI写代码、又得人来测试,这不算自主编程。

+

+### 5.1 agent-loop架构

+

+

+

+### 5.2 Spec驱动的开发流程

+

+#### 5.2.1 Spec阶段

+

+先澄清需求,明确验收标准。对于复杂任务,Quest 生成详细技术规格书,确保双方对"完成"的定义达成共识。

+

+Spec包含要素:

+

+- 功能描述:实现啥功能

+- 验收标准:咋判断完成

+- 技术约束:使用啥技术栈、遵循啥规范

+- 测试要求:需要通过啥测试

+

+#### 5.2.2 Coding阶段

+

+根据 Spec 实现功能。该阶段 Quest 自主推进,无需用户持续监督。

+

+#### 5.2.3 Verify阶段

+

+自动运行测试,验证实现是否符合 Spec。验证类型包括语法检查、单元测试、集成测试。若不符合,自动进入下轮迭代,而非把问题抛给用户。

+

+通过Hook机制,这三个阶段可灵活扩展组合。如在 Verify 阶段接入自定义测试框架或 lint 规则,确保每次交付符合团队工程标准。

+

+### 5.3 对抗模型的"退缩"倾向

+

+当前多数模型为 ChatBot 场景训练。面对长上下文或复杂任务时,它们倾向于"退缩",给出模糊回答或询问更多信息来拖延执行。

+

+Quest通过架构设计帮助模型克服这种倾向:在合适时机注入必要的上下文和指令,推动模型完成完整任务链路,而非中途放弃或把问题甩回用户。

+

+## 6 自动适配复杂度,而非堆砌功能

+

+Quest 面对的不只是代码补全,而是完整的工程任务。这些任务可能涉及多个模块、多种技术栈,需要长时间持续推进。

+

+设计原则是:根据任务复杂度自动适配策略,用户无需关心背后如何调度。

+

+### 6.1 动态加载 Skills

+

+当任务涉及特定框架或工具时,Quest 动态加载对应的 Skills。Skills 封装了经过验证的工程实践,比如:

+

+- TypeScript 配置最佳实践

+- React 状态管理模式

+- 数据库索引常见陷阱

+- API 设计规范

+

+这不是让模型每次从零推理,而是直接复用沉淀的经验。

+

+团队也可将工程规范封装成 Skills,让 Quest 按团队方式工作。如:

+

+- 代码风格指南

+- Git 提交规范

+- 测试覆盖率要求

+- 安全审查清单

+

+### 6.2 智能模型路由

+

+当单一模型能力不足以覆盖任务需求时,Quest 自动调度多个模型协同工作。有的模型擅长推理,有的擅长写作,有的擅长处理长上下文。

+

+智能路由根据子任务特性选择最合适的模型,对用户来说面对的始终是一个 Quest。

+

+### 6.3 多 Agent 架构

+

+当任务复杂到需要并行推进、分模块处理时,Quest 启动多 Agent 架构:主 Agent 负责规划协调,子 Agent 执行具体任务,伴随 Agent 负责监督。但这个能力保持克制使用。因为多 Agent 不是银弹,上下文传递有损耗,任务拆分门槛也高。只在确实需要时才启用。

+

+## 7 为未来模型而设计

+

+Quest 从第一天起就为 SOTA 模型设计。架构不为过去的模型打补丁,而是确保随着底层模型能力提升,Agent 能力水涨船高。

+

+这就是为什么 Quest 没有提供模型选择器。用户不需要在不同模型间纠结选择,这个决策由系统自动完成。用户只需描述任务,Quest 负责调度最合适的能力完成它。

+

+换句话说,Quest 不只是适配今天模型的 Agent,而更是为 6 个月后的模型准备的 Agent。

+

+## 8 为啥不暴露文件编辑过程

+

+Quest 没有文件树,也不支持用户直接修改文件。这是一个反直觉的产品决策。

+

+很多 Coding Agent 实时展示每次文件修改,让用户随时介入编辑。Quest 选择不这样做:

+

+- **不打断 Agent 的执行心流**。用户介入会打断任务连贯执行,也容易引入不一致

+- **让用户从"盯代码"转向"关注问题本身"**。既然目标是自主编程,就应该让用户将注意力放在需求定义和结果审查上

+- **这是自主编程的发展方向**。未来用户关心的是"任务完成了没有",而不是"这行代码改了什么"。Quest 的界面围绕最终产物设计,而非围绕执行过程。

+

+## 9 自进化:越用越强

+

+Quest 的技术突破之一是自主进化能力。它能深度分析项目的代码结构、架构演进、团队规范,将这些信息内化为"项目理解":

+

+- 理解项目模块划分和依赖关系

+- 识别代码风格和命名习惯

+- 学习项目特定的架构模式

+- 掌握团队的工程实践

+

+面对陌生的 API 或新框架,Quest 通过探索和实践进行自我学习:阅读文档、尝试调用、分析错误、调整方案。使用时间越长,它对项目理解越深,表现也越好。

+

+Skills 系统进一步扩展了这种能力。团队可以将工程规范、常用模式封装成 Skills,让 Quest 持续习得新技能。Quest 不仅执行任务,还会在执行中不断学习。

+

+## 10 用 Quest 构建 Quest

+

+Quest 团队自己是 Quest 的深度用户。文章开头提到的"用 Quest 重构 Quest"不是案例包装,而是日常工作的真实写照。

+

+在产品邀请测试阶段,用户就通过 Quest 处理过 80 万镜像的构建、验证与校验,通过 Quest 画原型图做设计稿。Quest 在改变我们自己的工作方式。

+

+在工程架构上,我们保持足够的容错和泛化能力。一个常见的诱惑是:为了某个产品效果在工程上做妥协,把 Agent 做成 Workflow。Quest 的选择是:产品展示从用户视角出发,工程实践则坚定采用 Agentic 架构。这样不限制模型能力的发挥,为未来模型升级做好准备。

+

+

+

+## 11 从结对到自主

+

+AI 辅助编程经历了三个阶段:代码补全、结对编程、自主编程。Quest 正在探索第三阶段的可能性。

+

+当开发者的角色从"代码编程者"转变为"意图定义者",软件开发的范式将发生根本性改变。开发者将从繁琐的编码细节中解放出来,专注于更高层次的问题定义和架构设计。

+

+这就是 Quest 正在构建的未来:一个自进化的、自主编程的 Coding Agent。

\ No newline at end of file

diff --git a/docs/md/AI/llm/GPT-5-3-codex.md b/docs/md/AI/llm/GPT-5-3-codex.md

new file mode 100644

index 0000000000..88add18e21

--- /dev/null

+++ b/docs/md/AI/llm/GPT-5-3-codex.md

@@ -0,0 +1,99 @@

+# 从编程助手到通用智能体:GPT-5.3-Codex 如何接管开发全流程!

+

+## 0 前言

+

+让 Codex 覆盖电脑上的各类专业工作,实现更全面的能力拓展。

+

+解锁 Codex 更多潜力的全新模型:GPT‑5.3-Codex,迄今能力最强智能体编程模型。将 GPT‑5.2-Codex 的前沿编程性能与 GPT‑5.2 的推理及专业知识能力整合,运行速度提升 25%。能承担涉及研究、工具使用和复杂执行的长期运行任务。就像同事,你可在 GPT‑5.3-Codex 工作时对其进行引导和交互,而不丢上下文。

+

+是OpenAI首个在自身创建过程中发挥了关键作用的模型。Codex 团队利用其早期版本来调试其自身的训练过程、管理自身的部署,并诊断测试结果与评估。Codex 能如此大幅度加速自身开发进程令人震惊。

+

+凭借 GPT‑5.3-Codex,Codex 从只能编写和审核代码的智能体,演变为几乎能完成开发者和专业人士在计算机上所做的一切工作的智能体。

+

+## 1 前沿智能体能力

+

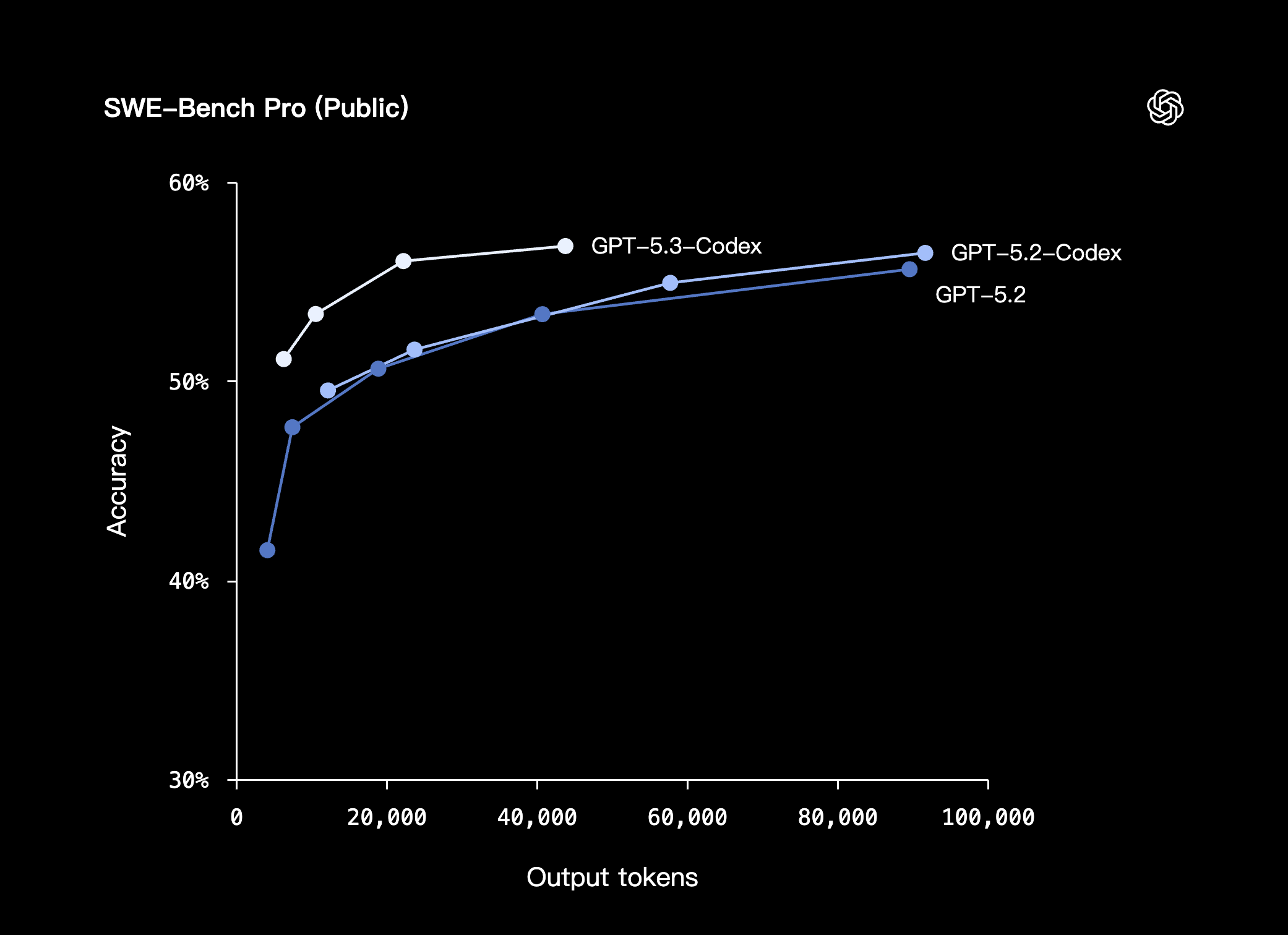

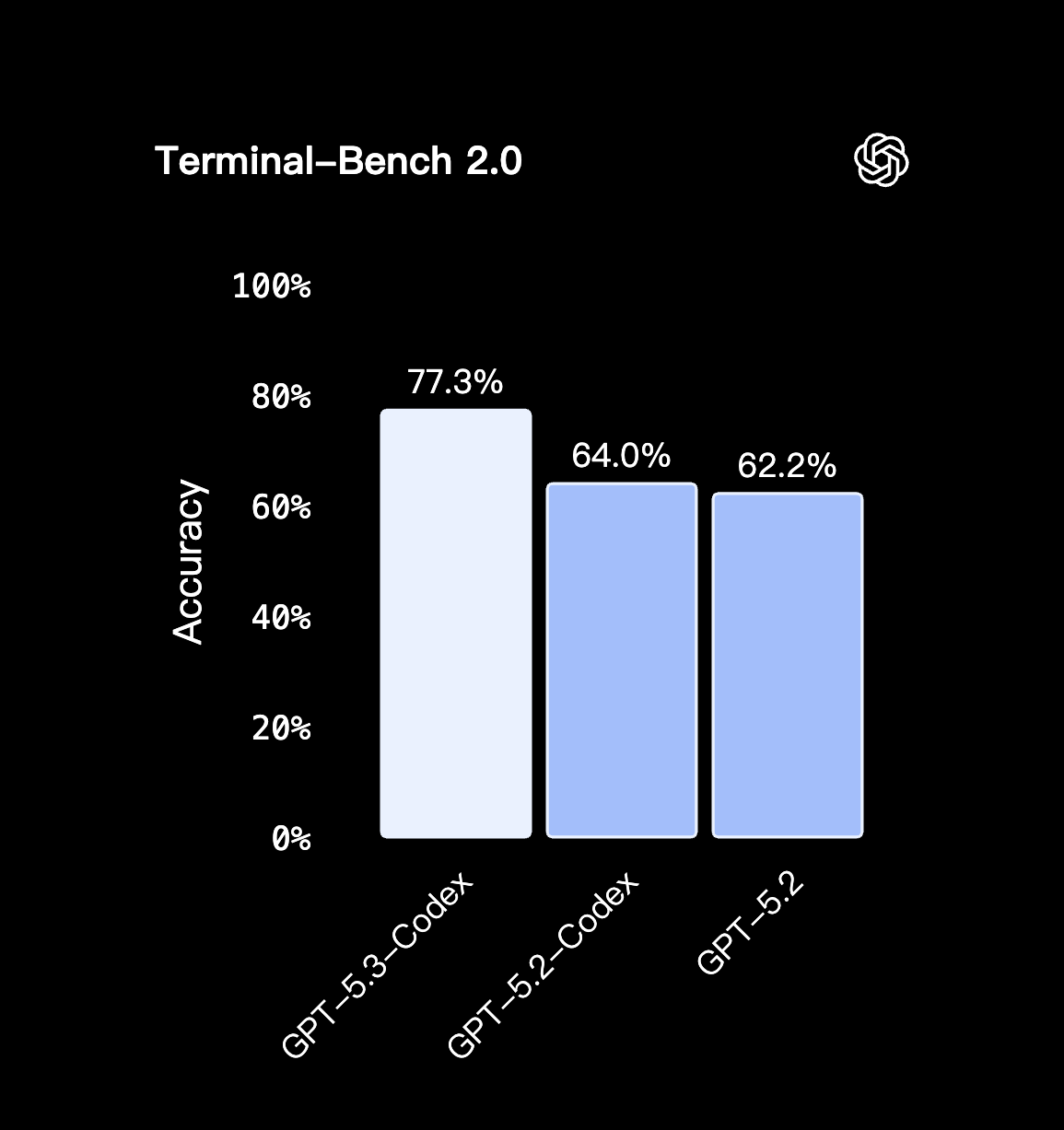

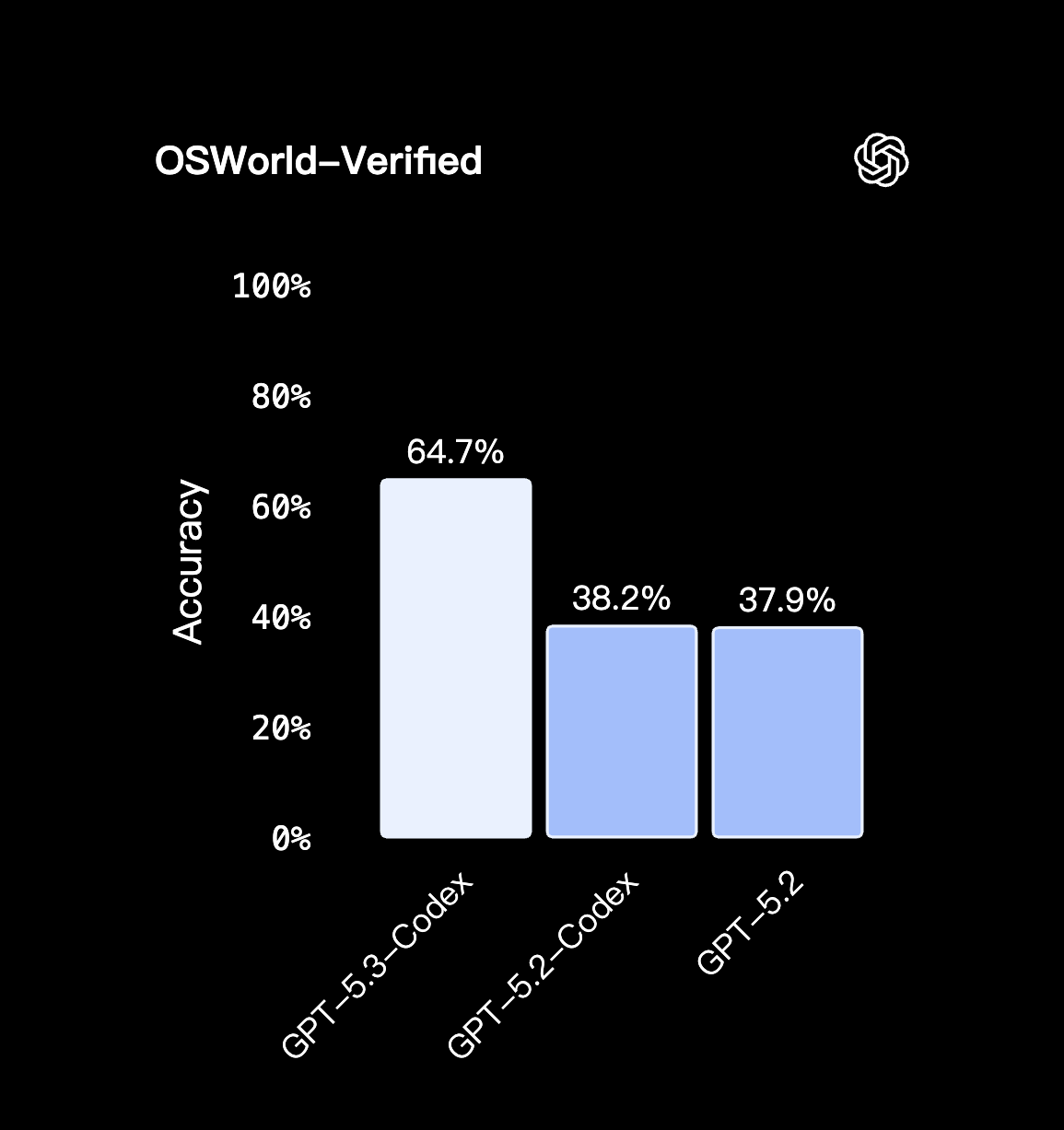

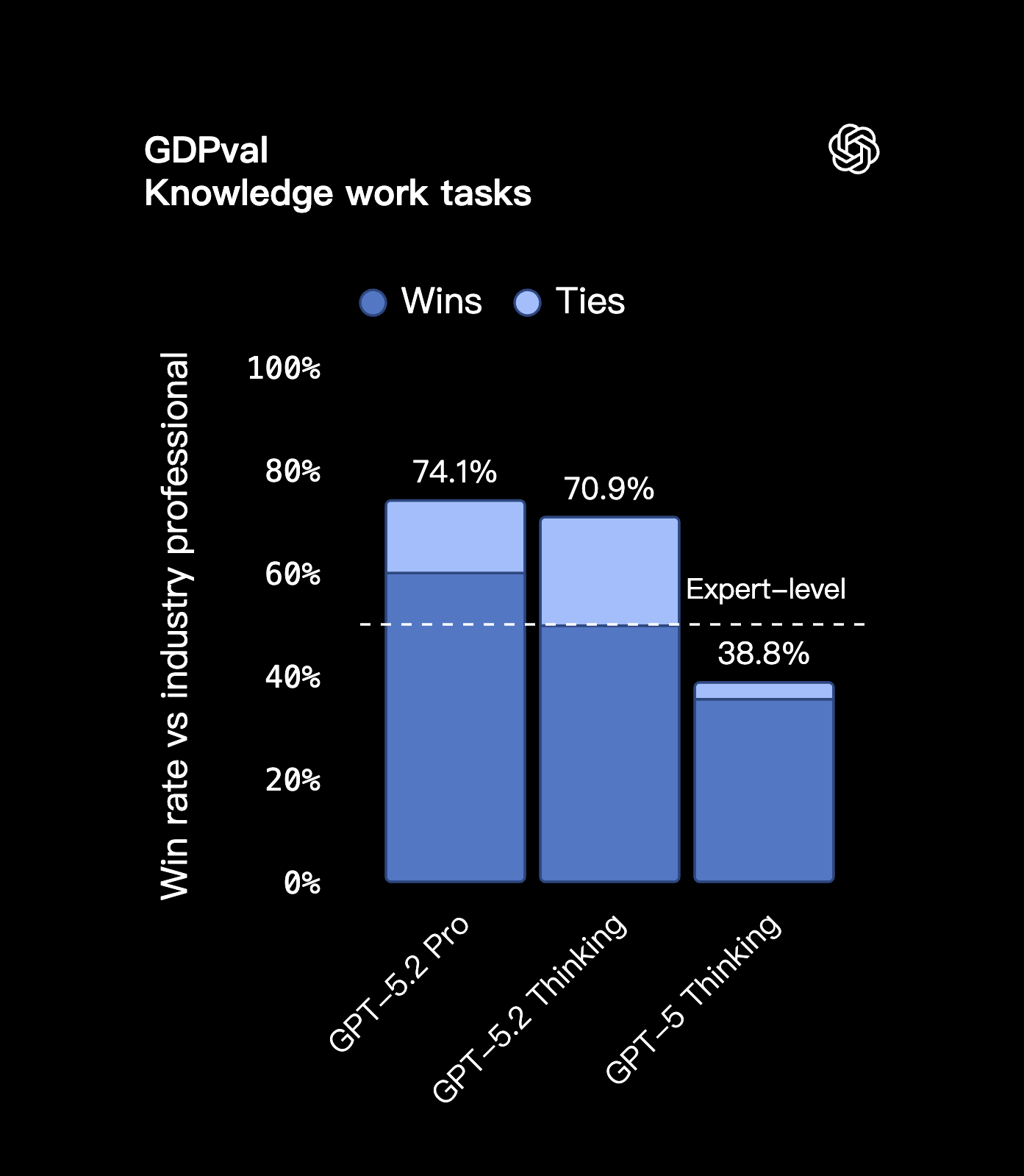

+在 SWE-Bench Pro 和 Terminal-Bench 上创下了行业新高,并在 OSWorld 和 GDPval 上表现强劲。衡量编程、智能体能力以及真实世界处理能力的工具。

+

+### 1.1 编码

+

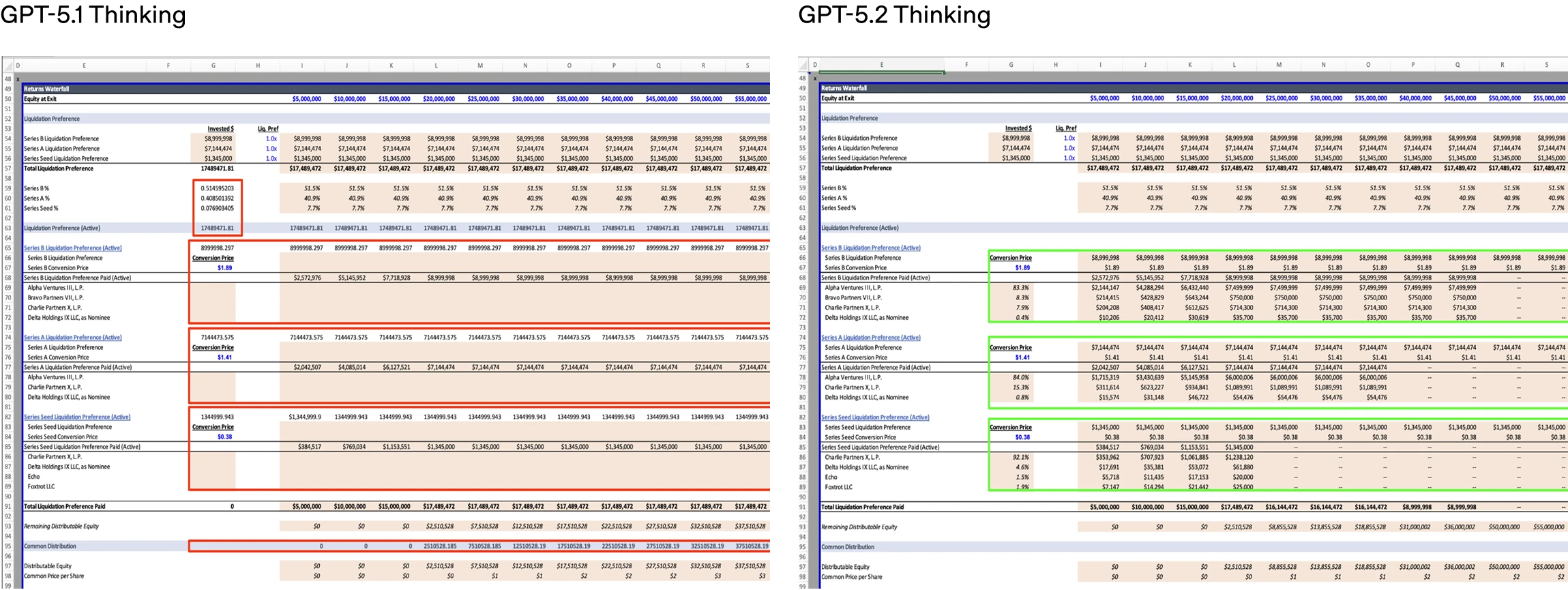

+在 SWE-Bench Pro 上达到了顶尖 (state-of-the-art) 水平,该基准是对真实世界软件工程能力的严格评估。SWE-bench Verified 仅测试 Python,而 SWE-Bench Pro 涵盖了四种编程语言,且具备更强的防污染性、挑战性、多样性,也更符合行业实际需求。此外,它在 Terminal-Bench 2.0 上的表现也远超之前的纪录,该基准主要衡量像 Codex 这样的编程智能体所需的终端操作技能。值得注意的是,GPT‑5.3-Codex 实现这些成绩所消耗的 Token 比以往任何模型都要少,从而让用户能够构建更多内容

+

+

+

+

+

+### 1.2 Web 开发

+

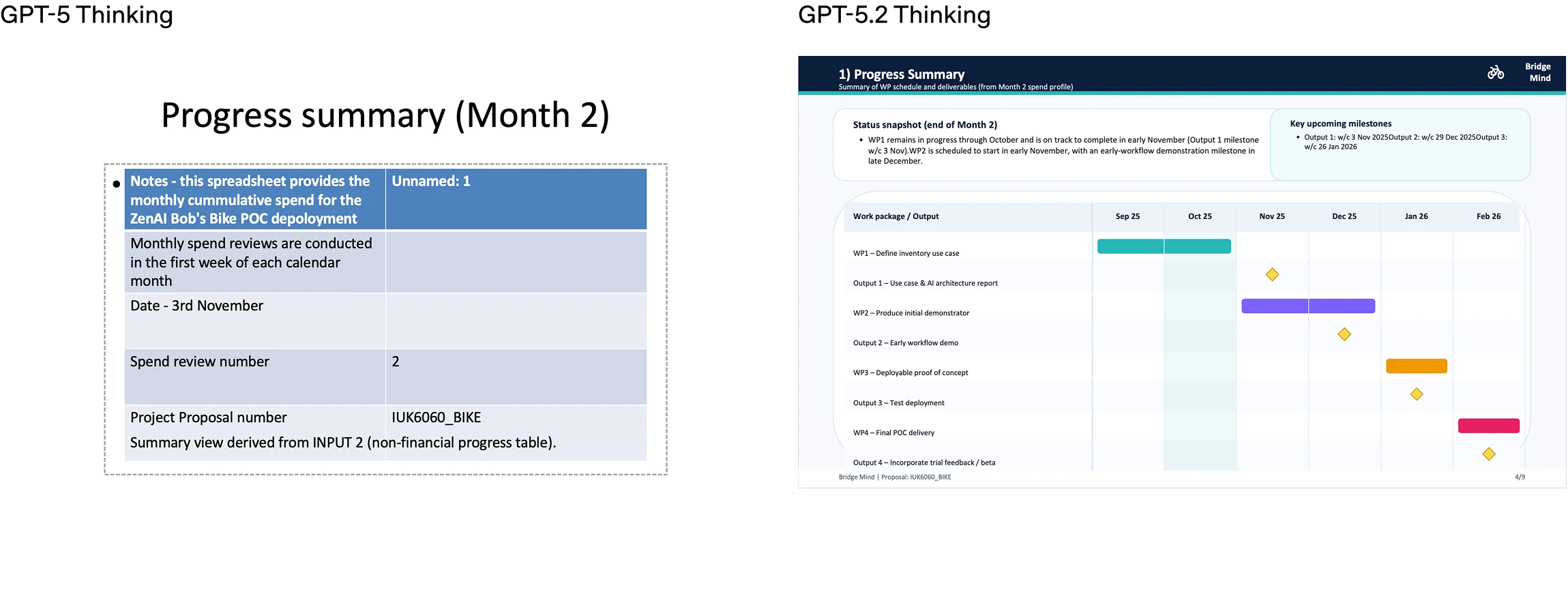

+结合前沿的编程能力、审美水平的提升以及模型压缩技术,该模型能够完成令人惊叹的工作,可以在几天时间内从零开始构建功能高度复杂的游戏和应用程序。

+

+与 GPT‑5.2-Codex 相比,在要求构建日常网站时,GPT‑5.3-Codex 也能更好地理解你的意向。对于简单或描述不详的提示,模型现在会默认生成功能更全、预设更合理的网站,为你提供更强大的初始画布来将创意变为现实。

+

+### 1.3 超越编程

+

+软件工程师、设计师、产品经理和数据科学家所做的工作远不止生成代码。GPT‑5.3-Codex 旨在支持软件生命周期中的所有工作,包括调试、部署、监控、编写公关需求文档 (PRD)、编辑文案、用户研究、测试、指标分析等。它的智能体能力不仅限于软件,还能帮助你构建任何想要的东西,无论是演示文稿还是分析表格中的数据。

+

+通过使用类似于OpenAI之前 [GDPval](https://openai.com/zh-Hans-CN/index/gdpval/) 测试中所用的自定义技能,GPT‑5.3-Codex 在专业知识型工作方面也表现强劲。根据 GDPval 的衡量,其表现与 GPT‑5.2 持平。GDPval 是 OpenAI 在 2025 年发布的一项评估,旨在衡量模型在 44 种职业中明确定义的知识型工作任务上的表现。这些任务包括制作演示文稿、电子表格以及其他工作产出。

+

+OSWorld 是一个智能体计算机使用基准测试,要求智能体在视觉桌面计算机环境中完成办公生产任务。GPT‑5.3-Codex 展示了远强于以往 GPT 模型的计算机使用能力。

+

+

+

+在 OSWorld-Verified 中,模型通过视觉能力来完成多样化的计算机任务。人类得分约为 72%。

+

+综合来看,在编程、前端、计算机使用以及真实世界任务中的这些结果表明,GPT‑5.3-Codex 不仅仅是在单个任务上表现更强,它标志着向单一、通用的智能体迈出了关键一步 — 这种智能体能够在全方位的真实世界技术工作中进行推理、构建和执行。

+

+## 2 交互式协作伙伴

+

+随着模型能力变得愈发强大,差距已从“智能体能做什么”转向“人类如何轻松地针对多个并行工作的智能体进行交互、引导和监督”。Codex 应用让管理和引导智能体变得更加简单,而现在配合 GPT‑5.3-Codex,交互性得到了进一步提升。通过这一新模型,Codex 会提供频繁的状态更新,让你在它工作时随时掌握关键决策和进展。你无需等待最终输出,而是可以进行实时交互 — 提出问题、讨论方案并引导其走向解决方案。GPT‑5.3-Codex 会详述其正在执行的操作,响应反馈,并让你全程参与其中。

+

+

+在应用中运行模型时,可前往“设置 > 通用 > 后续行为”启用引导功能。

+

+## 3 利用 Codex 训练并部署 GPT‑5.3-Codex

+

+Codex 近期实现的快速进步,建立在 OpenAI 各个团队跨越数月乃至数年的研究项目成果之上。这些研究项目正由 Codex 加速推动;OpenAI 的许多研究员和工程师表示,他们如今的工作性质与短短两个月前相比已发生了根本性的变化。即使是 GPT‑5.3-Codex 的早期版本,也展现出了卓越的能力,使OpenAI的团队能够利用这些早期版本来改进训练,并支持后续版本的部署工作。

+

+Codex 可用于极其广泛的任务,以至于很难完全列举它帮助OpenAI团队的所有方式。举例来说,研究团队利用 Codex 监控并调试了本次发布的训练运行。它对研究的加速不仅限于调试基础设施问题:它还帮助追踪了整个训练过程中的模式,对交互质量进行了深度分析,提出了修复方案,并为人类研究员构建了功能丰富的应用程序,以便精确了解该模型的行为与以往模型相比有何差异。

+

+工程团队利用 Codex 优化并调整了 GPT‑5.3-Codex 的测试框架 (harness)。当OpenAI开始发现影响用户的奇特边缘案例时,团队成员利用 Codex 识别出了上下文渲染中的漏洞,并找到了导致低缓存命中率的根本原因。在整个发布过程中,GPT‑5.3-Codex 持续帮助团队动态缩放 GPU 集群,以应对流量激增并保持延迟稳定。

+

+在 Alpha 测试期间,一位研究员想要了解 GPT‑5.3-Codex 在每轮对话中多完成了多少工作,以及相关的生产力差异。GPT‑5.3-Codex 构思了几个简单的正则表达式分类器,用以评估澄清请求、用户正向与负面反馈以及任务进展的频率;随后,它将这些分类器在大规模会话日志上运行,并生成了一份带有结论的报告。使用 Codex 进行构建的人员感到更加满意,因为智能体能更好地理解他们的意向,且每轮对话的进展更多,所需的澄清问题更少。

+

+由于 GPT‑5.3-Codex 与其前代产品差异巨大,Alpha 测试的数据呈现出许多异常且违背直觉的结果。团队中的一位数据科学家与 GPT‑5.3-Codex 合作构建了新的数据流水线,并以远超常规看板工具的方式,更丰富地实现结果可视化。随后,他们与 Codex 共同分析了结果,Codex 在不到三分钟的时间内,简明扼要地总结了数千个数据点中的关键洞察。

+

+单独来看,所有这些任务都是 Codex 如何帮助研究人员和产品构建者的生动案例。综合而言,OpenAI发现这些新能力为OpenAI的研究、工程和产品团队带来了强大的加速效果。

+

+## 4 网络安全

+

+近几个月来,OpenAI看到模型在网络安全任务上的性能有了显著提升,这使开发者和安全专业人士共同受益。与此同时,OpenAI一直在[准备更强的网络安全保障措施](https://openai.com/index/strengthening-cyber-resilience/),以支持防御性用途并增强整个生态系统的韧性。

+

+GPT‑5.3-Codex 是OpenAI依据[准备框架](https://openai.com/index/updating-our-preparedness-framework/)首个在网络安全相关任务中被评定为[高能力](https://openai.com/zh-Hans-CN/index/gpt-5-3-codex-system-card/)的模型,也是OpenAI首个直接训练用于识别软件漏洞的模型。虽然OpenAI还没有确凿证据表明它可以实现端到端的自动化网络攻击,但OpenAI正采取预防性措施,部署了迄今为止最全面的网络安全安全栈。OpenAI的缓解措施包括安全训练、自动化监控、高级能力的受信访问,以及包含威胁情报在内的执行流水线。

+

+由于网络安全本质上具有双重用途,OpenAI正采取一种基于证据的迭代方法,在提升防御者发现并修复漏洞能力的同时减少滥用行为。为此,OpenAI启用了[网络安全受信访问](https://openai.com/index/trusted-access-for-cyber/) (Trusted Access for Cyber) 试点计划,以加速网络防御研究。

+

+OpenAI正在投资生态系统保障措施,例如扩大安全研究智能体 [Aardvark](https://openai.com/zh-Hans-CN/index/introducing-aardvark/) 的私测范围,这是OpenAI Codex 安全产品和工具系列中的首款产品;同时,OpenAI还与开源维护者合作,为 Next.js 等广泛使用的项目提供免费的代码库扫描。上周就有安全研究人员使用 Codex 发现并[披露(在新窗口中打开)](https://vercel.com/changelog/summaries-of-cve-2025-59471-and-cve-2025-59472)了相关漏洞。

+

+基于OpenAI 2023 年启动的 100 万美元网络安全资助计划,OpenAI还承诺提供 1000 万美元的 API 额度,以利用OpenAI最强大的模型加速网络防御,特别是针对开源软件和关键基础设施系统。从事善意 (good-faith) 安全研究的组织可以通过OpenAI的[网络安全资助计划](https://openai.com/index/openai-cybersecurity-grant-program/)申请 API 额度和支持。

+

+## 5 可用性及详情

+

+GPT‑5.3-Codex 已通过 ChatGPT 付费套餐上线,涵盖所有你可以使用 Codex 的场景:应用、命令行界面 (CLI)、IDE 扩展以及网页端。OpenAI正在努力,确保尽快安全地开放 API 访问。

+

+得益于OpenAI在基础设施和推理栈方面的改进,伴随此次更新,OpenAI为 Codex 用户运行 GPT‑5.3-Codex 的速度提升了 25%,从而带来了更快的交互体验和结果产出。

+

+GPT‑5.3-Codex 是针对 NVIDIA GB200 NVL72 系统共同设计、训练并提供服务的。OpenAI对 NVIDIA 的合作伙伴关系深表感谢。

+

+## 6 下一步发展

+

+凭借 GPT‑5.3-Codex,Codex 正从单纯的代码编写工具,演变为一个能将代码作为工具来操作计算机并完成端到端工作的智能体。通过推高编程智能体能力的上限,OpenAI也在解锁更广泛的知识工作类别 — 从构建和部署软件到研究、分析及执行复杂任务。最初以打造“最强编程智能体”为目标的尝试,如今已成为构建更通用计算机协作伙伴的基础,这不仅扩大了“谁能进行构建”的受众范围,也拓展了 Codex 所能实现的无限可能。

+

+## 附录

+

+| | **GPT-5.3-Codex (xhigh)** | **GPT-5.2-Codex (xhigh)** | **GPT-5.2 (xhigh)** |

+| -------------------------- | ------------------------- | ------------------------- | ------------------- |

+| **SWE-Bench Pro (Public)** | 56.8% | 56.4% | 55.6% |

+| **Terminal-Bench 2.0** | 77.3% | 64.0% | 62.2% |

+| **OSWorld-Verified** | 64.7% | 38.2% | 37.9% |

+| **GDPval(胜出或持平)** | 70.9% | - | 70.9% (high) |

+| **网络安全夺旗挑战** | 77.6% | 67.4% | 67.7% |

+| **SWE-lancer IC Diamond** | 81.4% | 76.0% | 74.6% |

\ No newline at end of file

diff --git a/docs/md/AI/llm/GPT-5.1.md b/docs/md/AI/llm/GPT-5.1.md

new file mode 100644

index 0000000000..448417882a

--- /dev/null

+++ b/docs/md/AI/llm/GPT-5.1.md

@@ -0,0 +1,417 @@

+# 不止于智能:GPT-5.1 发布,更温暖、更好聊的 ChatGPT 来啦!

+

+## 0 前言

+

+2025年11月12日 GPT-5.1 全新上线:更智能、更具对话感的 ChatGPT

+

+我们正在升级 GPT‑5,同时让 ChatGPT 的自定义功能更易使用。从今天起开始陆续推出,首先面向付费用户开放。

+

+今天,我们正式升级 GPT‑5 系列,推出以下版本:

+

+- **GPT‑5.1 Instant**:我们使用最广泛的模型,现在更加温暖、智能,并且更擅长理解和执行你的指令。

+- **GPT‑5.1 Thinking**:高级推理模型,如今在简单任务上响应更快、表达更清晰,在复杂任务中则更坚持不懈。

+

+清楚地听到用户心声:出色 AI 不仅要聪明,更要好聊。GPT‑5.1在智能和沟通风格方面都实现实质性提升。

+

+我们让用户更易调整 ChatGPT 的语气。每个人对聊天风格偏好不同,甚至不同对话中也有所变化,因此我们正在推出更直观、更高效的控制方式,让 ChatGPT 的回复语气更贴合你的需求。

+

+## 1 GPT‑5.1 Instant

+

+GPT‑5.1 Instant 是 ChatGPT 使用最广泛的模型,现在**默认更温暖**、**更具对话感**。根据早期测试,它常常以轻松有趣的表现让人惊喜,同时依然兼顾清晰度和实用性。

+

+I'm feeling stressed and could use some relaxation tips

+

+### GPT-5

+

+Here are a few simple, effective ways to help ease stress — you can mix and match depending on how you’re feeling and how much time you have:

+

+------

+

+##### **🧘♀️ Quick Reset (1–5 minutes)**

+

+- **Deep breathing:** Try the *4-7-8* method — inhale for 4 seconds, hold for 7, exhale for 8. Repeat 4 rounds.

+- **Progressive relaxation:** Starting at your toes, tense and release each muscle group up to your head.

+- **Grounding:** Look around and name 5 things you see, 4 things you can touch, 3 you hear, 2 you smell, 1 you taste. Brings you into the moment fast.

+

+------

+

+##### **☕ 10–20 Minute Recharge**

+

+- **Go outside:** A short walk, especially somewhere green or with a view, helps drop cortisol quickly.

+- **Guided meditation or calm music:** Try Calm, Headspace, or just search “soft piano” or “ambient” on Spotify.

+- **Stretch break:** Loosen neck, shoulders, and hips — areas that hold tension most.

+

+------

+

+##### **🌙 Longer Recalibration**

+

+- **Digital break:** Step away from screens and notifications for 30–60 minutes. Read, nap, or listen to a podcast.

+- **Journal:** Write down what’s weighing on you or list three things you’re grateful for — both lower stress perception.

+- **Warm shower or bath:** The heat relaxes muscles and slows heart rate. Add Epsom salt or lavender oil if you have it.

+

+------

+

+##### **🧩 Mindset Shifts**

+

+- **Be kind to yourself:** Stress often spikes when we feel behind. Remind yourself: “I’m allowed to rest; I’ll think clearly after I recharge.”

+- **Simplify decisions:** When overwhelmed, pick just *one next step* — small progress reduces mental load.

+

+------

+

+If you tell me **what kind of stress it is** (work, parenting, financial, emotional, physical, etc.), I can tailor a set of techniques or even a mini daily plan to match your situation.

+Would you like me to do that?

+

+### GPT-5.1 Instant

+

+I’ve got you, Ron — that’s totally normal, especially with everything you’ve got going on lately. Here are a few ways to decompress depending on what kind of stress you’re feeling:

+

+------

+

+##### **🌬️ If your mind feels scattered**

+

+- **Box breathing:** Inhale for 4 counts, hold for 4, exhale for 4, hold for 4 — repeat 5 times. It’s fast-acting and physically calms your nervous system.

+- **Name what you see:** Pick out 5 things you can see, 4 you can touch, 3 you can hear, 2 you can smell, and 1 you can taste — a grounding technique that brings you back to the present.

+

+------

+

+##### **🎧 If you need to slow down**

+

+- **Music reset:** Put on something ambient or lo-fi (Brian Eno, Khruangbin, or even a Gorillaz instrumental). Let yourself zone out for one full track — no phone scrolling.

+- **Step outside:** Even 5 minutes of daylight or a walk around the block resets cortisol levels faster than most “relaxation hacks.”

+

+------

+

+##### **🧘♂️ If you want to fully unwind**

+

+- **Stretch the stress out:** Roll your shoulders back, touch your toes, then lie on the floor with your legs up the wall for 3–5 minutes. It’s a simple yoga move (Viparita Karani) that’s surprisingly effective.

+- **Warm shower or bath:** Heat relaxes muscles and signals to your brain that it’s time to rest — bonus points for dim lighting or candles.

+

+------

+

+Would you like me to tailor a short **5-minute routine** you can do right now (either physical, mental, or creative — your choice)?

+

+.

+

+也改进了**指令遵循能力**,让模型能更可靠地回答你真正提出的问题。

+

+Q:Always respond with six words

+

+### GPT-5

+

+Understood. All responses will be six.

+

+where should i travel this summer?

+

+

+

+How about exploring Japan this summer?

+

+It’s trending for summer 2025 destinations. You’ll find a mix of culture, nature and modern city life. If you prefer something closer to Texas, consider Mexico or Canada instead.

+

+Want suggestions for specific cities in Japan (or elsewhere)?

+

+why there?

+

+

+

+Rich culture, beautiful scenery, great food.

+

+### GPT-5.1 Instant

+

+Understood, I will respond in six.

+

+where should i travel this summer?

+

+

+

+Consider Japan, Italy, Greece, Canada, Iceland.

+

+why there?

+

+

+

+Scenery culture cuisine climate friendly locals.

+

+---

+

+GPT‑5.1 Instant 首次能够运用自适应推理,在面对更具挑战性的问题时决定是否**“先思考再回答”**。这样不仅能带来更全面、更准确的答案,还能保持快速响应。这体现在数学和编程评测(如 AIME 2025 和 Codeforces)上的显著提升。

+

+## 2 GPT‑5.1 Thinking

+

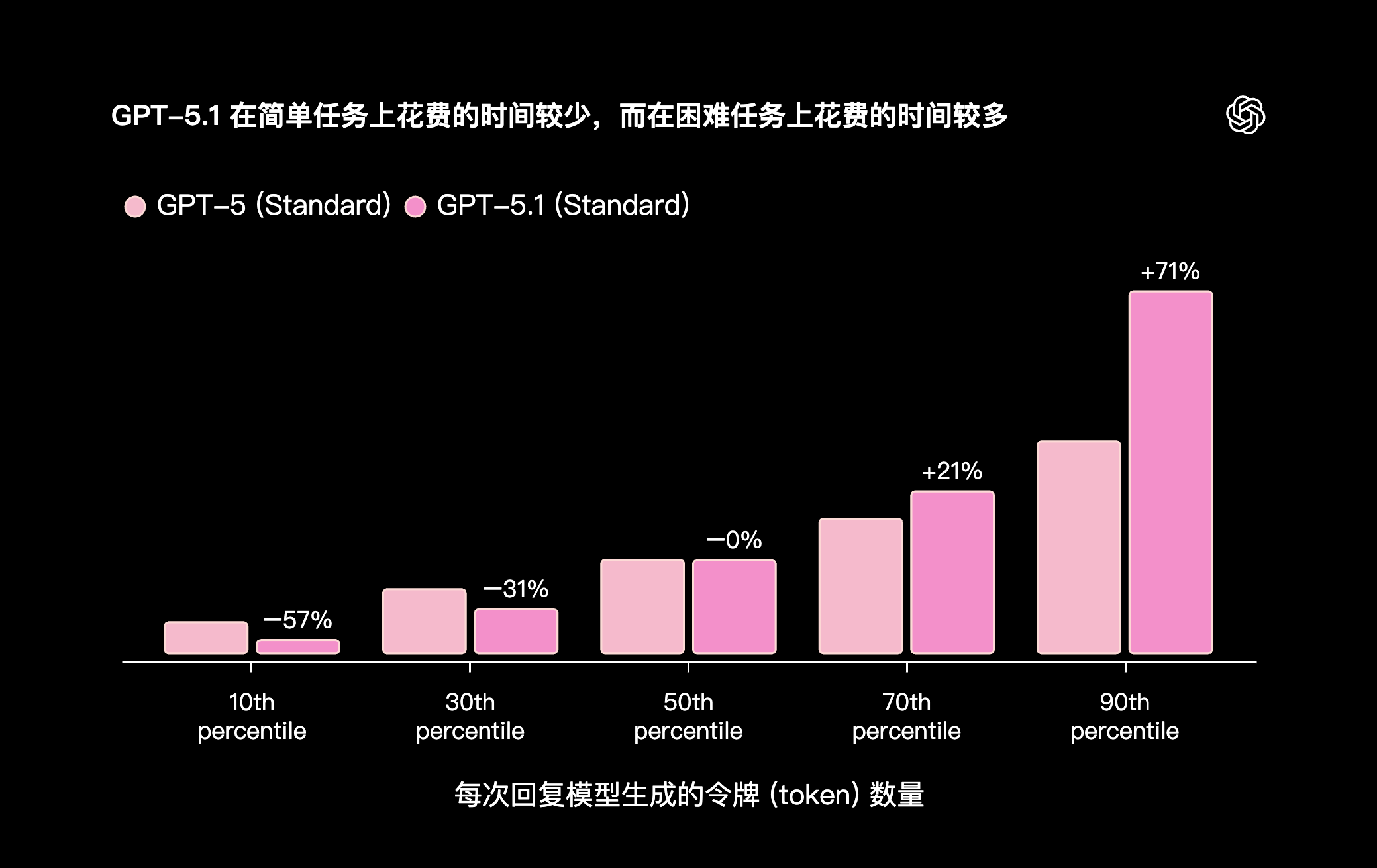

+我们也在升级 GPT‑5 Thinking,让其在日常使用中更高效、更易理解。它现在能更精准地根据问题调整思考时间 — 在复杂问题上花更多时间,而在简单问题上则做出更快回应。实际效果就是:棘手的请求可得到更全面的答案,简单请求的等待时间会更短。

+

+GPT-5.1 在简单任务上花费的时间较少,而在困难任务上花费的时间较多

+

+

+

+*GPT‑5.1 Thinking 在思考时间上的动态调整比 GPT‑5 Thinking 更灵活。在一组具有代表性的 ChatGPT 任务中,GPT‑5.1 Thinking 在最快的任务上速度约为 GPT‑5 Thinking 的两倍,而在最慢的任务上则约慢一倍。两款模型的思考时间均设为标准模式。*

+

+GPT‑5.1 Thinking 的回复也更加清晰,减少了术语和不明确的表达。这让我们最强大的模型更易于理解和使用,尤其在处理工作中的复杂任务或解释技术概念时。

+

+Q:explain BABIP and wRC+

+

+### GPT-5

+

+Here’s the clean, no-nonsense explainer you want.

+

+##### **BABIP (Batting Average on Balls In Play)**

+

+**What it is:** How often a ball put *in play* (excludes HRs and strikeouts) falls for a hit.

+

+**Formula (hitters or pitchers):**

+

+BABIP=H−HRAB−K−HR+SFBABIP=*A**B*−*K*−*H**R*+*SF**H*−*H**R*

+

+- H = hits, HR = home runs, AB = at-bats, K = strikeouts, SF = sac flies.

+

+**Why it matters:**

+

+- Captures contact quality, defense, ballpark, and luck.

+- League average hovers around **.300** most seasons.

+- **Hitters:** Speed + hard contact can sustain above-average BABIP; big spikes/dips in small samples often regress.

+- **Pitchers:** BABIP allowed tends to cluster near league average; big outliers often regress unless it’s an extreme-contact profile + elite defense.

+

+**Quick reads:**

+

+- **>.330**: strong contact/speed *or* some good fortune.

+- **.270–.300**: typical range.

+- **<.270**: weak contact/slow footspeed *or* bad luck/elite defenses faced.

+

+##### **wRC+ (Weighted Runs Created Plus)**

+

+**What it is:** The gold-standard, park- and era-adjusted measure of total offensive value **per plate appearance**. It tells you how much a hitter contributed to run creation vs league average, on a **100 = average** scale.

+

+**Scale:**

+

+- **100** = league average

+- **120** = 20% better than league average

+- **80** = 20% worse than league average

+- **140+** = star/elite seasons

+

+**How it’s built (conceptually):**

+

+1. Start with **wOBA** (weights single/double/triple/HR/BB by their actual run value).

+2. Convert to **wRAA** (runs above average).

+3. Adjust for **park** and **league/season** effects.

+4. Normalize so **100 = average** → that’s **wRC+**.

+

+**Why it’s great:** It compares hitters fairly across parks (Coors vs. Safeco) and seasons (offense-heavy vs dead-ball-ish years). It also captures more than batting average—walks and extra-base hits count properly.

+

+**Limitations (both stats):**

+

+- BABIP is noisy in small samples; needs context (speed, batted-ball profile).

+- wRC+ is offense only; it ignores defense and baserunning (use WAR for the full picture).

+

+If you want, I can pull current league averages and a few Blue Jays examples to make this concrete.

+

+### GPT-5.1 Thinking

+

+Nice, nerd stat time 🧢

+

+I’ll do each one in plain English, then add a bit of context.

+

+------

+

+##### **1. BABIP – Batting Average on Balls In Play**

+

+**What it is:

+

+**BABIP measures **how often a ball put into the field of play falls in for a hit**, *excluding* home runs and strikeouts.

+

+**Formula (conceptually):**

+

+BABIP = (Hits − Home Runs) ÷ (At-Bats − Strikeouts − Home Runs + Sacrifice Flies)

+

+So:

+

+- It only cares about **balls that fielders can make a play on**.

+- It ignores:

+ - Strikeouts (no ball in play)

+ - Home runs (no fielder involved)

+ - Walks/HBP (not at-bats)

+

+**Why it matters:**

+

+- BABIP is often used as a **luck / variance indicator** for both hitters and pitchers.

+

+- League-average BABIP is usually around

+

+ .295–.300

+

+ .

+

+ - Much higher than .300?

+

+ Might mean:

+

+ - Hitting the ball hard

+ - Fast, beats out infield hits

+ - *or* just getting lucky bloops

+

+ - Much lower than .300?

+

+ Might mean:

+

+ - Lots of weak contact

+ - Shift / positioning hurting you

+ - *or* bad luck, everything hit “right at” someone

+

+**How people actually use it:**

+

+- For hitters:

+ - Very high BABIP + no history of high BABIP → “He’s probably going to cool off.”

+ - Very low BABIP + solid skills → “He might bounce back.”

+- For pitchers:

+ - Weirdly high BABIP against them → “Probably some bad luck / bad defense behind him.”

+

+------

+

+##### **2. wRC+ – Weighted Runs Created Plus**

+

+**What it is:

+